Классификация ошибок измерения

Любая

физическая величина может быть измерена

путем сравнения её с однородной величиной,

принятой за единицу (эталоном).

Измерения

бывают прямые и косвенные. В результате

прямых измерений определяемая физическая

величина получается сразу, непосредственно.

Примерами прямых измерений служат

определения длины (линейкой,

штангенциркулем), силы электрического

тока (амперметром). При косвенных

измерениях искомая величина вычисляется

по результатам прямых измерений других

величин, связанных с искомой некоторой

формулой.

Любое

измерение не может быть абсолютно

точным. Между истинным ХИСТ

и измеренным значением физической

величины Х

существует некоторая разность

ΔХ

= ½Х

– ХИСТ½,

(1.1)

которая

называется абсолютной ошибкой результата

измерения.

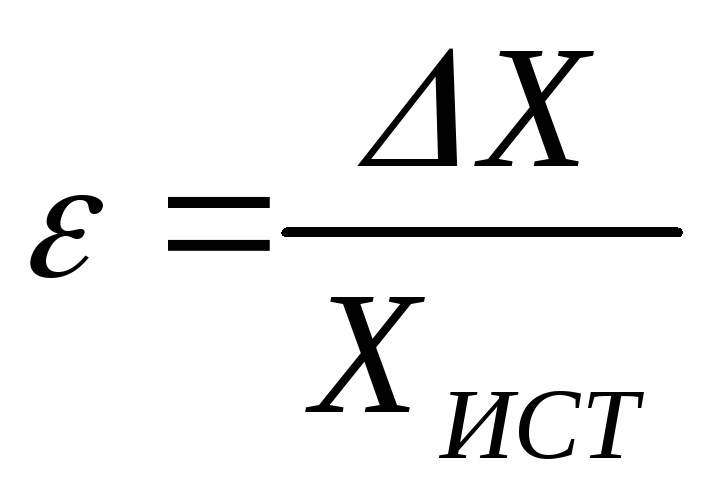

Чтобы

охарактеризовать качество измерения

и иметь возможность сравнить результаты

измерений различных физических величин,

вводится понятие относительной

погрешности, под которым подразумевают

отношение абсолютной ошибки измерения

к истинному значению измеряемой величины.

Чем

меньше относительная погрешность, тем

выше точность измерения. Погрешности,

или ошибки измерения, можно разделить

на три класса: грубые ошибки, или промахи;

систематические ошибки; случайные

ошибки.

Грубые

ошибки появляются в результате

небрежности, невнимательности

экспериментатора (неправильные отсчеты

по прибору, неправильная запись результата

и т.п.). В большинстве случаев промахи

хорошо заметны, так как резко отличаются

от результатов других измерений.

Систематические

ошибки могут быть вызваны методикой

постановки эксперимента, ограниченной

точностью измерительных приборов,

дефектами самого объекта исследования

и т.д. Величина и знак систематической

погрешности могут оставаться неизменными

при многократном повторении одних и

тех же измерений. В некоторых случаях

влияние систематических погрешностей

на результат измерения можно учесть,

если ввести соответствующие поправки.

Случайные

ошибки обусловлены действием самых

разнообразных и неконтролируемых

причин. Поэтому результаты повторных

измерений одной и той же физической

величины могут не совпадать даже при

том, что они проводятся в неизменных

условиях одним и тем же методом (такие

измерения называют равноточными).

Случайные

ошибки могут иметь любую величину,

положительный или отрицательный знак.

Ошибки, противоположные по знаку, но

равные по абсолютной величине, встречаются

в среднем одинаково часто. Закономерности,

которым подчиняются случайные ошибки,

и способы их оценки изучают в разделе

математики «Теория ошибок», основанном

на законах теории вероятности и

математической статистики.

Методика расчета случайных ошибок прямых измерений

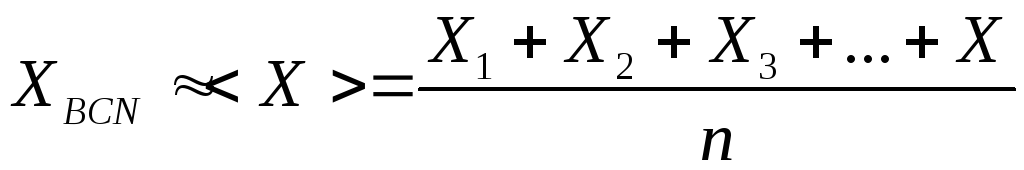

Пусть

измеряется n

раз некоторая физическая величина Х.

Из-за случайных погрешностей, возникающих

в процессе измерения, мы получаем набор

значений Х1,

Х2,

Х3,

…, Хn.

Наиболее близким к истинному значению

ХИСТ

будет среднее арифметическое

Чем

больше измерений, тем ближе < X

> и ХИСТ,

а при

.

В

реальном эксперименте число измерений

всегда ограничено, поэтому истинное

значение измеряемой величины остается

неизвестным. Результаты отдельных

измерений Хi

и среднее арифметическое < X

> всегда содержат ошибку, поэтому

вместе с результатом измерений нужно

указать возможную величину ошибки, т.е.

представить результат в виде

.

Эта запись

равнозначна неравенству

.

(1.4)

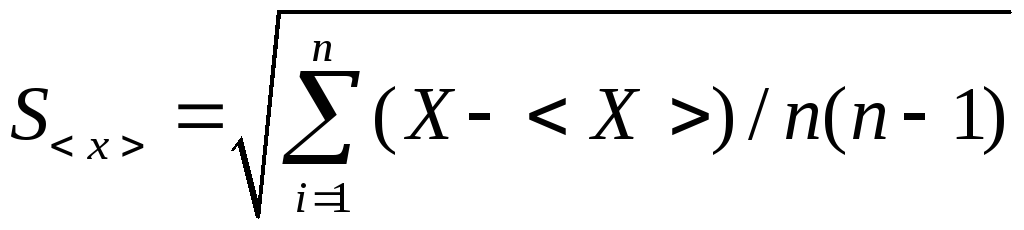

Существует

несколько способов оценки случайной

ошибки DХ.

Мы рассмотрим один из них, наиболее

часто используемый при обработке

результатов эксперимента. По результатам

измерений рассчитывают так называемую

среднюю квадратическую ошибку среднего

арифметического:

(1.5)

Так

как результаты отдельных измерений Хi

и среднее арифметическое – случайные

величины, то и S<

Х >

тоже

случайная величина. Поэтому мы не можем

утверждать, например, что возможная

ошибка DХ

не превышает величины S<

Х >.

Следовательно, нужно не только рассчитать

возможную величину ошибки, но и указать

вероятность того, что среднее арифметическое

отличается от ХИСТ

не более чем на величину DХ,

т.е. вероятность, с которой выполняется

неравенство (1.4).

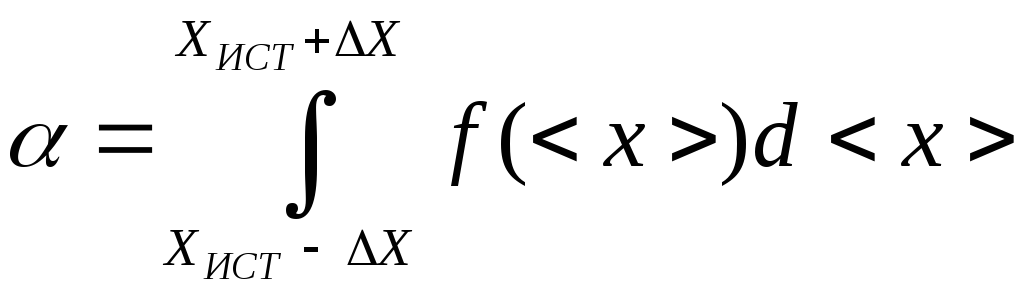

Область

значений

называется доверительным интервалом,

а соответствующая вероятность –

доверительнойα.

Доверительная вероятность является

весьма важной характеристикой измерений,

так как позволяет судить о надежности

полученного результата.

Для

нахождения доверительной вероятности

необходимо знать закон распределения

случайной величины (Хi;

< Х >; S<

Х >).

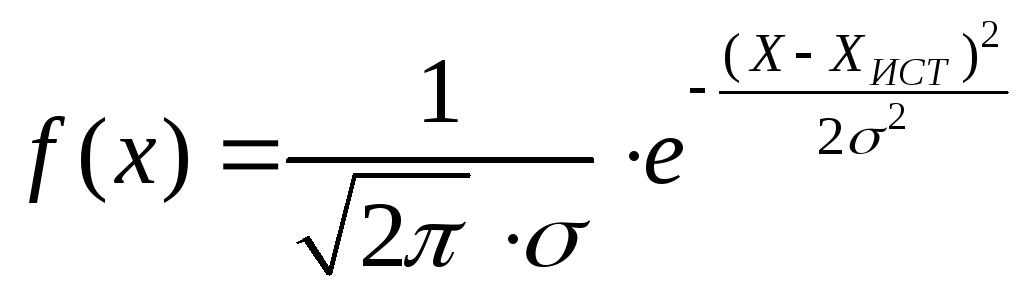

Наиболее часто встречается на практике

распределение Гаусса (нормальное

распределение):

Здесь

f(х) –

функция распределения случайной величины

Х.

Произведение f(х)

· dх равно

вероятности того, что случайная величина

примет значение, заключенное между Х

и Х

+ DХ.

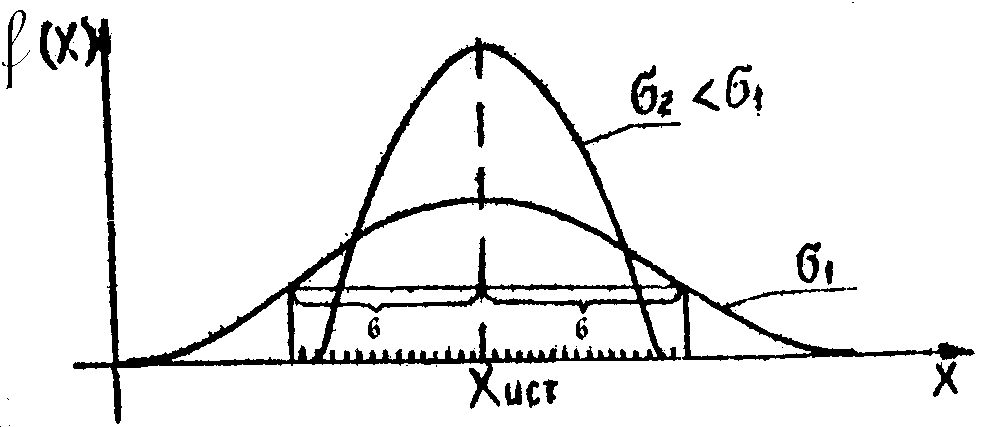

Графически закон

Гаусса представлен на рис. 1.5.

Рис.

1.5

Кривая

Гаусса характеризуется двумя параметрами:

ХИСТ

и σ.

ХИСТ

определяет положение вершины, а σ

– ширину кривой (2

σ – расстояние

между точками перегиба). Параметр σ

называют стандартным отклонением или

средним квадратическим. Он определяет

разброс результатов измерений около

ХИСТ,

т.е. характеризует степень влияния

случайных погрешностей на результаты

измерений. На

рис. 1.5 показаны две гауссовы кривые для

разных значений стандартного отклонения

(σ

1 и σ

2). В

законе Гаусса σ

2 носит

название дисперсии случайной величины

(дисперсия – разброс).

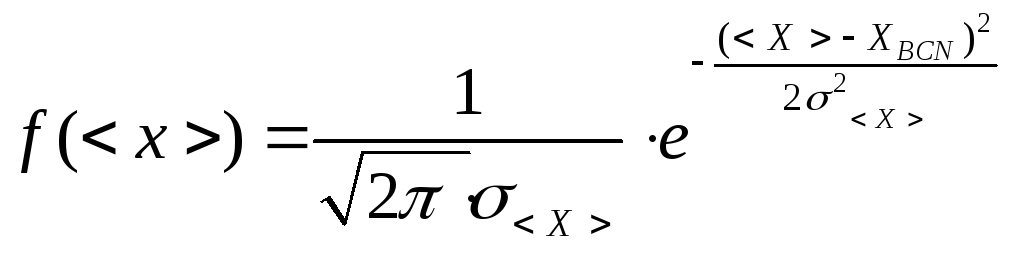

Среднее

арифметическое, как случайная величина,

тоже описывается законом Гаусса с

параметрами

,

Среднее

значение является лучшей оценкой для

ХИСТ,

чем результат

отдельного измерения, так как кривая f

(< х >) в n

раз уже.

При

известном параметре σ

< Х >

доверительная вероятность:

Если

задать доверительный интервал

,

то

= 0,682; если

,

то,

то.

Указанные

значения доверительной вероятности

относятся к бесконечно большому числу

измерений. В практике физического

эксперимента N

часто не превышает 10, а параметр

неизвестен.

Если запринять

,

то доверительная вероятность, рассчитанная

на основе закон Гаусса, оказывается

завышенной.

Существует

другой,

более строгий метод определения

доверительной вероятности, основанный

на распределении Стьюдента,

которое учитывает случайный характер

величины

.

Распределение Стьюдента не содержит

неизвестных параметровХИСТ,

и

существенно отличается от гауссового

при малом числе измерений (N

< 30).

В физическом лабораторном практикуме

обычно ставится такая задача: по заданной

доверительной вероятности нужно оценить

величину доверительного интервала.

На основе распределения Стьюдента

доверительный интервал

,

где

– коэффициент

Стьюдента.

Существуют

таблицы, в которых даны значения

коэффициента Стьюдента

для разных

значений доверительной вероятности и

различного числа измерений (табл. 1.1).

Таблица 1.1

Соседние файлы в предмете [НЕСОРТИРОВАННОЕ]

- #

- #

- #

- #

- #

- #

- #

- #

- #

- #

- #

Классификация погрешностей измерений

Качество средств и результатов измерений принято характеризовать, указывая их погрешности. Введение понятия «погрешность» требует определения и четкого разграничения трех понятий: истинного и действительного значений измеряемой физической величины и результата измерения. Истинное значение физической величины — это значение, идеальным образом отражающее свойство данного объекта как в количественном, так и в качественном отношении. Оно не зависит от средств нашего познания и является той абсолютной истиной, к которой мы стремимся, пытаясь выразить ее в виде числовых значений. На практике это абстрактное понятие приходится заменять понятием «действительное значение».

Действительное значение физической величины — значение, найденное экспериментально и настолько приближающееся к истинному, что для данной цели оно может быть использовано вместо него. Результат измерения представляет собой приближенную оценку истинного значения величины, найденную путем измерения.

Понятие «погрешность» — одно из центральных в метрологии, где используются понятия «погрешность результата измерения» и «погрешность средства измерения». Погрешность результата измерения — это разница между результатом измерения X и истинным (или действительным) значением Q измеряемой величины:

Δ = X–Q. (5.1)

Она указывает границы неопределенности значения измеряемой величины. Погрешность средства измерения — разность между показанием СИ и истинным (действительным) значением измеряемой ФВ. Она характеризует точность результатов измерений, проводимых данным средством.

Эти два понятия во многом близки друг к другу и классифицируются по одинаковым признакам.

Характер проявления

По характеру проявления погрешности делятся на случайные, систематические, прогрессирующие и грубые (промахи),

Заметим, что из приведенного выше определения погрешности никак не следует, что она должна состоять из каких-либо составляющих. Деление погрешности на составляющие было введено для удобства обработки результатов измерений исходя из характера их проявления. В процессе формирования метрологии было обнаружено, что погрешность не является постоянной величиной. Путем элементарного анализа установлено, что одна ее часть проявляется как постоянная величина, а другая — изменяется непредсказуемо. Эти части назвали систематической и случайной погрешностями.

Изменение погрешности во времени представляет собой нестационарный случайный процесс. Разделение погрешности на систематическую, прогрессирующую и случайную составляющие представляет собой попытку описать различные участки частотного спектра этого широкополосного процесса: инфранизкочастотный, низкочастотный и высокочастотный.

Случайная погрешность — составляющая погрешности измерения, изменяющаяся случайным образом (по знаку и значению) в серии повторных измерений одного и того же размера ФВ, проведенных с одинаковой тщательностью в одних и тех же условиях. В появлении таких погрешностей (рис. 5.1) не наблюдается какой-либо закономерности, они обнаруживаются при повторных измерениях одной и той же величины в виде некоторого разброса получаемых результатов. Случайные погрешности неизбежны, неустранимы и всегда присутствуют в результате измерения. Описание случайных погрешностей возможно только на основе теории случайных процессов и математической статистики.

Рис. 5.1. Изменение случайной погрешности от измерения к измерении

В отличие от систематических случайные погрешности нельзя исключить из результатов измерений путем введения поправки, однако их можно существенно уменьшить путем увеличения числа наблюдений. Поэтому для получения результата, минимально отличающегося от истинного значения измеряемой величины, проводят многократные измерения требуемой величины с последующей математической обработкой экспериментальных данных.

Большое значение имеет изучение случайной погрешности как функции номера наблюдения i или соответствующего ему момента времени t{ проведения измерений, т.е. Δ=A(t). Отдельные значения погрешности являются значениями функции A(t), следовательно, погрешность измерения есть случайная функция времени. При проведении многократных измерений получается одна реализация такой функции. Именно такая реализация показана на рис. 5.1. Повтор серии измерений даст нам другую реализацию этой функции, отличающуюся от первой, и т. д. Погрешность, соответствующая каждому i-му измерению, является сечением случайной функции A(t). В каждом сечении данной функции можно найти среднее значение, вокруг которого группируются погрешности в различных реализациях. Если через полученные таким образом средние значения провести плавную кривую, то она будет характеризовать общую тенденцию изменения погрешности во времени.

Систематическая погрешность — составляющая погрешности измерения, остающаяся постоянной или закономерно меняющаяся при повторных измерениях одной и той же ФВ. Постоянная и переменная систематические погрешности показаны на рис. 5.2. Их отличительный признак заключается в том, что они могут быть предсказаны, обнаружены и благодаря этому почти полностью устранены введением соответствующей поправки.

Некоторые исследователи считают систематическую погрешность специфической, «вырожденной» случайной величиной, обладающей некоторыми, но не всеми свойствами случайной величины, изучаемой в теории вероятностей и математической статистике. Ее свойства, которые необходимо учитывать при объединении составляющих погрешности, отражаются теми же характеристиками, что и свойства «настоящих» случайных величин: дисперсией (средним квадратическим отклонением) и коэффициентом взаимной корреляции.

Прогрессирующая (дрейфовая) погрешность — это непредсказуемая погрешность, медленно меняющаяся во времени. Отличительные особенности прогрессирующих погрешностей:

- они могут быть скорректированы поправками только в данный момент времени, а далее вновь непредсказуемо изменяются;

- изменения прогрессирующих погрешностей во времени — нестационарный случайный процесс, и поэтому в рамках хорошо разработанной теории стационарных случайных процессов они могут быть описаны лишь с известными оговорками.

Рис. 5.2. Постоянная и переменная систематические погрешности

Прогрессирующая погрешность — это понятие, специфичное для нестационарного случайного процесса изменения погрешности во времени, оно не может быть сведено к понятиям случайной и систематической погрешностей. Последние характерны лишь для стационарных случайных процессов.

Понятие прогрессирующей погрешности широко используется при исследовании динамики погрешностей СИ и метрологической надежности последних.

Грубая погрешность (промах) – это случайная погрешность результата отдельного наблюдение входящего в ряд измерений, которая для данных условий резко отличается от остальных результатов этого ряда. Они, как правило, возникают из-за ошибок или неправильных действий оператора (его психофизиологического состояния, неверного отсчета, ошибок в записях или вычислениях, неправильного включения приборов или сбоев в их работе и др.). Возможной причиной возникновения промахов также могут быть кратковременные резкие извинения условий проведения измерений. Если промахи обнаруживаются в процессе измерений, то результаты, их содержащие, отбрасывают. Однако чаще всего промахи выявляют только при окончательной обработке результатов измерений с помощью специальных критериев, которые рассмотрены в ниже.

Способ выражения

По способу выражения различают абсолютную, относительную и приведенную погрешности.

Абсолютная погрешность описывается формулой (5.1) и выражается в единицах измеряемой величины. Однако она не может в полной мере служить показателем точности измерений, так как одно и то же ее значение, например, Δ = 0,05мм при X = 100 мм соответствует достаточно высокой точности изменений, а при X= 1 мм – низкой.

Поэтому и вводится понятие относительной погрешности. Относительная погрешность– это отношение абсолютной погрешности измерения к истинному значению измеряемой величины:

δ=Δ/Q=(X–Q)/Q.

Эта наглядная характеристика точности результата измерения не годится для нормирования погрешности СИ, так как при изменении значений Q принимает различные значения вплоть до бесконечности при Q = О. В связи с этим для указания и нормирования погрешности СИ используется еще одна разновидность погрешности – приведенная.

Приведенная погрешность – (это относительная погрешность, в которой абсолютная погрешность СИ отнесена к условно принятому значению QN, постоянному во всем диапазоне измерений или его части:

γ=Δ/QN= (X — Q)/QN.

Условно принятое значение QN называют нормирующим. Чаще всего за него принимают верхний предел измерений данного СИ, применительно к которым и используется главным образом понятие «приведенная погрешность».

В зависимости от места возникновения различают инструментальные, методические и субъективные погрешности.

Инструментальная погрешность обусловлена погрешностью применяемого СИ. Иногда эту погрешность называют аппаратурной.

Методическая погрешность измерения обусловлена:

- отличием принятой модели объекта измерения от модели, адекватно описывающей его свойство, которое определяется путем измерения;

- влиянием способов применения СИ. Это имеет место, например, при измерении напряжения вольтметром с конечным значением внутреннего сопротивления. В данном случае вольтметр шунтирует участок цепи, на котором измеряется напряжение, и оно оказывается меньше, чем было до присоединения вольтметра;

- влиянием алгоритмов (формул), по которым производятся вычисления результатов измерений;

- влиянием других факторов, не связанных со свойствами используемых средств измерения.

Отличительной особенностью методических погрешностей является то, что они не могут быть указаны в нормативно-технической документации на используемое СИ, поскольку от него не зависят, а должны определяться оператором в каждом конкретном случае. В связи с этим оператор должен четко различать фактически измеряемую им величину и величину, подлежащую измерению.

Субъективная (личная) погрешность измерения обусловлена погрешностью отсчета оператором показаний по шкалам СИ, диаграммам регистрирующих приборов. Они вызываются состоянием оператора, его положением во время работы, несовершенством органов чувств, эргономическими свойствами СИ. Характеристики личной погрешности определяют на основе нормированной номинальной цены деления шкалы измерительного прибора (или диаграммной бумаги регистрирующего прибора) с учетом способности «среднего оператора», к интерполяции в пределах деления шкалы.

По зависимости абсолютной погрешности от значений измеряемой величины различают погрешности (рис. 5.3):

- аддитивные не зависящие от измеряемой величины;

- мультипликативные которые прямо пропорциональны измеряемой величине;

- нелинейные имеющие нелинейную зависимость от измеряемой величины.

Рис. 5.3. Аддитивная (а), мультипликативная (б) и нелинейная (в) погрешности

Эти погрешности применяют в основном для описания метрологических характеристик СИ. Разделение погрешностей на аддитивные, мультипликативные и нелинейные весьма существенно при решении вопроса о нормировании и математическом описании погрешностей СИ.

Примеры аддитивных погрешностей — от постоянного груза на чашке весов, от неточной установки на нуль стрелки прибора перед измерением, от термо-ЭДС в цепях постоянного тока. Причинами возникновения мультипликативных погрешностей могут быть: изменение коэффициента усиления усилителя, изменение жесткости мембраны датчика манометра или пружины прибора, изменение опорного напряжения в цифровом вольтметре.

Влияне внешних условий

По влиянию внешних условий различают основную и дополнительную погрешности СИ. Основной называется погрешность СИ, определяемая в нормальных условиях его применения. Для каждого СИ в нормативно-технических документах оговариваются условия эксплуатации — совокупность влияющих величин (температура окружающей среды, влажность, давление, напряжение и частота питающей сети и др.), при которых нормируется его погрешность. Дополнительной называется погрешность СИ, возникающая вследствие отклонения какой-либо из влияющих величин.

В зависимости от влияния характера изменения измеряемых величин погрешности СИ делят на статические и динамические. Статическая погрешность — это погрешность СИ применяемого для измерения ФВ, принимаемой за неизменную. Динамической называется погрешность СИ, возникающая дополнительно при измерении переменной ФВ и обусловленная несоответствием его реакции на скорость (частоту) изменения измеряемого сигнала.

В связи с приведенными краткими характеристиками различных по природе погрешностей остановимся на попытках ввести некоторые термины, характеризующие результаты измерении, в зависимости от вида погрешностей.

Похожие материалы

В зависимости от обстоятельств, при которых проводились измерения, а также в зависимости от целей измерения, выбирается та или иная классификация погрешностей. Иногда используют одновременно несколько взаимно пересекающихся классификаций, желая по нескольким признакам точно охарактеризовать влияющие на результат измерения физические величины. В таком случае рассматривают, например, инструментальную составляющую неисключённой систематической погрешности. При выборе классификаций важно учитывать наиболее весомые или динамично меняющиеся или поддающиеся регулировке влияющие величины. Ниже приведены общепринятые классификации согласно типовым признакам и влияющим величинам.

По виду представления, различают абсолютную, относительную и приведённую погрешности.

Абсолютная погрешность это разница между результатом измерения X и истинным значением Q измеряемой величины. Абсолютная погрешность находится как D = X — Q и выражается в единицах измеряемой величины.

Относительная погрешность это отношение абсолютной погрешности измерения к истинному значению измеряемой величины: d = D / Q = (X – Q) / Q .

Приведённая погрешность это относительная погрешность, в которой абсолютная погрешность средства измерения отнесена к условно принятому нормирующему значению QN , постоянному во всём диапазоне измерений или его части. Относительная и приведённая погрешности – безразмерные величины.

В зависимости от источника возникновения, различают субъективную, инструментальную и методическую погрешности.

Субъективная погрешность обусловлена погрешностью отсчёта оператором показаний средства измерения.

Инструментальная погрешность обусловлена несовершенством применяемого средства измерения. Иногда эту погрешность называют аппаратурной. Метрологические характеристики средств измерений нормируются согласно ГОСТ 8.009 – 84, при этом различают четыре составляющие инструментальной погрешности: основная, дополнительная, динамическая, интегральная. Согласно этой классификации, инструментальная погрешность зависит от условий и режима работы, а также от параметров сигнала и объекта измерения.

Методическая погрешность обусловлена следующими основными причинами:

– отличие принятой модели объекта измерения от модели, адекватно описывающей его метрологические свойства;

– влияние средства измерения на объект измерения;

– неточность применяемых при вычислениях физических констант и математических соотношений.

В зависимости от измеряемой величины, различают погрешность аддитивную и мультипликативную. Аддитивная погрешность не зависит от измеряемой величины. Мультипликативная погрешность меняется пропорционально измеряемой величине.

В зависимости от режима работы средства измерений, различают статическую и динамическую погрешности.

Динамическая погрешность обусловлена реакцией средства измерения на изменение параметров измеряемого сигнала (динамический режим).

Статическая погрешность средства измерения определяется при параметрах измеряемого сигнала, принимаемых за неизменные на протяжении времени измерения (статический режим).

По характеру проявления во времени, различают случайную и систематическую погрешности.

Систематической погрешностью измерения называют погрешность, которая при повторных измерениях одной и той же величины в одних и тех же условиях остаётся постоянной или закономерно меняется.

Случайной погрешностью измерения называют погрешность, которая при повторных измерениях одной и той же величины в одних и тех же условиях изменяется случайным образом.

Погрешности измерений и их

классификация .

При

измерении физических величии с помощью даже самых точных и совершенных средств

и методов их результат всегда отличается от истинного

значения измеряемой физической величины, т.е. определяется с некоторой

погрешностью. Источниками погрешностей измерения являются следующие

причины: несовершенство используемых методов и средств измерений,

нестабильность измеряемых физических величин, непостоянство климатических

условий, внешние и внутренние помехи, а также различные субъективные факторы

экспериментатора.

Определение

«погрешность» является одним из центральных в метрологии, в котором

используются понятия «погрешность результата измерения» и «погрешность

средства измерения».

Погрешностью результата измерения (погрешностью измерения) называется отклонение

результата измерения от истинного значения измеряемой физической величины. Так

как истинное значение измеряемой величины неизвестно, то при количественной

оценке погрешности пользуются действительным значением физической

величины.

Это

значение находится экспериментальным путем и настолько близко к истинному

значению, что для поставленной измерительной задачи может быть использовано

вместо него.

Погрешность средства измерения (СИ) — разность между показаниями СИ

и истинным (действительным) значением измеряемой физической величины. Она

характеризует точность результатов измерений, проводимых данным средством

Существует пять основных

признаков, по

которым классифицируются погрешности измерения.

По

способу количественного выражения погрешности измерения делятся на абсолютные,

относительные и приведенные.

Абсолютной погрешностью △, выражаемой в единицах

измеряемой величины, называется отклонение результата измерения х от истинного значения хн: (1.1)

и знак полученной

погрешности, но не определяет качество самого проведенного измерения.

Понятие

погрешности характеризует как бы несовершенство измерения.

Характеристикой качества измерения является используемое в метрологии понятие точности измерений, отражающее меру близости результатов измерений к истинному

значению измеряемой физической величины. Точность и погрешность связаны

обратной зависимостью. Иначе говоря, высокой точности измерений соответствует

малая погрешность. Так, например, измерение силы тока в 10 А и 100 А может быть

выполнено с идентичной абсолютной погрешностью ∆ = ±1 А. Однако качество

(точность) первого измерения ниже второго. Поэтому, чтобы иметь возможность

сравнивать качество измерений, введено понятие относительной погрешности.

Относительной погрешностью δ называется отношение

абсолютной погрешности измерения к истинному значению измеряемой величины:

|

(1.2)

Мерой

точности измерений служит величина,

обратная модулю относительной погрешности, т.е. 1/|δ|. Погрешность δ часто выражают в

процентах:

δ

= 100△/хн (%). Поскольку обычно △⋍хн, то относительная погрешность

может быть определена как δ ⋍ △/х или δ = 100△/х (%).

Если

измерение выполнено однократно и за

абсолютную погрешность результата измерения △ принята разность между

показанием прибора и истинным значением измеряемой величины хН то из соотношения (1.2)

следует, что значение относительной погрешности δ уменьшается с ростом величины

хн (здесь предполагается

независимость △ от хн). Поэтому для измерений

целесообразно выбирать такой прибор, показания которого были бы в последней

части его шкалы (диапазона измерений), а для сравнения различных приборов

использовать понятие приведенной погрешности.

Приведенной погрешностью δпр, выражающей

потенциальную точность измерений, называется отношение абсолютной погрешности △ к некоторому нормирующему

значению XN (например, к конечному

значению шкалы прибора или сумме конечных значений шкал при двусторонней шкале).

По

характеру (закономерности) изменения погрешности измерений подразделяются на

систематические, случайные и грубые (промахи).

Систематические погрешности △с — составляющие погрешности измерений,

остающиеся постоянными или закономерно изменяющиеся , при многократных (повторных)

измерениях одной и той же величины в одних и тех же условиях. Такие погрешности

могут быть выявлены путем детального анализа возможных их источников и

уменьшены (применением более точных приборов, калибровкой приборов с помощью

рабочих мер и пр.). Однако полностью их устранить нельзя.

По

характеру изменения во времени систематические погрешности подразделяются на постоянные (сохраняющие величину и

знак), прогрессирующие (возрастающие или убывающие во времени), периодические, а также изменяющиеся во

времени по сложному непериодическому закону. Основные из этих погрешностей —

прогрессирующие.

Прогрессирующая (дрейфовая) погрешность — это непредсказуемая погрешность,

медленно меняющаяся во времени. Прогрессирующие погрешности характеризуются

следующими особенностями:

•

возможна

их коррекция поправками только в данный момент времени, а далее эти погрешности

вновь непредсказуемо изменяются;

•

изменения

прогрессирующих погрешностей во времени представляют собой нестационарный

случайный процесс (характеристики которого изменяются во времени), и поэтому в

рамках достаточно полно разработанной теории стационарных случайных процессов

они могут быть описаны лишь с некоторыми ограничениями.

Случайные погрешности

— составляющие погрешности измерений, изменяющиеся случайным образом при

повторных (многократных) измерениях одной и той же величины в одних и тех же

условиях. В появлении таких погрешностей нет каких-либо закономерностей, они

проявляются при повторных измерениях одной и той же величины в виде некоторого

разброса получаемых результатов. Практически случайные погрешности неизбежны,

неустранимы и всегда имеют место в результатах измерений. Описание случайных

погрешностей возможно только на основе теории случайных процессов и

математической статистики. В отличие от систематических случайные погрешности

нельзя исключить из результатов измерений путем введения поправки, однако их

можно существенно уменьшить путем многократного измерения этой величины и

последующей статистической обработкой полученных результатов.

Грубые погрешности (промахи) —

погрешности, существенно превышающие ожидаемые при данных условиях измерения.

Такие погрешности возникают из-за ошибок оператора или неучтенных внешних

воздействий. Их выявляют при обработке результатов измерений и исключают из рассмотрения,

пользуясь определенными правилами.

По причинам возникновения погрешности измерения подразделяются

на методические, инструментальные, внешние и субъективные.

Методические

погрешности возникают обычно из-за

несовершенства метода измерений, использования неверных теоретических

предпосылок (допущений) при измерениях, а также из-за влияния выбранного

средства измерения на измеряемые физические величины. При подключении

электроизмерительного прибора от источника сигнала потребляется некоторая

мощность. Это приводит к искажению режима работы источника сигнала и вызывает

погрешность метода измерения (методическую погрешность).

Так,

например, если вольтметр обладает недостаточно высоким входным сопротивлением,

то его подключение к исследуемой схеме способно изменить в ней распределение

токов и напряжений. При этом результат измерения может существенно отличаться

от действительного. Для расчета методической погрешности при измерении токов и

напряжений необходимо знать внутренние сопротивления амперметров RA

и вольтметров Rv. Методическую

погрешность можно уменьшить путем применения более точного метода измерения.

Инструментальные

(аппаратурные, приборные) погрешности

возникают из-за несовершенства средств измерения» т.е. из-за погрешностей

средств измерений. Источниками инструментальных погрешностей могут быть,

например, неточная градуировка прибора и смещение нуля, вариация показаний

прибора в процессе эксплуатации и т.д. Уменьшают инструментальные погрешности

применением более точного прибора.

Внешняя

погрешность — важная составляющая погрешности

измерения, связанная с отклонением одной или

нескольких влияющих величин от нормальных значений или выходом их за пределы нормальной области (например,

влияние влажности, температуры, внешних электрических и

магнитных полей, нестабильности источников питания, механических воздействий и

т.д.). В большинстве случаев внешние погрешности являются систематическими и

определяются дополнительными погрешностями применяемых средств измерений. .

Субъективные

погрешности вызываются ошибками оператора при отсчете

показаний средств измерения (погрешности от небрежности и невнимания

оператора, от параллакса, т.е. от неправильного направления взгляда при отсчете

показаний стрелочного прибора и пр.). Подобные погрешности устраняются

применением современных цифровых приборов или автоматических методов

измерения.

По характеру поведения измеряемой физической величины в процессе

измерений различают статические и динамические погрешности.

Статические

погрешности возникают при измерении

установившегося значения измеряемой величины, т.е. когда эта величина

перестает изменяться во времени.

Динамические

погрешности имеют место при динамических

измерениях, когда измеряемая величина

изменяется во времени и требуется установить закон ее изменения. Причина

появления динамических погрешностей состоит в несоответствии скоростных

(временных) характеристик прибора и скорости изменения измеряемой величины.

Средства измерений

могут применяться в нормальных и рабочих условиях.

Эти

условия для

конкретных видов СИ (средств измерения) установлены в

стандартах или технических условиях.

Нормальным

условиям применения средств измерений должен

удовлетворять ряд следующих (основных) требований:

температура

окружающего воздуха (20±5) °С;

относительная

влажность (65±15) %;

атмосферное

давление (100±4) кПа;

напряжение

питающей сети (220±4) В и (115±2,5) В;

частота

сети (50±1) Гц и (400±12) Гц.

Как

следует из перечисленных требований, нормальные условия применения СИ

характеризуются диапазоном значений влияющих на них величин типа климатических

факторов и параметров электропитания.

Рабочие

условия применения СИ определяются диапазоном

значений влияющих величин не только климатического характера и параметров

электропитания, но и типа механических воздействий. В частности, диапазон климатических

воздействий делится на ряд групп, охватывающих широкий диапазон изменения

окружающей температуры.