From Wikipedia, the free encyclopedia

In mathematical optimization and decision theory, a loss function or cost function (sometimes also called an error function) [1] is a function that maps an event or values of one or more variables onto a real number intuitively representing some «cost» associated with the event. An optimization problem seeks to minimize a loss function. An objective function is either a loss function or its opposite (in specific domains, variously called a reward function, a profit function, a utility function, a fitness function, etc.), in which case it is to be maximized. The loss function could include terms from several levels of the hierarchy.

In statistics, typically a loss function is used for parameter estimation, and the event in question is some function of the difference between estimated and true values for an instance of data. The concept, as old as Laplace, was reintroduced in statistics by Abraham Wald in the middle of the 20th century.[2] In the context of economics, for example, this is usually economic cost or regret. In classification, it is the penalty for an incorrect classification of an example. In actuarial science, it is used in an insurance context to model benefits paid over premiums, particularly since the works of Harald Cramér in the 1920s.[3] In optimal control, the loss is the penalty for failing to achieve a desired value. In financial risk management, the function is mapped to a monetary loss.

Example[edit]

Regret[edit]

Leonard J. Savage argued that using non-Bayesian methods such as minimax, the loss function should be based on the idea of regret, i.e., the loss associated with a decision should be the difference between the consequences of the best decision that could have been made had the underlying circumstances been known and the decision that was in fact taken before they were known.

Quadratic loss function[edit]

The use of a quadratic loss function is common, for example when using least squares techniques. It is often more mathematically tractable than other loss functions because of the properties of variances, as well as being symmetric: an error above the target causes the same loss as the same magnitude of error below the target. If the target is t, then a quadratic loss function is

for some constant C; the value of the constant makes no difference to a decision, and can be ignored by setting it equal to 1. This is also known as the squared error loss (SEL).[1]

Many common statistics, including t-tests, regression models, design of experiments, and much else, use least squares methods applied using linear regression theory, which is based on the quadratic loss function.

The quadratic loss function is also used in linear-quadratic optimal control problems. In these problems, even in the absence of uncertainty, it may not be possible to achieve the desired values of all target variables. Often loss is expressed as a quadratic form in the deviations of the variables of interest from their desired values; this approach is tractable because it results in linear first-order conditions. In the context of stochastic control, the expected value of the quadratic form is used.

0-1 loss function[edit]

In statistics and decision theory, a frequently used loss function is the 0-1 loss function

where

Meaning if the input is evaluated to true, then the output is 1. Otherwise, if the input is evaluated to false, then the output will be 0.

Constructing loss and objective functions[edit]

In many applications, objective functions, including loss functions as a particular case, are determined by the problem formulation. In other situations, the decision maker’s preference must be elicited and represented by a scalar-valued function (called also utility function) in a form suitable for optimization — the problem that Ragnar Frisch has highlighted in his Nobel Prize lecture.[4]

The existing methods for constructing objective functions are collected in the proceedings of two dedicated conferences.[5][6]

In particular, Andranik Tangian showed that the most usable objective functions — quadratic and additive — are determined by a few indifference points. He used this property in the models for constructing these objective functions from either ordinal or cardinal data that were elicited through computer-assisted interviews with decision makers.[7][8]

Among other things, he constructed objective functions to optimally distribute budgets for 16 Westfalian universities[9]

and the European subsidies for equalizing unemployment rates among 271 German regions.[10]

Expected loss[edit]

In some contexts, the value of the loss function itself is a random quantity because it depends on the outcome of a random variable X.

Statistics[edit]

Both frequentist and Bayesian statistical theory involve making a decision based on the expected value of the loss function; however, this quantity is defined differently under the two paradigms.

Frequentist expected loss[edit]

We first define the expected loss in the frequentist context. It is obtained by taking the expected value with respect to the probability distribution, Pθ, of the observed data, X. This is also referred to as the risk function[11][12][13][14] of the decision rule δ and the parameter θ. Here the decision rule depends on the outcome of X. The risk function is given by:

Here, θ is a fixed but possibly unknown state of nature, X is a vector of observations stochastically drawn from a population,

Bayesian expected loss[edit]

In a Bayesian approach, the expectation is calculated using the posterior distribution π* of the parameter θ:

One then should choose the action a* which minimises the expected loss. Although this will result in choosing the same action as would be chosen using the frequentist risk, the emphasis of the Bayesian approach is that one is only interested in choosing the optimal action under the actual observed data, whereas choosing the actual frequentist optimal decision rule, which is a function of all possible observations, is a much more difficult problem.

Examples in statistics[edit]

- For a scalar parameter θ, a decision function whose output

is an estimate of θ, and a quadratic loss function (squared error loss)

the risk function becomes the mean squared error of the estimate,

An Estimator found by minimizing the Mean squared error estimates the Posterior distribution’s mean.

- In density estimation, the unknown parameter is probability density itself. The loss function is typically chosen to be a norm in an appropriate function space. For example, for L2 norm,

the risk function becomes the mean integrated squared error

Economic choice under uncertainty[edit]

In economics, decision-making under uncertainty is often modelled using the von Neumann–Morgenstern utility function of the uncertain variable of interest, such as end-of-period wealth. Since the value of this variable is uncertain, so is the value of the utility function; it is the expected value of utility that is maximized.

Decision rules[edit]

A decision rule makes a choice using an optimality criterion. Some commonly used criteria are:

- Minimax: Choose the decision rule with the lowest worst loss — that is, minimize the worst-case (maximum possible) loss:

- Invariance: Choose the decision rule which satisfies an invariance requirement.

- Choose the decision rule with the lowest average loss (i.e. minimize the expected value of the loss function):

Selecting a loss function[edit]

Sound statistical practice requires selecting an estimator consistent with the actual acceptable variation experienced in the context of a particular applied problem. Thus, in the applied use of loss functions, selecting which statistical method to use to model an applied problem depends on knowing the losses that will be experienced from being wrong under the problem’s particular circumstances.[15]

A common example involves estimating «location». Under typical statistical assumptions, the mean or average is the statistic for estimating location that minimizes the expected loss experienced under the squared-error loss function, while the median is the estimator that minimizes expected loss experienced under the absolute-difference loss function. Still different estimators would be optimal under other, less common circumstances.

In economics, when an agent is risk neutral, the objective function is simply expressed as the expected value of a monetary quantity, such as profit, income, or end-of-period wealth. For risk-averse or risk-loving agents, loss is measured as the negative of a utility function, and the objective function to be optimized is the expected value of utility.

Other measures of cost are possible, for example mortality or morbidity in the field of public health or safety engineering.

For most optimization algorithms, it is desirable to have a loss function that is globally continuous and differentiable.

Two very commonly used loss functions are the squared loss,

The choice of a loss function is not arbitrary. It is very restrictive and sometimes the loss function may be characterized by its desirable properties.[16] Among the choice principles are, for example, the requirement of completeness of the class of symmetric statistics in the case of i.i.d. observations, the principle of complete information, and some others.

W. Edwards Deming and Nassim Nicholas Taleb argue that empirical reality, not nice mathematical properties, should be the sole basis for selecting loss functions, and real losses often are not mathematically nice and are not differentiable, continuous, symmetric, etc. For example, a person who arrives before a plane gate closure can still make the plane, but a person who arrives after can not, a discontinuity and asymmetry which makes arriving slightly late much more costly than arriving slightly early. In drug dosing, the cost of too little drug may be lack of efficacy, while the cost of too much may be tolerable toxicity, another example of asymmetry. Traffic, pipes, beams, ecologies, climates, etc. may tolerate increased load or stress with little noticeable change up to a point, then become backed up or break catastrophically. These situations, Deming and Taleb argue, are common in real-life problems, perhaps more common than classical smooth, continuous, symmetric, differentials cases.[17]

See also[edit]

- Bayesian regret

- Loss functions for classification

- Discounted maximum loss

- Hinge loss

- Scoring rule

- Statistical risk

References[edit]

- ^ a b Hastie, Trevor; Tibshirani, Robert; Friedman, Jerome H. (2001). The Elements of Statistical Learning. Springer. p. 18. ISBN 0-387-95284-5.

- ^ Wald, A. (1950). Statistical Decision Functions. Wiley.

- ^ Cramér, H. (1930). On the mathematical theory of risk. Centraltryckeriet.

- ^ Frisch, Ragnar (1969). «From utopian theory to practical applications: the case of econometrics». The Nobel Prize–Prize Lecture. Retrieved 15 February 2021.

- ^ Tangian, Andranik; Gruber, Josef (1997). Constructing Scalar-Valued Objective Functions. Proceedings of the Third International Conference on Econometric Decision Models: Constructing Scalar-Valued Objective Functions, University of Hagen, held in Katholische Akademie Schwerte September 5–8, 1995. Lecture Notes in Economics and Mathematical Systems. Vol. 453. Berlin: Springer. doi:10.1007/978-3-642-48773-6. ISBN 978-3-540-63061-6.

- ^ Tangian, Andranik; Gruber, Josef (2002). Constructing and Applying Objective Functions. Proceedings of the Fourth International Conference on Econometric Decision Models Constructing and Applying Objective Functions, University of Hagen, held in Haus Nordhelle, August, 28 — 31, 2000. Lecture Notes in Economics and Mathematical Systems. Vol. 510. Berlin: Springer. doi:10.1007/978-3-642-56038-5. ISBN 978-3-540-42669-1.

- ^ Tangian, Andranik (2002). «Constructing a quasi-concave quadratic objective function from interviewing a decision maker». European Journal of Operational Research. 141 (3): 608–640. doi:10.1016/S0377-2217(01)00185-0. S2CID 39623350.

- ^ Tangian, Andranik (2004). «A model for ordinally constructing additive objective functions». European Journal of Operational Research. 159 (2): 476–512. doi:10.1016/S0377-2217(03)00413-2. S2CID 31019036.

- ^ Tangian, Andranik (2004). «Redistribution of university budgets with respect to the status quo». European Journal of Operational Research. 157 (2): 409–428. doi:10.1016/S0377-2217(03)00271-6.

- ^ Tangian, Andranik (2008). «Multi-criteria optimization of regional employment policy: A simulation analysis for Germany». Review of Urban and Regional Development. 20 (2): 103–122. doi:10.1111/j.1467-940X.2008.00144.x.

- ^ Nikulin, M.S. (2001) [1994], «Risk of a statistical procedure», Encyclopedia of Mathematics, EMS Press

- ^

Berger, James O. (1985). Statistical decision theory and Bayesian Analysis (2nd ed.). New York: Springer-Verlag. Bibcode:1985sdtb.book…..B. ISBN 978-0-387-96098-2. MR 0804611. - ^ DeGroot, Morris (2004) [1970]. Optimal Statistical Decisions. Wiley Classics Library. ISBN 978-0-471-68029-1. MR 2288194.

- ^ Robert, Christian P. (2007). The Bayesian Choice. Springer Texts in Statistics (2nd ed.). New York: Springer. doi:10.1007/0-387-71599-1. ISBN 978-0-387-95231-4. MR 1835885.

- ^ Pfanzagl, J. (1994). Parametric Statistical Theory. Berlin: Walter de Gruyter. ISBN 978-3-11-013863-4.

- ^ Detailed information on mathematical principles of the loss function choice is given in Chapter 2 of the book Klebanov, B.; Rachev, Svetlozat T.; Fabozzi, Frank J. (2009). Robust and Non-Robust Models in Statistics. New York: Nova Scientific Publishers, Inc. (and references there).

- ^ Deming, W. Edwards (2000). Out of the Crisis. The MIT Press. ISBN 9780262541152.

Further reading[edit]

- Aretz, Kevin; Bartram, Söhnke M.; Pope, Peter F. (April–June 2011). «Asymmetric Loss Functions and the Rationality of Expected Stock Returns» (PDF). International Journal of Forecasting. 27 (2): 413–437. doi:10.1016/j.ijforecast.2009.10.008. SSRN 889323.

- Berger, James O. (1985). Statistical decision theory and Bayesian Analysis (2nd ed.). New York: Springer-Verlag. Bibcode:1985sdtb.book…..B. ISBN 978-0-387-96098-2. MR 0804611.

- Cecchetti, S. (2000). «Making monetary policy: Objectives and rules». Oxford Review of Economic Policy. 16 (4): 43–59. doi:10.1093/oxrep/16.4.43.

- Horowitz, Ann R. (1987). «Loss functions and public policy». Journal of Macroeconomics. 9 (4): 489–504. doi:10.1016/0164-0704(87)90016-4.

- Waud, Roger N. (1976). «Asymmetric Policymaker Utility Functions and Optimal Policy under Uncertainty». Econometrica. 44 (1): 53–66. doi:10.2307/1911380. JSTOR 1911380.

Адаптированный перевод прекрасной статьи энтузиаста технологий машинного обучения Javaid Nabi.

Чтобы понимать как алгоритм машинного обучения учится предсказывать результаты на основе данных, важно разобраться в основных концепциях и понятиях, используемых при обучении алгоритма.

Функции оценки

В контексте технологии машинного обучения, оценка – это

статистический термин для нахождения некоторого приближения неизвестного

параметра на основе некоторых данных. Точечная

оценка – это попытка найти единственное лучшее приближение некоторого

количества интересующих нас параметров. Или на более формальном языке математической статистики — точечная оценка это число, оцениваемое на основе наблюдений,

предположительно близкое к оцениваемому параметру.

Под количеством

интересующих параметров обычно подразумевается:

• Один параметр

• Вектор параметров – например, веса в линейной

регрессии

• Целая функция

Точечная оценка

Чтобы отличать оценки параметров от их истинного значения, представим точечную оценку параметра θ как θˆ. Пусть {x(1), x(2), .. x(m)} будут m независимыми и одинаково распределенными величинами. Тогда точечная оценка может быть записана как некоторая функция этих величин:

Такое определение точечной оценки является очень общим и предоставляет разработчику большую свободу действий. Почти любая функция, таким образом, может рассматриваться как оценщик, но хороший оценщик – это функция, значения которой близки к истинному базовому значению θ, которое сгенерированно обучающими данными.

Точечная оценка также может относиться к оценке взаимосвязи между

входными и целевыми переменными, в этом случае чаще называемой функцией оценки.

Функция оценки

Задача, решаемая машинным обучением, заключается в попытке

предсказать переменную y по

заданному входному вектору x. Мы

предполагаем, что существует функция f(x), которая описывает приблизительную

связь между y и x. Например, можно предположить, что y = f(x) + ε, где ε обозначает

часть y, которая явно не

предсказывается входным вектором x.

При оценке функций нас интересует приближение f с помощью модели или оценки fˆ.

Функция оценки в действительности это тоже самое, что оценка параметра θ; функция оценки f это просто точечная

оценка в функциональном пространстве. Пример: в полиномиальной регрессии мы

либо оцениваем параметр w, либо оцениваем функцию отображения из x в y.

Смещение и дисперсия

Смещение и дисперсия измеряют два разных источника ошибки функции оценки.

Смещение измеряет ожидаемое отклонение от истинного значения функции или

параметра. Дисперсия, с другой стороны, показывает меру отклонения от

ожидаемого значения оценки, которую может вызвать любая конкретная выборка

данных.

Смещение

Смещение определяется следующим

образом:

где ожидаемое значение E(θˆm) для данных (рассматриваемых как выборки из случайной величины) и

θ является истинным базовым значением, используемым для определения

распределения, генерирующего данные.

Оценщик θˆm называется несмещенным, если bias(θˆm)=0, что подразумевает что E(θˆm) = θ.

Дисперсия и Стандартная ошибка

Дисперсия оценки обозначается как Var(θˆ), где случайная величина

является обучающим множеством. Альтернативно, квадратный корень дисперсии

называется стандартной ошибкой, обозначаемой как SE(θˆ). Дисперсия или стандартная ошибка

оценщика показывает меру ожидания того, как оценка, которую мы вычисляем, будет

изменяться по мере того, как мы меняем выборки из базового набора данных,

генерирующих процесс.

Точно так же, как мы хотели бы, чтобы функция оценки имела малое

смещение, мы также стремимся, чтобы у нее была относительно низкая дисперсия.

Давайте теперь рассмотрим некоторые обычно используемые функции оценки.

Оценка Максимального Правдоподобия (MLE)

Оценка максимального правдоподобия может быть определена как метод

оценки параметров (таких как среднее значение или дисперсия) из выборки данных,

так что вероятность получения наблюдаемых данных максимальна.

Рассмотрим набор из m примеров X={x(1),… , x(m)} взятых независимо из неизвестного набора данных,

генерирующих распределение Pdata(x). Пусть Pmodel(x;θ) –

параметрическое семейство распределений вероятностей над тем же пространством,

индексированное параметром θ.

Другими словами, Pmodel(x;θ) отображает любую конфигурацию x в значение, оценивающее истинную

вероятность Pdata(x).

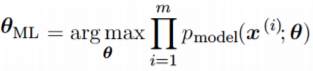

Оценка максимального правдоподобия для θ определяется как:

Поскольку мы предположили, что примеры являются независимыми выборками, приведенное выше

уравнение можно записать в виде:

Эта произведение многих вероятностей может быть неудобным по ряду

причин. В частности, оно склонно к числовой недооценке. Кроме того, чтобы найти

максимумы/минимумы этой функции, мы должны взять производную этой функции от θ и приравнять ее к 0. Поскольку это

произведение членов, нам нужно применить правило цепочки, которое довольно

громоздко. Чтобы получить более удобную, но эквивалентную задачу оптимизации,

можно использовать логарифм вероятности, который не меняет его argmax, но

удобно превращает произведение в сумму, и поскольку логарифм – строго

возрастающая функция (функция натурального логарифма – монотонное

преобразование), это не повлияет на итоговое значение θ.

В итоге, получаем:

Два важных свойства: сходимость и

эффективность

Сходимость. По мере того, как число обучающих выборок приближается к

бесконечности, оценка максимального правдоподобия сходится к истинному значению

параметра.

Эффективность. Способ измерения того, насколько мы близки к истинному

параметру, – это ожидаемая средняя квадратичная ошибка, вычисление квадратичной

разницы между оценочными и истинными значениями параметров, где математическое

ожидание вычисляется над m обучающими выборками из данных, генерирующих

распределение. Эта параметрическая среднеквадратичная ошибка уменьшается с

увеличением m, и для

больших m нижняя

граница неравенства Крамера-Рао показывает, что ни у одной сходящейся функции оценки нет

среднеквадратичной ошибки меньше, чем у оценки максимального правдоподобия.

Именно по причине

сходимости и эффективности, оценка максимального правдоподобия часто считается

предпочтительным оценщиком для машинного обучения.

Когда количество примеров достаточно мало, чтобы привести к

переобучению, стратегии регуляризации, такие как понижающие веса, могут

использоваться для получения смещенной версии оценки максимального

правдоподобия, которая имеет меньшую дисперсию, когда данные обучения

ограничены.

Максимальная апостериорная (MAP) оценка

Согласно байесовскому подходу, можно учесть влияние предварительных

данных на выбор точечной оценки. MAP может использоваться для получения

точечной оценки ненаблюдаемой величины на основе эмпирических данных. Оценка

MAP выбирает точку максимальной апостериорной вероятности (или максимальной

плотности вероятности в более распространенном случае непрерывного θ):

где с правой стороны, log(p(x|θ)) – стандартный член

логарифмической вероятности и log(p(θ)) соответствует изначальному

распределению.

Как и при полном байесовском методе, байесовский MAP имеет преимущество

использования изначальной информации, которой нет

в обучающих данных. Эта дополнительная информация помогает уменьшить дисперсию

для точечной оценки MAP (по сравнению с оценкой MLE). Однако, это происходит ценой повышенного смещения.

Функции потерь

В большинстве обучающих сетей ошибка рассчитывается как разница

между фактическим выходным значением y и прогнозируемым выходным значением ŷ.

Функция, используемая для вычисления этой ошибки, известна как функция потерь,

также часто называемая функцией ошибки или затрат.

До сих пор наше основное внимание уделялось оценке параметров с

помощью MLE или MAP. Причина, по которой мы обсуждали это раньше, заключается в

том, что и MLE, и MAP предоставляют механизм для получения функции потерь.

Давайте рассмотрим некоторые часто используемые функции потерь.

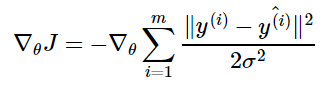

Средняя

квадратичная ошибка (MSE): средняя

квадратичная ошибка является наиболее распространенной функцией потерь. Функция

потерь MSE широко используется в линейной регрессии в качестве показателя

эффективности. Чтобы рассчитать MSE, надо взять разницу между предсказанными

значениями и истинными, возвести ее в квадрат и усреднить по всему набору

данных.

где y(i) – фактический ожидаемый результат, а ŷ(i) – прогноз модели.

Многие функции потерь (затрат), используемые в машинном обучении,

включая MSE, могут быть получены из метода максимального правдоподобия.

Чтобы увидеть, как мы можем вывести функции потерь из MLE или MAP,

требуется некоторая математика. Вы можете пропустить ее и перейти к следующему

разделу.

Получение MSE из MLE

Алгоритм линейной регрессии учится принимать входные данные x и получать выходные значения ŷ. Отображение x в ŷ делается так,

чтобы минимизировать среднеквадратичную ошибку. Но как мы выбрали MSE в

качестве критерия для линейной регрессии? Придем к этому решению с точки зрения

оценки максимального правдоподобия. Вместо того, чтобы производить одно

предсказание ŷ , давайте рассмотрим

модель условного распределения p(y|x).

Можно смоделировать модель

линейной регрессии следующим образом:

мы предполагаем, что у имеет

нормальное распределение с ŷ в качестве

среднего значения распределения и некоторой постоянной σ² в качестве дисперсии, выбранной пользователем. Нормальное

распределения являются разумным выбором во многих случаях. В отсутствие

предварительных данных о том, какое распределение в действительности

соответствует рассматриваемым данным, нормальное распределение является хорошим

выбором по умолчанию.

Вернемся к логарифмической вероятности, определенной ранее:

где ŷ(i) – результат

линейной регрессии на i-м входе, а m – количество обучающих примеров. Мы видим,

что две первые величины являются постоянными, поэтому максимизация

логарифмической вероятности сводится к минимизации MSE:

Таким образом, максимизация логарифмического правдоподобия

относительно θ дает такую же оценку параметров θ, что и минимизация

среднеквадратичной ошибки. Два критерия имеют разные значения, но одинаковое

расположение оптимума. Это оправдывает использование MSE в качестве функции

оценки максимального правдоподобия.

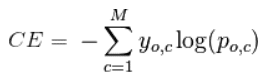

Кросс-энтропия

(или логарифмическая функция потерь – log loss): Кросс-энтропия измеряет расхождение между двумя вероятностными

распределениями. Если кросс-энтропия велика, это означает, что разница между

двумя распределениями велика, а если кросс-энтропия мала, то распределения

похожи друг на друга.

Кросс-энтропия определяется как:

где P – распределение истинных ответов, а Q – распределение

вероятностей прогнозов модели. Можно

показать, что функция кросс-энтропии также получается из MLE, но я не буду

утомлять вас большим количеством математики.

Давайте еще

упростим это для нашей модели с:

• N – количество наблюдений

• M – количество возможных меток класса (собака,

кошка, рыба)

• y – двоичный индикатор (0 или 1) того, является

ли метка класса C правильной классификацией для наблюдения O

• p – прогнозируемая вероятность модели

Бинарная классификация

В случае бинарной классификации (M=2),

формула имеет вид:

При двоичной классификации каждая предсказанная вероятность

сравнивается с фактическим значением класса (0 или 1), и вычисляется оценка,

которая штрафует вероятность на основе расстояния от ожидаемого значения.

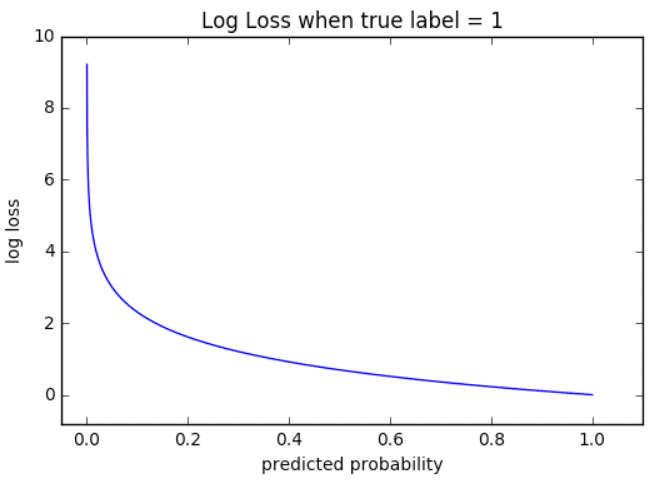

Визуализация

На приведенном ниже графике показан диапазон возможных значений

логистической функции потерь с учетом истинного наблюдения (y = 1). Когда

прогнозируемая вероятность приближается к 1, логистическая функция потерь

медленно уменьшается. Однако при уменьшении прогнозируемой вероятности она быстро возрастает.

Логистическая функция потерь наказывает оба типа ошибок, но

особенно те прогнозы, которые являются достоверными и ошибочными!

Мульти-классовая классификация

В случае мульти-классовой классификации (M>2) мы берем сумму значений логарифмических функций потерь для

каждого прогноза наблюдаемых классов.

Кросс-энтропия для бинарной или двух-классовой задачи

прогнозирования фактически рассчитывается как средняя кросс-энтропия среди всех

примеров. Log loss использует отрицательные

значения логарифма, чтобы обеспечить удобную метрику для сравнения. Этот подход

основан на том, что логарифм чисел <1 возвращает отрицательные значения, что

затрудняет работу при сравнении производительности двух моделей. Вы можете

почитать эту статью, где детально обсуждается функция кросс-энтропии потерь.

Задачи ML и соответствующие функции потерь

Давайте посмотрим, какие обычно используются выходные слои и

функции потерь в задачах машинного обучения:

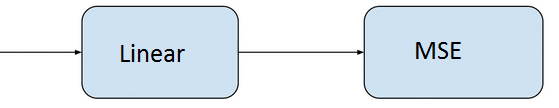

Задача регрессии

Задача, когда

вы прогнозируете вещественное число.

• Конфигурация выходного уровня: один

узел с линейной единицей активации.

• Функция

потерь: средняя квадратическая ошибка (MSE).

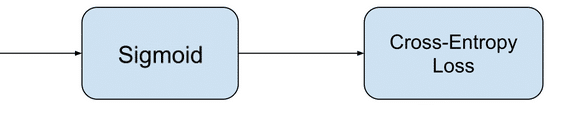

Задача бинарной классификации

Задача состоит в том, чтобы классифицировать пример как

принадлежащий одному из двух классов. Или более точно, задача сформулирована

как предсказание вероятности того, что пример принадлежит первому классу,

например, классу, которому вы присваиваете целочисленное значение 1, тогда как

другому классу присваивается значение 0.

• Конфигурация выходного

уровня: один узел с сигмовидной активационной функцией.

• Функция

потерь: кросс-энтропия, также называемая логарифмической функцией потерь.

Задача мульти-классовой классификации

Эта задача состоит в том, чтобы классифицировать пример как

принадлежащий одному из нескольких классов. Задача сформулирована как

предсказание вероятности того, что пример принадлежит каждому классу.

• Конфигурация выходного уровня: один

узел для каждого класса, использующий функцию активации softmax.

• Функция потерь: кросс-энтропия, также называемая логарифмической функцией потерь.

Рассмотрев оценку и различные функции потерь, давайте перейдем к

роли оптимизаторов в алгоритмах ML.

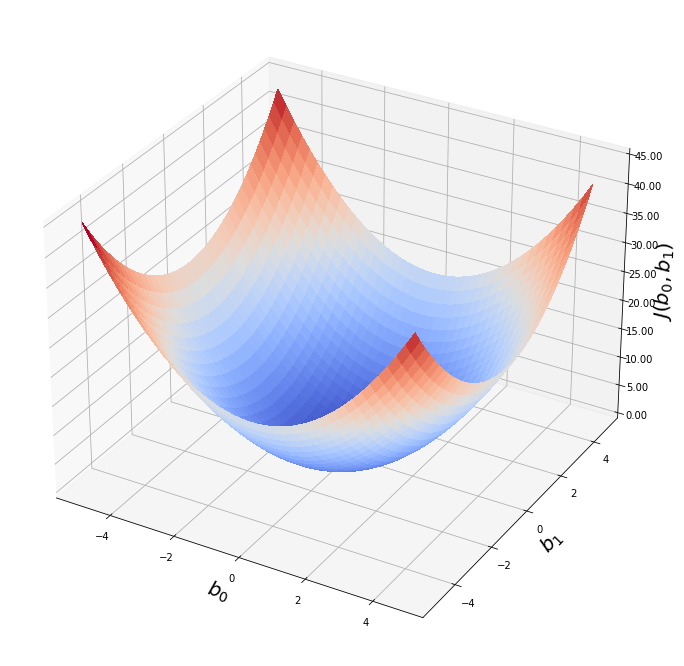

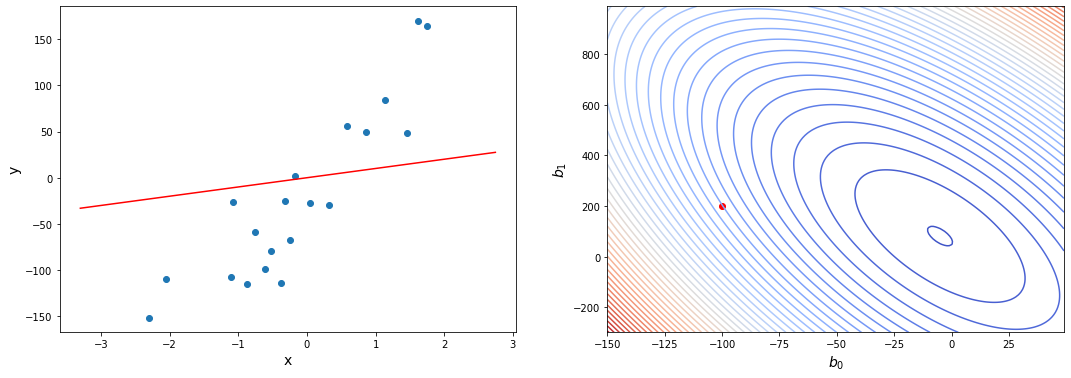

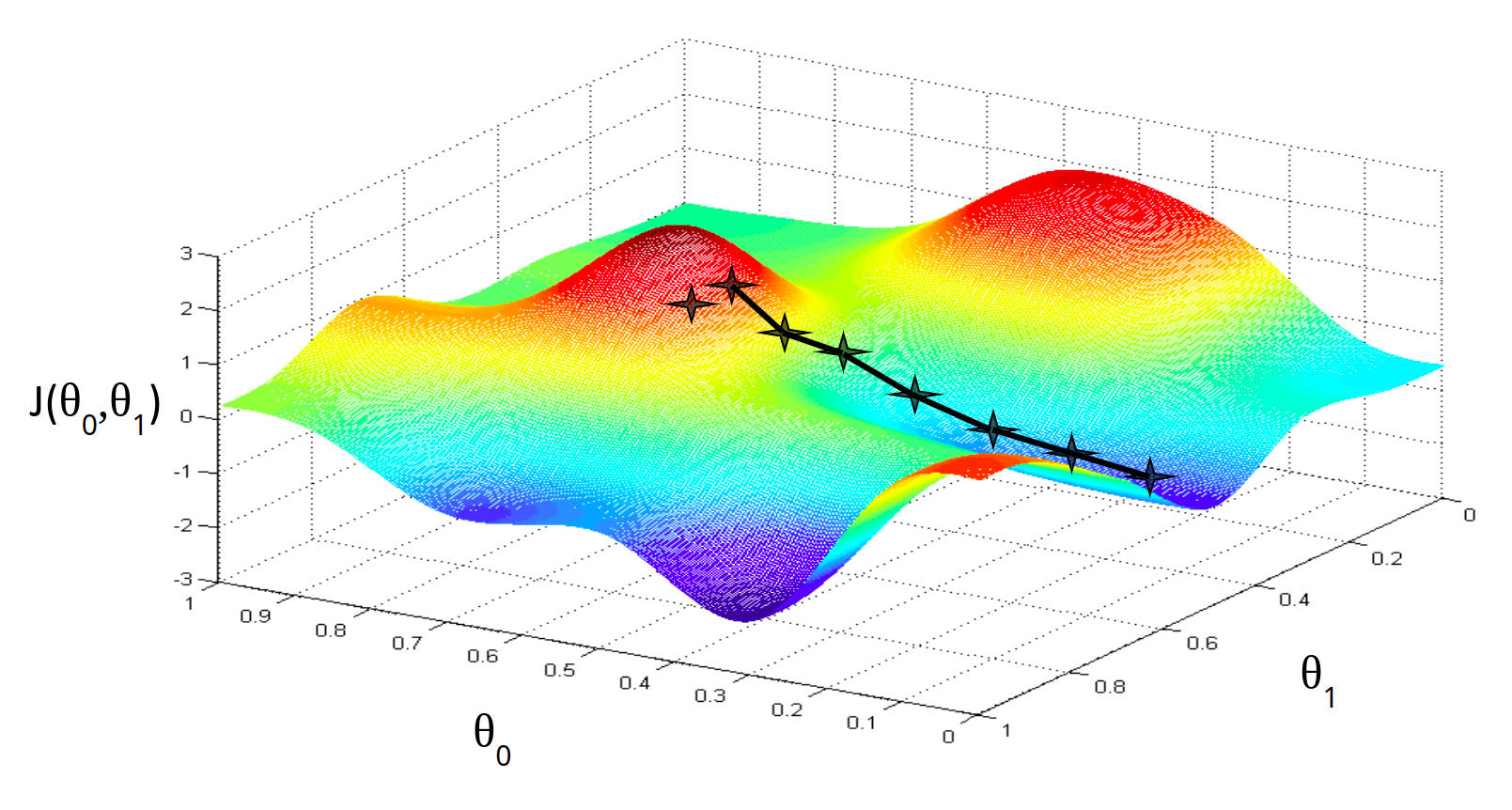

Оптимизаторы

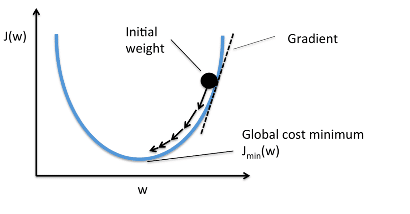

Чтобы свести к минимуму ошибку или потерю в прогнозировании,

модель, используя примеры из обучающей выборки, обновляет параметры модели W. Расчеты

ошибок строятся в зависимости от W и также описываются графиком функции затрат

J(w), поскольку она определяет затраты/наказание модели. Таким образом, минимизация

ошибки также часто называется минимизацией функции затрат.

Но как именно это делается? Используя оптимизаторы.

Оптимизаторы используются для обновления весов и смещений, то есть

внутренних параметров модели, чтобы уменьшить ошибку.

Самым важным методом и основой того, как мы обучаем и оптимизируем

нашу модель, является метод Градиентного Спуска.

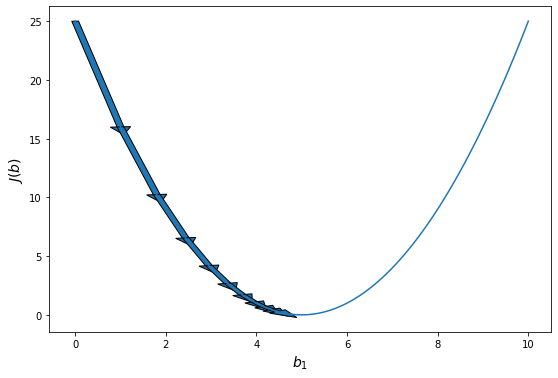

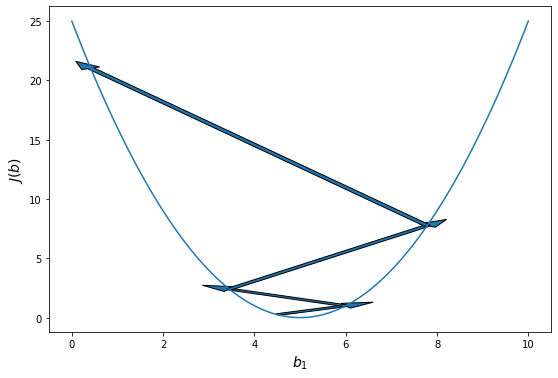

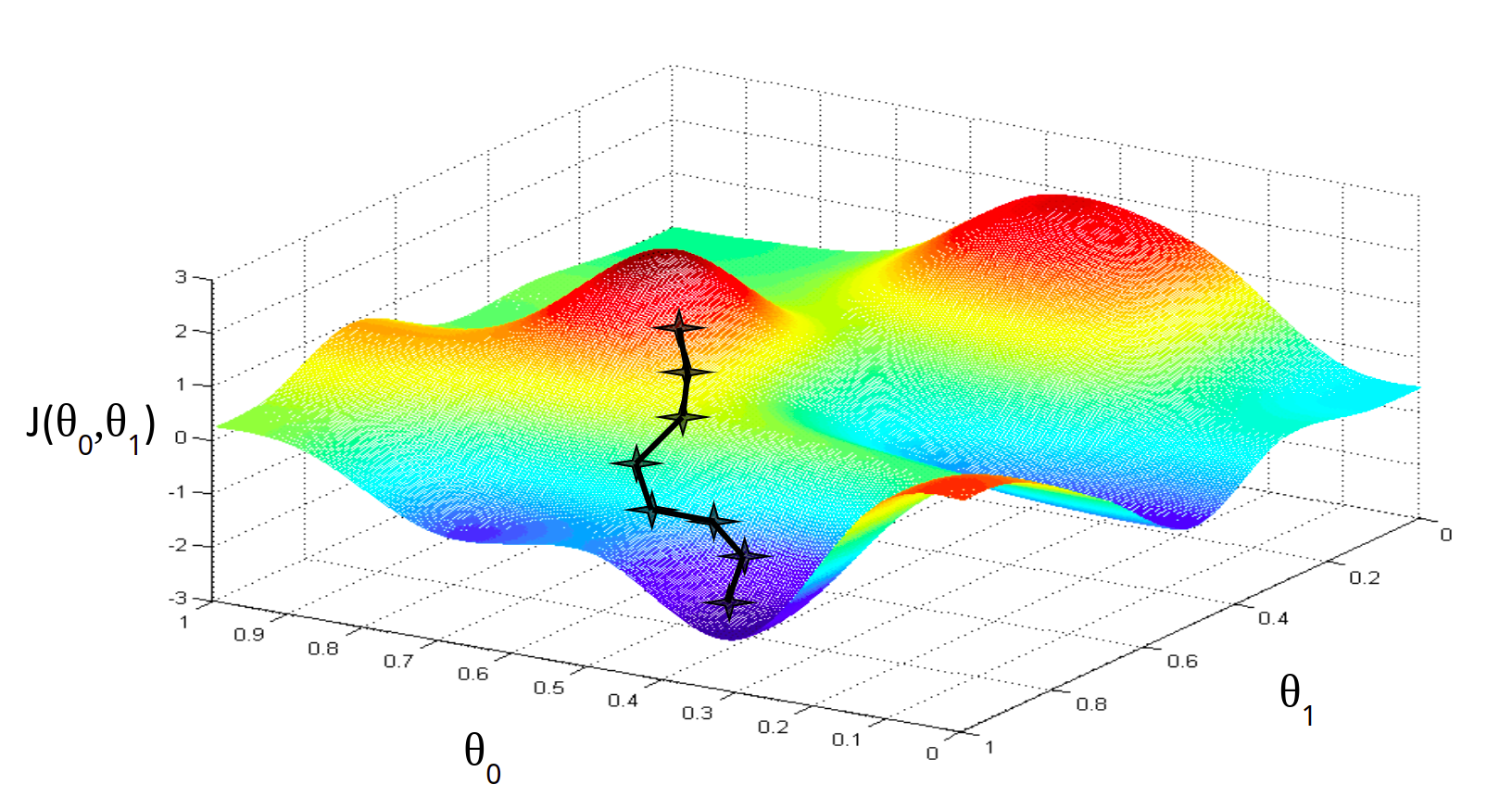

Градиентный Спуск

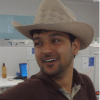

Когда мы строим функцию затрат J(w), это можно представить следующим

образом:

Как видно из кривой, существует значение параметров W, которое

имеет минимальное значение Jmin. Нам нужно найти способ достичь

этого минимального значения.

В алгоритме градиентного спуска мы начинаем со случайных

параметров модели и вычисляем ошибку для каждой итерации обучения, продолжая

обновлять параметры, чтобы приблизиться к минимальным значениям.

Повторяем до достижения минимума:

{

}

В приведенном выше уравнении мы обновляем параметры модели после

каждой итерации. Второй член уравнения вычисляет наклон или градиент кривой на

каждой итерации.

Градиент функции затрат вычисляется как частная производная

функции затрат J по каждому параметру модели Wj, где j принимает

значение числа признаков [1, n]. α – альфа, это скорость обучения, определяющий

как быстро мы хотим двигаться к минимуму. Если α слишком велико, мы можем

проскочить минимум. Если α слишком мало, это приведет к небольшим этапам обучения,

поэтому общее время, затрачиваемое моделью для достижения минимума, будет

больше.

Есть три способа сделать градиентный спуск:

Пакетный

градиентный спуск: использует

все обучающие данные для обновления параметров модели в каждой итерации.

Мини-пакетный градиентный спуск: вместо использования всех данных, мини-пакетный градиентный спуск делит тренировочный набор на меньший размер, называемый партией, и обозначаемый буквой «b». Таким образом, мини-пакет «b» используется для обновления параметров модели на каждой итерации.

Вот некоторые другие часто

используемые Оптимизаторы:

Стохастический

Градиентный Спуск (SGD): обновляет

параметры, используя только один обучающий параметр на каждой итерации. Такой

параметр обычно выбирается случайным образом. Стохастический градиентный спуск

часто предпочтителен для оптимизации функций затрат, когда есть сотни тысяч

обучающих или более параметров, поскольку он будет сходиться быстрее, чем

пакетный градиентный спуск.

Адаград

Адаград адаптирует скорость обучения конкретно к индивидуальным

особенностям: это означает, что некоторые веса в вашем наборе данных будут

отличаться от других. Это работает очень хорошо для разреженных наборов данных,

где пропущено много входных значений. Однако, у Адаграда есть одна серьезная

проблема: адаптивная скорость обучения со временем становится очень маленькой.

Некоторые другие оптимизаторы, описанные ниже, пытаются справиться

с этой проблемой.

RMSprop

RMSprop – это специальная версия Adagrad,

разработанная профессором Джеффри Хинтоном в его

классе нейронных сетей. Вместо того,

чтобы вычислять все градиенты, он вычисляет градиенты только в фиксированном

окне. RMSprop похож на Adaprop, это еще один оптимизатор, который пытается

решить некоторые проблемы, которые Адаград оставляет открытыми.

Адам

Адам означает адаптивную оценку момента и является еще одним способом использования

предыдущих градиентов для вычисления текущих градиентов. Адам также использует

концепцию импульса,

добавляя доли предыдущих градиентов к текущему. Этот оптимизатор получил

довольно широкое распространение и практически принят для использования в

обучающих нейронных сетях.

Вы только что ознакомились с кратким обзором

оптимизаторов. Более подробно об этом можно прочитать здесь.

Я надеюсь,

что после прочтения этой статьи, вы будете лучше понимать что происходит, когда

Вы пишите следующий код:

# loss function: Binary Cross-entropy and optimizer: Adam

model.compile(loss='binary_crossentropy', optimizer='adam')или

# loss function: MSE and optimizer: stochastic gradient descent

model.compile(loss='mean_squared_error', optimizer='sgd')Спасибо за проявленный интерес!

Ссылки:

[1] https://www.deeplearningbook.org/contents/ml.html

[2] https://machinelearningmastery.com/loss-and-loss-functions-for-training-deep-learning-neural-networks/

[3] https://blog.algorithmia.com/introduction-to-optimizers/

[4] https://jhui.github.io/2017/01/05/Deep-learning-Information-theory/

[5] https://blog.algorithmia.com/introduction-to-loss-functions/

[6] https://gombru.github.io/2018/05/23/cross_entropy_loss/

[7] https://www.kdnuggets.com/2018/04/right-metric-evaluating-machine-learning-models-1.html

[8] https://rohanvarma.me/Loss-Functions/

[9] http://blog.christianperone.com/2019/01/mle/

В статистика, то среднеквадратичная ошибка (MSE)[1][2] или среднеквадратическое отклонение (MSD) из оценщик (процедуры оценки ненаблюдаемой величины) измеряет средний квадратов ошибки — то есть средний квадрат разницы между оценочными и фактическими значениями. MSE — это функция риска, соответствующий ожидаемое значение квадрата ошибки потери. Тот факт, что MSE почти всегда строго положительный (а не нулевой), объясняется тем, что случайность или потому что оценщик не учитывает информацию это может дать более точную оценку.[3]

MSE — это мера качества оценки — она всегда неотрицательна, а значения, близкие к нулю, лучше.

МСЭ — второй момент (о происхождении) ошибки и, таким образом, включает в себя как отклонение оценщика (насколько разбросаны оценки от одного образец данных другому) и его предвзятость (насколько далеко среднее оценочное значение от истинного значения). Для объективный оценщик, MSE — это дисперсия оценки. Как и дисперсия, MSE имеет те же единицы измерения, что и квадрат оцениваемой величины. По аналогии с стандартное отклонение, извлечение квадратного корня из MSE дает среднеквадратичную ошибку или среднеквадратичное отклонение (RMSE или RMSD), который имеет те же единицы, что и оцениваемое количество; для несмещенной оценки RMSE — это квадратный корень из отклонение, известный как стандартная ошибка.

Определение и основные свойства

MSE либо оценивает качество предсказатель (т.е. функция, отображающая произвольные входные данные в выборку значений некоторых случайная переменная ) или оценщик (т.е. математическая функция отображение образец данных для оценки параметр из численность населения из которого берутся данные). Определение MSE различается в зависимости от того, описывается ли предсказатель или оценщик.

Предсказатель

Если вектор

Другими словами, MSE — это иметь в виду

В матрица обозначение

куда

MSE также можно вычислить на q точки данных, которые не использовались при оценке модели, либо потому, что они были задержаны для этой цели, либо потому, что эти данные были получены заново. В этом процессе (известном как перекрестная проверка ), MSE часто называют среднеквадратичная ошибка прогноза, и вычисляется как

Оценщик

MSE оценщика

Это определение зависит от неизвестного параметра, но MSE априори свойство оценщика. MSE может быть функцией неизвестных параметров, и в этом случае любой оценщик MSE на основе оценок этих параметров будет функцией данных (и, следовательно, случайной величиной). Если оценщик

MSE можно записать как сумму отклонение оценщика и квадрата предвзятость оценщика, обеспечивая полезный способ вычисления MSE и подразумевая, что в случае несмещенных оценок MSE и дисперсия эквивалентны.[4]

Доказательство отношения дисперсии и предвзятости

- В качестве альтернативы у нас есть

Но в реальном случае моделирования MSE можно описать как добавление дисперсии модели, систематической ошибки модели и неснижаемой неопределенности. Согласно соотношению, MSE оценщиков может быть просто использована для эффективность сравнение, которое включает информацию о дисперсии и смещении оценки. Это называется критерием MSE.

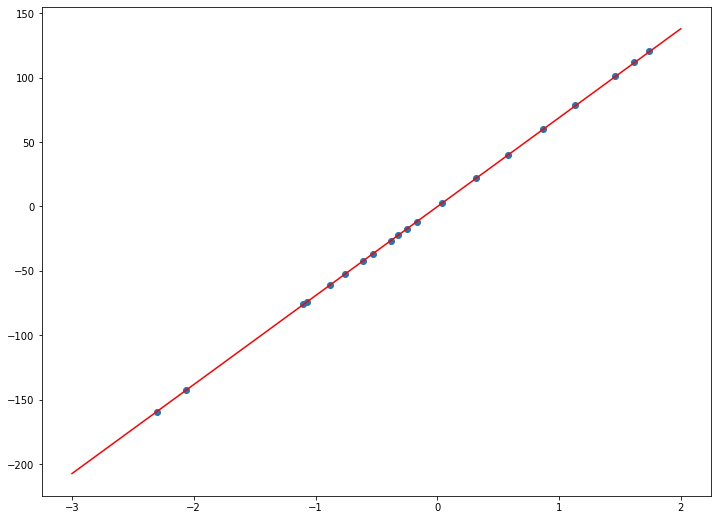

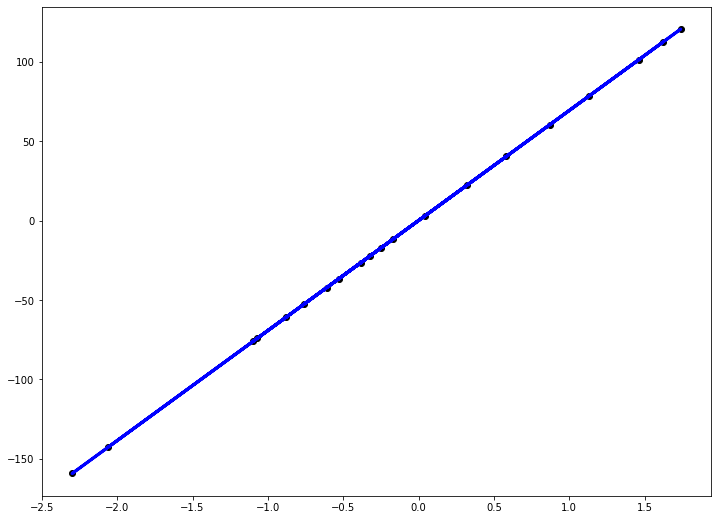

В регрессе

В регрессивный анализ, построение графиков — более естественный способ просмотра общей тенденции всех данных. Среднее значение расстояния от каждой точки до прогнозируемой регрессионной модели может быть вычислено и показано как среднеквадратичная ошибка. Возведение в квадрат критически важно для уменьшения сложности с отрицательными знаками. Чтобы свести к минимуму MSE, модель может быть более точной, что означает, что модель ближе к фактическим данным. Одним из примеров линейной регрессии с использованием этого метода является метод наименьших квадратов —Который оценивает соответствие модели линейной регрессии модели двумерный набор данных[5], но чье ограничение связано с известным распределением данных.

Период, термин среднеквадратичная ошибка иногда используется для обозначения объективной оценки дисперсии ошибки: остаточная сумма квадратов делится на количество степени свободы. Это определение известной вычисленной величины отличается от приведенного выше определения вычисленной MSE предиктора тем, что используется другой знаменатель. Знаменатель — это размер выборки, уменьшенный на количество параметров модели, оцененных на основе тех же данных, (н-р) за п регрессоры или (п-п-1) если используется перехват (см. ошибки и остатки в статистике Больше подробностей).[6] Хотя MSE (как определено в этой статье) не является объективной оценкой дисперсии ошибки, она последовательный, учитывая непротиворечивость предсказателя.

В регрессионном анализе «среднеквадратичная ошибка», часто называемая среднеквадратичная ошибка прогноза или «среднеквадратичная ошибка вне выборки», также может относиться к среднему значению квадратичные отклонения прогнозов на основе истинных значений в тестовом пространстве вне выборки, сгенерированных моделью, оцененной в конкретном пространстве выборки. Это также известная вычисляемая величина, которая зависит от образца и тестового пространства вне образца.

Примеры

Иметь в виду

Предположим, у нас есть случайная выборка размера

ожидаемое значение которого равно истинному среднему значению

куда

Для Гауссово распределение, это лучший объективный оценщик (то есть с самой низкой MSE среди всех несмещенных оценок), но не, скажем, для равномерное распределение.

Дисперсия

Обычной оценкой дисперсии является исправлено выборочная дисперсия:

Это объективно (его ожидаемое значение

куда

Однако можно использовать другие оценки для

затем рассчитываем:

Это сводится к минимуму, когда

Для Гауссово распределение, куда

Далее, хотя исправленная дисперсия выборки является лучший объективный оценщик (минимальная среднеквадратичная ошибка среди несмещенных оценок) дисперсии для гауссовских распределений, если распределение не является гауссовым, то даже среди несмещенных оценок лучшая несмещенная оценка дисперсии может не быть

Гауссово распределение

В следующей таблице приведены несколько оценок истинных параметров популяции, μ и σ.2, для гауссова случая.[8]

| Истинное значение | Оценщик | Среднеквадратичная ошибка |

|---|---|---|

|

= несмещенная оценка Средняя численность населения, = несмещенная оценка Средняя численность населения,  |

|

|

= несмещенная оценка дисперсия населения, = несмещенная оценка дисперсия населения,  |

|

|

= смещенная оценка дисперсия населения, = смещенная оценка дисперсия населения,  |

|

|

= смещенная оценка дисперсия населения, = смещенная оценка дисперсия населения,  |

|

Интерпретация

MSE равна нулю, что означает, что оценщик

Значения MSE могут использоваться для сравнительных целей. Два и более статистические модели можно сравнить, используя их MSE — как меру того, насколько хорошо они объясняют данный набор наблюдений: несмещенная оценка (рассчитанная на основе статистической модели) с наименьшей дисперсией среди всех несмещенных оценок — это оценка лучший объективный оценщик или MVUE (несмещенная оценка минимальной дисперсии).

Обе линейная регрессия методы, такие как дисперсионный анализ оценить MSE как часть анализа и использовать оценочную MSE для определения Статистическая значимость изучаемых факторов или предикторов. Цель экспериментальная конструкция состоит в том, чтобы построить эксперименты таким образом, чтобы при анализе наблюдений MSE была близка к нулю относительно величины по крайней мере одного из оцененных эффектов лечения.

В односторонний дисперсионный анализ, MSE можно вычислить путем деления суммы квадратов ошибок и степени свободы. Кроме того, значение f — это отношение среднего квадрата обработки и MSE.

MSE также используется в нескольких пошаговая регрессия методы как часть определения того, сколько предикторов из набора кандидатов включить в модель для данного набора наблюдений.

Приложения

- Минимизация MSE является ключевым критерием при выборе оценщиков: см. минимальная среднеквадратичная ошибка. Среди несмещенных оценщиков минимизация MSE эквивалентна минимизации дисперсии, а оценщик, который делает это, является несмещенная оценка минимальной дисперсии. Однако смещенная оценка может иметь более низкую MSE; видеть систематическая ошибка оценки.

- В статистическое моделирование MSE может представлять разницу между фактическими наблюдениями и значениями наблюдений, предсказанными моделью. В этом контексте он используется для определения степени, в которой модель соответствует данным, а также возможности удаления некоторых объясняющих переменных без значительного ущерба для прогнозирующей способности модели.

- В прогнозирование и прогноз, то Оценка Бриера это мера умение прогнозировать на основе MSE.

Функция потерь

Квадратичная потеря ошибок — одна из наиболее широко используемых функции потерь в статистике[нужна цитата ], хотя его широкое использование проистекает больше из математического удобства, чем из соображений реальных потерь в приложениях. Карл Фридрих Гаусс, который ввел использование среднеквадратичной ошибки, сознавал ее произвол и был согласен с возражениями против нее на этих основаниях.[3] Математические преимущества среднеквадратичной ошибки особенно очевидны при ее использовании при анализе производительности линейная регрессия, поскольку он позволяет разделить вариацию в наборе данных на вариации, объясняемые моделью, и вариации, объясняемые случайностью.

Критика

Использование среднеквадратичной ошибки без вопросов подвергалось критике со стороны теоретик решений Джеймс Бергер. Среднеквадратичная ошибка — это отрицательное значение ожидаемого значения одного конкретного вспомогательная функция, квадратичная функция полезности, которая может не подходить для использования в данном наборе обстоятельств. Однако есть некоторые сценарии, в которых среднеквадратичная ошибка может служить хорошим приближением к функции потерь, естественным образом возникающей в приложении.[9]

подобно отклонение, среднеквадратичная ошибка имеет тот недостаток, что выбросы.[10] Это результат возведения в квадрат каждого члена, который фактически дает больший вес большим ошибкам, чем малым. Это свойство, нежелательное для многих приложений, заставило исследователей использовать альтернативы, такие как средняя абсолютная ошибка, или основанные на медиана.

Смотрите также

- Компромисс смещения и дисперсии

- Оценщик Ходжеса

- Оценка Джеймса – Стейна

- Средняя процентная ошибка

- Среднеквадратичная ошибка квантования

- Среднеквадратичное взвешенное отклонение

- Среднеквадратичное смещение

- Среднеквадратичная ошибка прогноза

- Минимальная среднеквадратичная ошибка

- Оценщик минимальной среднеквадратичной ошибки

- Пиковое отношение сигнал / шум

Примечания

- ^ Это может быть доказано Неравенство Дженсена следующим образом. Четвертый центральный момент является верхней границей квадрата дисперсии, так что наименьшее значение для их отношения равно единице, следовательно, наименьшее значение для избыточный эксцесс равно −2, что достигается, например, Бернулли с п=1/2.

Рекомендации

- ^ а б «Список вероятностных и статистических символов». Математическое хранилище. 2020-04-26. Получено 2020-09-12.

- ^ а б «Среднеквадратичная ошибка (MSE)». www.probabilitycourse.com. Получено 2020-09-12.

- ^ а б Lehmann, E. L .; Казелла, Джордж (1998). Теория точечного оценивания (2-е изд.). Нью-Йорк: Спрингер. ISBN 978-0-387-98502-2. Г-Н 1639875.

- ^ Вакерли, Деннис; Менденхолл, Уильям; Шеаффер, Ричард Л. (2008). Математическая статистика с приложениями (7-е изд.). Белмонт, Калифорния, США: Высшее образование Томсона. ISBN 978-0-495-38508-0.

- ^ Современное введение в вероятность и статистику: понимание, почему и как. Деккинг, Мишель, 1946-. Лондон: Спрингер. 2005 г. ISBN 978-1-85233-896-1. OCLC 262680588.CS1 maint: другие (ссылка на сайт)

- ^ Стил, Р.Г.Д., и Торри, Дж. Х., Принципы и процедуры статистики с особым акцентом на биологические науки., Макгроу Хилл, 1960, стр.288.

- ^ Настроение, А .; Graybill, F .; Боэс, Д. (1974). Введение в теорию статистики (3-е изд.). Макгроу-Хилл. п.229.

- ^ ДеГрут, Моррис Х. (1980). вероятность и статистика (2-е изд.). Эддисон-Уэсли.

- ^ Бергер, Джеймс О. (1985). «2.4.2 Некоторые стандартные функции потерь». Статистическая теория принятия решений и байесовский анализ (2-е изд.). Нью-Йорк: Springer-Verlag. п.60. ISBN 978-0-387-96098-2. Г-Н 0804611.

- ^ Бермехо, Серхио; Кабестани, Джоан (2001). «Ориентированный анализ главных компонентов для классификаторов с большой маржой». Нейронные сети. 14 (10): 1447–1461. Дои:10.1016 / S0893-6080 (01) 00106-X. PMID 11771723.

Адаптированный перевод прекрасной статьи энтузиаста технологий машинного обучения Javaid Nabi.

Чтобы понимать как алгоритм машинного обучения учится предсказывать результаты на основе данных, важно разобраться в основных концепциях и понятиях, используемых при обучении алгоритма.

Функции оценки

В контексте технологии машинного обучения, оценка – это

статистический термин для нахождения некоторого приближения неизвестного

параметра на основе некоторых данных. Точечная

оценка – это попытка найти единственное лучшее приближение некоторого

количества интересующих нас параметров. Или на более формальном языке математической статистики — точечная оценка это число, оцениваемое на основе наблюдений,

предположительно близкое к оцениваемому параметру.

Под количеством

интересующих параметров обычно подразумевается:

• Один параметр

• Вектор параметров – например, веса в линейной

регрессии

• Целая функция

Точечная оценка

Чтобы отличать оценки параметров от их истинного значения, представим точечную оценку параметра θ как θˆ. Пусть {x(1), x(2), .. x(m)} будут m независимыми и одинаково распределенными величинами. Тогда точечная оценка может быть записана как некоторая функция этих величин:

Такое определение точечной оценки является очень общим и предоставляет разработчику большую свободу действий. Почти любая функция, таким образом, может рассматриваться как оценщик, но хороший оценщик – это функция, значения которой близки к истинному базовому значению θ, которое сгенерированно обучающими данными.

Точечная оценка также может относиться к оценке взаимосвязи между

входными и целевыми переменными, в этом случае чаще называемой функцией оценки.

Функция оценки

Задача, решаемая машинным обучением, заключается в попытке

предсказать переменную y по

заданному входному вектору x. Мы

предполагаем, что существует функция f(x), которая описывает приблизительную

связь между y и x. Например, можно предположить, что y = f(x) + ε, где ε обозначает

часть y, которая явно не

предсказывается входным вектором x.

При оценке функций нас интересует приближение f с помощью модели или оценки fˆ.

Функция оценки в действительности это тоже самое, что оценка параметра θ; функция оценки f это просто точечная

оценка в функциональном пространстве. Пример: в полиномиальной регрессии мы

либо оцениваем параметр w, либо оцениваем функцию отображения из x в y.

Смещение и дисперсия

Смещение и дисперсия измеряют два разных источника ошибки функции оценки.

Смещение измеряет ожидаемое отклонение от истинного значения функции или

параметра. Дисперсия, с другой стороны, показывает меру отклонения от

ожидаемого значения оценки, которую может вызвать любая конкретная выборка

данных.

Смещение

Смещение определяется следующим

образом:

где ожидаемое значение E(θˆm) для данных (рассматриваемых как выборки из случайной величины) и

θ является истинным базовым значением, используемым для определения

распределения, генерирующего данные.

Оценщик θˆm называется несмещенным, если bias(θˆm)=0, что подразумевает что E(θˆm) = θ.

Дисперсия и Стандартная ошибка

Дисперсия оценки обозначается как Var(θˆ), где случайная величина

является обучающим множеством. Альтернативно, квадратный корень дисперсии

называется стандартной ошибкой, обозначаемой как SE(θˆ). Дисперсия или стандартная ошибка

оценщика показывает меру ожидания того, как оценка, которую мы вычисляем, будет

изменяться по мере того, как мы меняем выборки из базового набора данных,

генерирующих процесс.

Точно так же, как мы хотели бы, чтобы функция оценки имела малое

смещение, мы также стремимся, чтобы у нее была относительно низкая дисперсия.

Давайте теперь рассмотрим некоторые обычно используемые функции оценки.

Оценка Максимального Правдоподобия (MLE)

Оценка максимального правдоподобия может быть определена как метод

оценки параметров (таких как среднее значение или дисперсия) из выборки данных,

так что вероятность получения наблюдаемых данных максимальна.

Рассмотрим набор из m примеров X={x(1),… , x(m)} взятых независимо из неизвестного набора данных,

генерирующих распределение Pdata(x). Пусть Pmodel(x;θ) –

параметрическое семейство распределений вероятностей над тем же пространством,

индексированное параметром θ.

Другими словами, Pmodel(x;θ) отображает любую конфигурацию x в значение, оценивающее истинную

вероятность Pdata(x).

Оценка максимального правдоподобия для θ определяется как:

Поскольку мы предположили, что примеры являются независимыми выборками, приведенное выше

уравнение можно записать в виде:

Эта произведение многих вероятностей может быть неудобным по ряду

причин. В частности, оно склонно к числовой недооценке. Кроме того, чтобы найти

максимумы/минимумы этой функции, мы должны взять производную этой функции от θ и приравнять ее к 0. Поскольку это

произведение членов, нам нужно применить правило цепочки, которое довольно

громоздко. Чтобы получить более удобную, но эквивалентную задачу оптимизации,

можно использовать логарифм вероятности, который не меняет его argmax, но

удобно превращает произведение в сумму, и поскольку логарифм – строго

возрастающая функция (функция натурального логарифма – монотонное

преобразование), это не повлияет на итоговое значение θ.

В итоге, получаем:

Два важных свойства: сходимость и

эффективность

Сходимость. По мере того, как число обучающих выборок приближается к

бесконечности, оценка максимального правдоподобия сходится к истинному значению

параметра.

Эффективность. Способ измерения того, насколько мы близки к истинному

параметру, – это ожидаемая средняя квадратичная ошибка, вычисление квадратичной

разницы между оценочными и истинными значениями параметров, где математическое

ожидание вычисляется над m обучающими выборками из данных, генерирующих

распределение. Эта параметрическая среднеквадратичная ошибка уменьшается с

увеличением m, и для

больших m нижняя

граница неравенства Крамера-Рао показывает, что ни у одной сходящейся функции оценки нет

среднеквадратичной ошибки меньше, чем у оценки максимального правдоподобия.

Именно по причине

сходимости и эффективности, оценка максимального правдоподобия часто считается

предпочтительным оценщиком для машинного обучения.

Когда количество примеров достаточно мало, чтобы привести к

переобучению, стратегии регуляризации, такие как понижающие веса, могут

использоваться для получения смещенной версии оценки максимального

правдоподобия, которая имеет меньшую дисперсию, когда данные обучения

ограничены.

Максимальная апостериорная (MAP) оценка

Согласно байесовскому подходу, можно учесть влияние предварительных

данных на выбор точечной оценки. MAP может использоваться для получения

точечной оценки ненаблюдаемой величины на основе эмпирических данных. Оценка

MAP выбирает точку максимальной апостериорной вероятности (или максимальной

плотности вероятности в более распространенном случае непрерывного θ):

где с правой стороны, log(p(x|θ)) – стандартный член

логарифмической вероятности и log(p(θ)) соответствует изначальному

распределению.

Как и при полном байесовском методе, байесовский MAP имеет преимущество

использования изначальной информации, которой нет

в обучающих данных. Эта дополнительная информация помогает уменьшить дисперсию

для точечной оценки MAP (по сравнению с оценкой MLE). Однако, это происходит ценой повышенного смещения.

Функции потерь

В большинстве обучающих сетей ошибка рассчитывается как разница

между фактическим выходным значением y и прогнозируемым выходным значением ŷ.

Функция, используемая для вычисления этой ошибки, известна как функция потерь,

также часто называемая функцией ошибки или затрат.

До сих пор наше основное внимание уделялось оценке параметров с

помощью MLE или MAP. Причина, по которой мы обсуждали это раньше, заключается в

том, что и MLE, и MAP предоставляют механизм для получения функции потерь.

Давайте рассмотрим некоторые часто используемые функции потерь.

Средняя

квадратичная ошибка (MSE): средняя

квадратичная ошибка является наиболее распространенной функцией потерь. Функция

потерь MSE широко используется в линейной регрессии в качестве показателя

эффективности. Чтобы рассчитать MSE, надо взять разницу между предсказанными

значениями и истинными, возвести ее в квадрат и усреднить по всему набору

данных.

где y(i) – фактический ожидаемый результат, а ŷ(i) – прогноз модели.

Многие функции потерь (затрат), используемые в машинном обучении,

включая MSE, могут быть получены из метода максимального правдоподобия.

Чтобы увидеть, как мы можем вывести функции потерь из MLE или MAP,

требуется некоторая математика. Вы можете пропустить ее и перейти к следующему

разделу.

Получение MSE из MLE

Алгоритм линейной регрессии учится принимать входные данные x и получать выходные значения ŷ. Отображение x в ŷ делается так,

чтобы минимизировать среднеквадратичную ошибку. Но как мы выбрали MSE в

качестве критерия для линейной регрессии? Придем к этому решению с точки зрения

оценки максимального правдоподобия. Вместо того, чтобы производить одно

предсказание ŷ , давайте рассмотрим

модель условного распределения p(y|x).

Можно смоделировать модель

линейной регрессии следующим образом:

мы предполагаем, что у имеет

нормальное распределение с ŷ в качестве

среднего значения распределения и некоторой постоянной σ² в качестве дисперсии, выбранной пользователем. Нормальное

распределения являются разумным выбором во многих случаях. В отсутствие

предварительных данных о том, какое распределение в действительности

соответствует рассматриваемым данным, нормальное распределение является хорошим

выбором по умолчанию.

Вернемся к логарифмической вероятности, определенной ранее:

где ŷ(i) – результат

линейной регрессии на i-м входе, а m – количество обучающих примеров. Мы видим,

что две первые величины являются постоянными, поэтому максимизация

логарифмической вероятности сводится к минимизации MSE:

Таким образом, максимизация логарифмического правдоподобия

относительно θ дает такую же оценку параметров θ, что и минимизация

среднеквадратичной ошибки. Два критерия имеют разные значения, но одинаковое

расположение оптимума. Это оправдывает использование MSE в качестве функции

оценки максимального правдоподобия.

Кросс-энтропия

(или логарифмическая функция потерь – log loss): Кросс-энтропия измеряет расхождение между двумя вероятностными

распределениями. Если кросс-энтропия велика, это означает, что разница между

двумя распределениями велика, а если кросс-энтропия мала, то распределения

похожи друг на друга.

Кросс-энтропия определяется как:

где P – распределение истинных ответов, а Q – распределение

вероятностей прогнозов модели. Можно

показать, что функция кросс-энтропии также получается из MLE, но я не буду

утомлять вас большим количеством математики.

Давайте еще

упростим это для нашей модели с:

• N – количество наблюдений

• M – количество возможных меток класса (собака,

кошка, рыба)

• y – двоичный индикатор (0 или 1) того, является

ли метка класса C правильной классификацией для наблюдения O

• p – прогнозируемая вероятность модели

Бинарная классификация

В случае бинарной классификации (M=2),

формула имеет вид:

При двоичной классификации каждая предсказанная вероятность

сравнивается с фактическим значением класса (0 или 1), и вычисляется оценка,

которая штрафует вероятность на основе расстояния от ожидаемого значения.

Визуализация

На приведенном ниже графике показан диапазон возможных значений

логистической функции потерь с учетом истинного наблюдения (y = 1). Когда

прогнозируемая вероятность приближается к 1, логистическая функция потерь

медленно уменьшается. Однако при уменьшении прогнозируемой вероятности она быстро возрастает.

Логистическая функция потерь наказывает оба типа ошибок, но

особенно те прогнозы, которые являются достоверными и ошибочными!

Мульти-классовая классификация

В случае мульти-классовой классификации (M>2) мы берем сумму значений логарифмических функций потерь для

каждого прогноза наблюдаемых классов.

Кросс-энтропия для бинарной или двух-классовой задачи

прогнозирования фактически рассчитывается как средняя кросс-энтропия среди всех

примеров. Log loss использует отрицательные

значения логарифма, чтобы обеспечить удобную метрику для сравнения. Этот подход

основан на том, что логарифм чисел <1 возвращает отрицательные значения, что

затрудняет работу при сравнении производительности двух моделей. Вы можете

почитать эту статью, где детально обсуждается функция кросс-энтропии потерь.

Задачи ML и соответствующие функции потерь

Давайте посмотрим, какие обычно используются выходные слои и

функции потерь в задачах машинного обучения:

Задача регрессии

Задача, когда

вы прогнозируете вещественное число.

• Конфигурация выходного уровня: один

узел с линейной единицей активации.

• Функция

потерь: средняя квадратическая ошибка (MSE).

Задача бинарной классификации

Задача состоит в том, чтобы классифицировать пример как

принадлежащий одному из двух классов. Или более точно, задача сформулирована

как предсказание вероятности того, что пример принадлежит первому классу,

например, классу, которому вы присваиваете целочисленное значение 1, тогда как

другому классу присваивается значение 0.

• Конфигурация выходного

уровня: один узел с сигмовидной активационной функцией.

• Функция

потерь: кросс-энтропия, также называемая логарифмической функцией потерь.

Задача мульти-классовой классификации

Эта задача состоит в том, чтобы классифицировать пример как

принадлежащий одному из нескольких классов. Задача сформулирована как

предсказание вероятности того, что пример принадлежит каждому классу.

• Конфигурация выходного уровня: один

узел для каждого класса, использующий функцию активации softmax.

• Функция потерь: кросс-энтропия, также называемая логарифмической функцией потерь.

Рассмотрев оценку и различные функции потерь, давайте перейдем к

роли оптимизаторов в алгоритмах ML.

Оптимизаторы

Чтобы свести к минимуму ошибку или потерю в прогнозировании,

модель, используя примеры из обучающей выборки, обновляет параметры модели W. Расчеты

ошибок строятся в зависимости от W и также описываются графиком функции затрат

J(w), поскольку она определяет затраты/наказание модели. Таким образом, минимизация

ошибки также часто называется минимизацией функции затрат.

Но как именно это делается? Используя оптимизаторы.

Оптимизаторы используются для обновления весов и смещений, то есть

внутренних параметров модели, чтобы уменьшить ошибку.

Самым важным методом и основой того, как мы обучаем и оптимизируем

нашу модель, является метод Градиентного Спуска.

Градиентный Спуск

Когда мы строим функцию затрат J(w), это можно представить следующим

образом:

Как видно из кривой, существует значение параметров W, которое

имеет минимальное значение Jmin. Нам нужно найти способ достичь

этого минимального значения.

В алгоритме градиентного спуска мы начинаем со случайных

параметров модели и вычисляем ошибку для каждой итерации обучения, продолжая

обновлять параметры, чтобы приблизиться к минимальным значениям.

Повторяем до достижения минимума:

{

}

В приведенном выше уравнении мы обновляем параметры модели после

каждой итерации. Второй член уравнения вычисляет наклон или градиент кривой на

каждой итерации.

Градиент функции затрат вычисляется как частная производная

функции затрат J по каждому параметру модели Wj, где j принимает

значение числа признаков [1, n]. α – альфа, это скорость обучения, определяющий

как быстро мы хотим двигаться к минимуму. Если α слишком велико, мы можем

проскочить минимум. Если α слишком мало, это приведет к небольшим этапам обучения,

поэтому общее время, затрачиваемое моделью для достижения минимума, будет

больше.

Есть три способа сделать градиентный спуск:

Пакетный

градиентный спуск: использует

все обучающие данные для обновления параметров модели в каждой итерации.

Мини-пакетный градиентный спуск: вместо использования всех данных, мини-пакетный градиентный спуск делит тренировочный набор на меньший размер, называемый партией, и обозначаемый буквой «b». Таким образом, мини-пакет «b» используется для обновления параметров модели на каждой итерации.

Вот некоторые другие часто

используемые Оптимизаторы:

Стохастический

Градиентный Спуск (SGD): обновляет

параметры, используя только один обучающий параметр на каждой итерации. Такой

параметр обычно выбирается случайным образом. Стохастический градиентный спуск

часто предпочтителен для оптимизации функций затрат, когда есть сотни тысяч

обучающих или более параметров, поскольку он будет сходиться быстрее, чем

пакетный градиентный спуск.

Адаград

Адаград адаптирует скорость обучения конкретно к индивидуальным

особенностям: это означает, что некоторые веса в вашем наборе данных будут

отличаться от других. Это работает очень хорошо для разреженных наборов данных,

где пропущено много входных значений. Однако, у Адаграда есть одна серьезная

проблема: адаптивная скорость обучения со временем становится очень маленькой.

Некоторые другие оптимизаторы, описанные ниже, пытаются справиться

с этой проблемой.

RMSprop

RMSprop – это специальная версия Adagrad,

разработанная профессором Джеффри Хинтоном в его

классе нейронных сетей. Вместо того,

чтобы вычислять все градиенты, он вычисляет градиенты только в фиксированном

окне. RMSprop похож на Adaprop, это еще один оптимизатор, который пытается

решить некоторые проблемы, которые Адаград оставляет открытыми.

Адам

Адам означает адаптивную оценку момента и является еще одним способом использования

предыдущих градиентов для вычисления текущих градиентов. Адам также использует

концепцию импульса,

добавляя доли предыдущих градиентов к текущему. Этот оптимизатор получил

довольно широкое распространение и практически принят для использования в

обучающих нейронных сетях.

Вы только что ознакомились с кратким обзором

оптимизаторов. Более подробно об этом можно прочитать здесь.

Я надеюсь,

что после прочтения этой статьи, вы будете лучше понимать что происходит, когда

Вы пишите следующий код:

# loss function: Binary Cross-entropy and optimizer: Adam

model.compile(loss='binary_crossentropy', optimizer='adam')или

# loss function: MSE and optimizer: stochastic gradient descent

model.compile(loss='mean_squared_error', optimizer='sgd')Спасибо за проявленный интерес!

Ссылки:

[1] https://www.deeplearningbook.org/contents/ml.html

[2] https://machinelearningmastery.com/loss-and-loss-functions-for-training-deep-learning-neural-networks/

[3] https://blog.algorithmia.com/introduction-to-optimizers/

[4] https://jhui.github.io/2017/01/05/Deep-learning-Information-theory/

[5] https://blog.algorithmia.com/introduction-to-loss-functions/

[6] https://gombru.github.io/2018/05/23/cross_entropy_loss/

[7] https://www.kdnuggets.com/2018/04/right-metric-evaluating-machine-learning-models-1.html

[8] https://rohanvarma.me/Loss-Functions/

[9] http://blog.christianperone.com/2019/01/mle/

Регрессия как задача машинного обучения

38 мин на чтение

(55.116 символов)

Постановка задачи регрессии

Источник: Analytics Vidhya.

Задача регрессии — это одна из основных задач машинного обучения. И хотя, большинство задач на практике относятся к другому типу — классификации, мы начнем знакомство с машинным обучением именно с регрессии. Регрессионные модели были известны задолго до появления машинного обучения как отрасли и активно применяются в статистике, эконометрике, математическом моделировании. Машинное обучение предлагает новый взгляд на уже известные модели. И этот новый взгляд позволит строить более сложные и мощные модели, чем классические математические дисциплины.

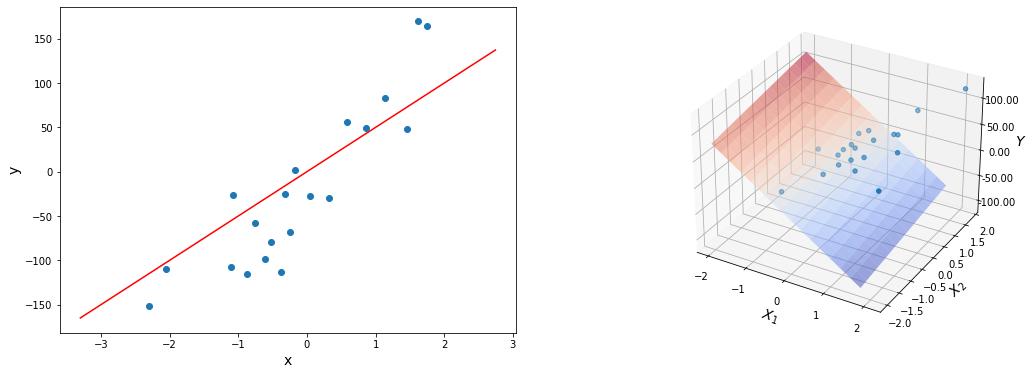

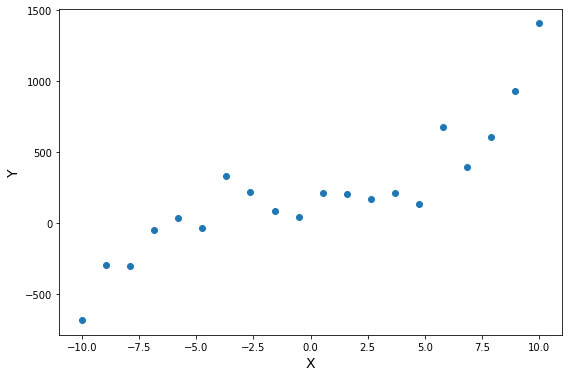

Задача регрессии относится к категории задач обучения с учителем. Это значит, что набор данных, который используется для обучения, должен иметь определенную структуру. Обычно, наборы данных для машинного обучения представляют собой таблицу, в которой по строкам перечислены разные объекты наблюдений или измерений. В столбцах — различные характеристики, или атрибуты, объектов. А на пересечении строк и столбцов — значение данной характеристики у данного объекта. Обычно один атрибут (или переменная) имеет особый характер — именно ее значение мы и хотим научиться предсказывать с помощью модели машинного обучения. Эта характеристика объекта называется целевая переменная. И если эта целевая переменная выражена числом (а точнее, некоторой непрерывной величиной) — то мы говорим о задаче регрессии.

Задачи регрессии на практике встречаются довольно часто. Например, предсказание цены объекта недвижимости — классическая регрессионная задача. В таких проблемах атрибутами выступают разные характеристики квартир или домов — площадь, этажность, расположение, расстояние до центра города, количество комнат, год постройки. В разных наборах данных собрана разная информация И, соответственно, модели тоже должны быть разные. Другой пример — предсказание цены акций или других финансовых активов. Или предсказание температуры завтрашним днем.

Во всех таких задачах нам нужно иметь данные, которые позволят осуществить такое предсказание. Да, “предсказание” — это условный термин, не всегда мы говорим о будущих событиях. Регрессионные модели используют информацию об объектах в обучающем наборе данных, чтобы сделать вывод о возможном значении целевой переменной. И для этого нужно, чтобы ее значение имело какую-то зависимость от имеющихся у нас атрибутов. Если построить модель предсказания цены акции, но на вход подать информацию о футбольных матчах — ничего не получится. Мы предполагаем, что в наборе данных собраны именно те атрибуты объектов, которые имеют влияние на на значение целевой переменной. И чем больше это предположение выполняется, тем точнее будет потенциально наша модель.

Немного поговорим о терминах. Набор данных который мы используем для обучения модели называют датасетом (dataset) или обучающей выборкой (training set). Объекты, которые описываются в датасете еще называют точками данных (data points). Целевую переменную еще называют на статистический манер зависимой переменной (dependent variable) или результативной, выходной (output), а остальные атрибуты — независимыми переменными (dependent variables), или признаками (features), или факторами, или входными переменными (input). Значения одного конкретного атрибута для всех объектов обучающей выборки часто представляют как вектор этого признака (feature vector). А всю таблицу всех атрибутов называют матрицей атрибутов (feature matrix). Соответственно, еще есть вектор целевой переменной, он не входит в матрицу атрибутов.

С точки зрения информатики, регрессионная модель — это функция, которая принимает на вход значения атрибутов какого-то конкретного объекта и выдает на выходе предполагаемое значение целевой переменной. В большинстве случаев мы предполагаем, что целевая переменная у нас одна. Если стоит задача предсказания нескольких характеристик, то их чаще воспринимают как несколько независимых задач регрессии на одних и тех же атрибутах.

Мы пока ничего не говорили о том, как изнутри устроена регрессионная модель. Это потому, что она может быть какой угодно. Это может быть математическое выражение, условный алгоритм, сложная программа со множеством ветвлений и циклов, нейронная сеть — все это можно представить регрессионной моделью. Единственное требование к модели машинного обучения — она должна быть параметрической. То есть иметь какие-то внутренние параметры, от которых тоже зависит результат вычисления. В простых случаях, чаще всего в качестве регрессионной модели используют аналитические функции. Таких функций бесконечное количество, но чаще всего используется самая простая функция, с которой мы и начнем изучение регрессии — линейная функция.

Так же надо сказать, что иногда регрессионные модели подразделяют на парную и множественную регрессии. Парная регрессия — это когда у нас всего один атрибут. Множественная — когда больше одного. Конечно, на практике парная регрессия почти не встречается, но на примере такой простой модели мы поймем основные концепции машинного обучения. Плюс, парную регрессию очень удобно и наглядно можно изобразить на графике. Когда у нас больше двух переменных, графики уже не особо построишь, и модели приходится визуализировать иначе, более косвенно.

Выводы:

- Регрессия — это задача машинного обучения с учителем, которая заключается в предсказании некоторой непрерывной величины.

- Для использования регрессионных моделей нужно, чтобы в датасете были характеристики объектов и “правильные” значения целевой переменной.

- Примеры регрессионных задач — предсказание цены акции, оценка цены объекта недвижимости.

- Задача регрессии основывается на предположении, что значение целевой переменной зависит от значения признаков.

- Регрессионная модель принимает набор значений и выдает предсказание значения целевой переменной.

- В качестве регрессионных моделей часто берут аналитические функции, например, линейную.

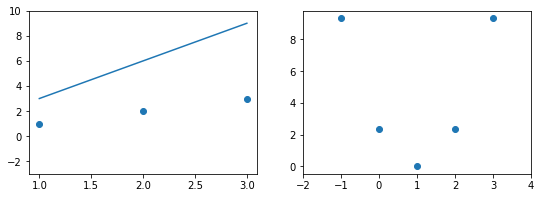

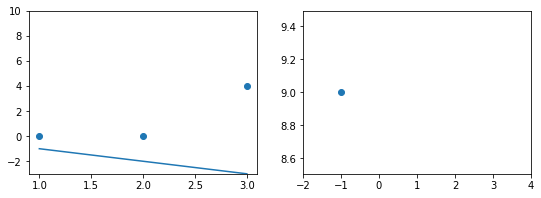

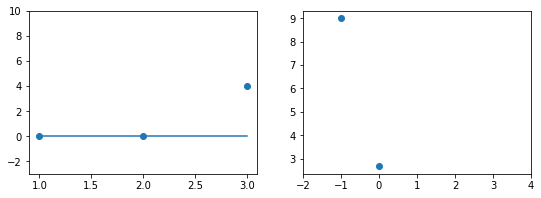

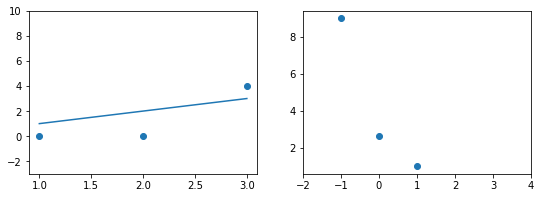

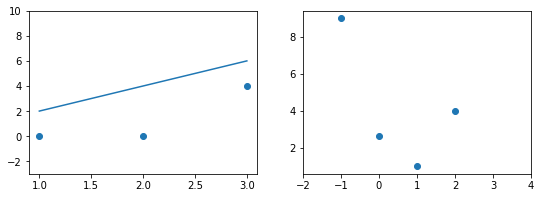

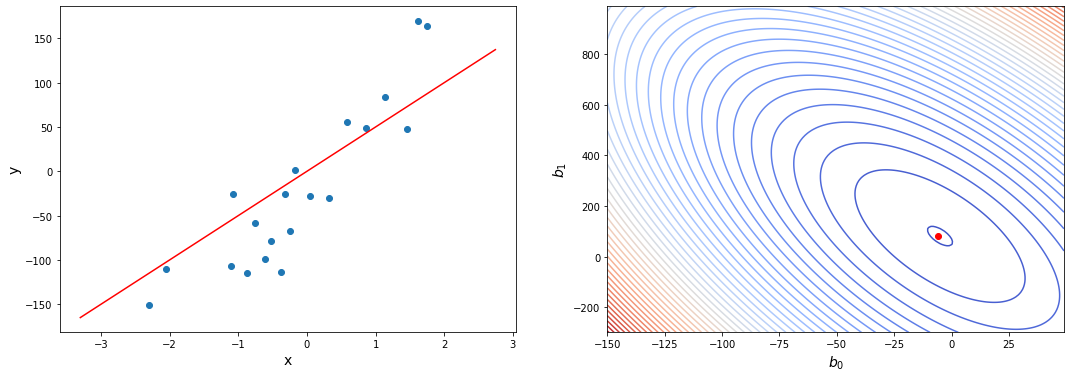

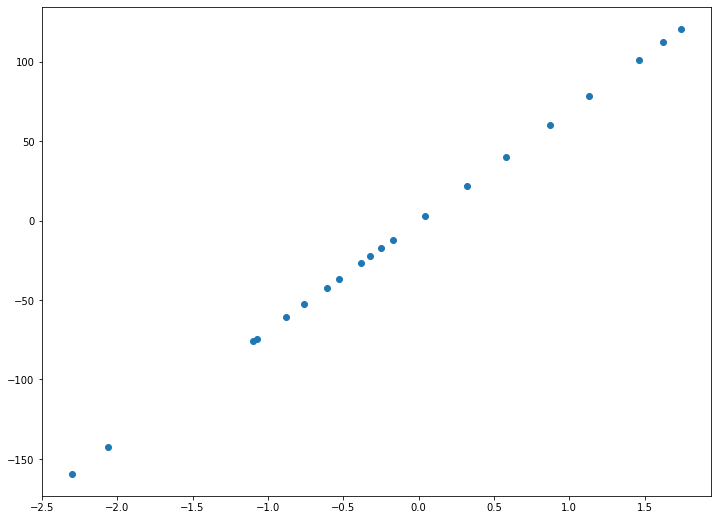

Линейная регрессия с одной переменной

Функция гипотезы

Напомним, что в задачах регрессии мы принимаем входные переменные и пытаемся получить более-менее достоверное значение целевой переменной. Любая функция, даже самая простая линейная может выдавать совершенно разные значения для одних и тех же входных данных, если в функции будут разные параметры. Поэтому, любая регрессионная модель — это не какая-то конкретная математическая функция, а целое семейство функций. И задача алгоритма обучения — подобрать значения параметров таким образом, чтобы для объектов обучающей выборки, для которых мы уже знаем правильные ответы, предсказанные (или теоретические, вычисленные из модели) значения были как можно ближе к тем, которые есть в датасете (эмпирические, истинные значения).

Парная, или одномерная (univariate) регрессия используется, когда вы хотите предсказать одно выходное значение (чаще всего обозначаемое $y$), зависящее от одного входного значения (обычно обозначается $x$). Сама функция называется функцией гипотезы или моделью. В качестве функции гипотезы для парной регрессии можно выбрать любую функцию, но мы пока потренируемся с самой простой функцией одной переменной — линейной функцией. Тогда нашу модель можно назвать парной линейной регрессией.

В случае парной линейной регрессии функция гипотезы имеет следующий общий вид:

[hat{y} = h_b (x) = b_0 + b_1 x]

Обратите внимание, что это похоже на уравнение прямой. Эта модель соответствует множеству всех возможных прямых на плоскости. Когда мы конкретизируем модель значениями параметров (в данном случае — $b_0$ и $b_1$), мы получаем конкретную прямую. И наша задача состоит в том, чтобы выбрать такую прямую, которая бы лучше всего “легла” в точки из нашей обучающей выборки.

В данном случае, мы пытаемся подобрать функцию h(x) таким образом, чтобы отобразить данные нам значения x в данные значения y.

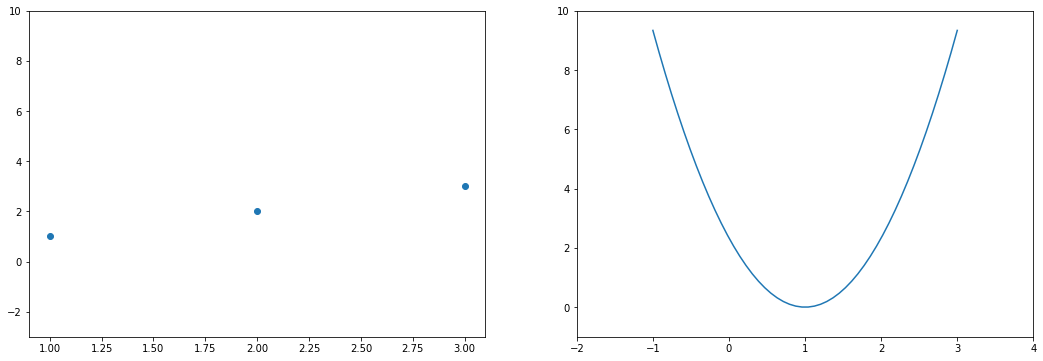

Допустим, мы имеем следующий обучающий набор данных:

| входная переменная x | выходная переменная y |

| 0 | 4 |

| 1 | 7 |

| 2 | 7 |

| 3 | 8 |

Мы можем составить случайную гипотезу с параметрами $ b_0 = 2, b_1 = 2 $. Тогда для входного значения $ x=1 $ модель выдаст предсказание, что $ y=4 $, что на 3 меньше данного. Значение $y$б которое посчитала модель будем называть теоретическим или предсказанным (predicted), а значение, которое дано в наборе данных — эмпирическим или истинным (true). Задача регрессии состоит в нахождении таких параметров функции гипотезы, чтобы она отображала входные значения в выходные как можно более точно, или, другими словами, описывала линию, наиболее точно ложащуюся в данные точки на плоскости $(x, y)$.

Выводы:

- Модель машинного обучения — это параметрическая функция.

- Задача обучения состоит в том, чтобы подобрать параметры модели таким образом, чтобы она лучше всего описывала обучающие данные.

- Парная линейная регрессия работает, если есть всего одна входящая переменная.

- Парная линейная регрессия — одна из самых простых моделей машинного обучения.

- Парная линейная регрессия соответствует множеству всех прямых на плоскости. Из них мы выбираем одну, наиболее подходящую.

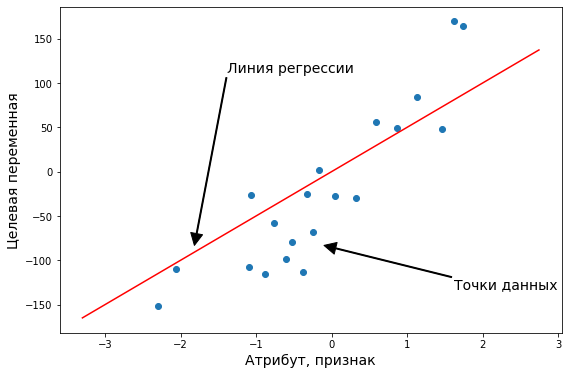

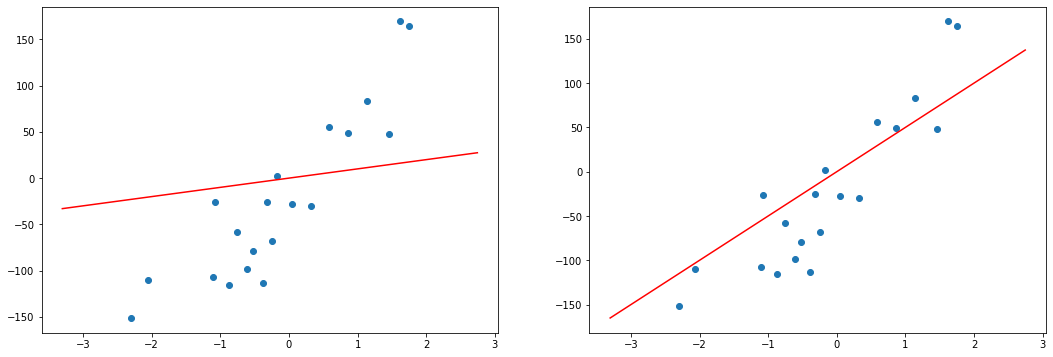

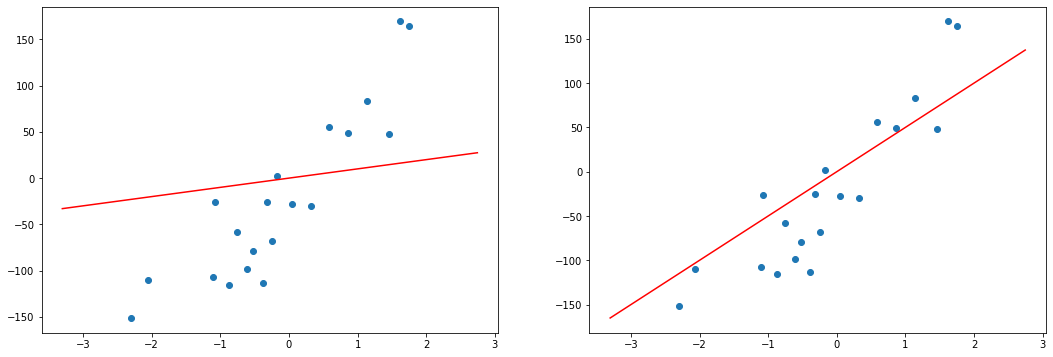

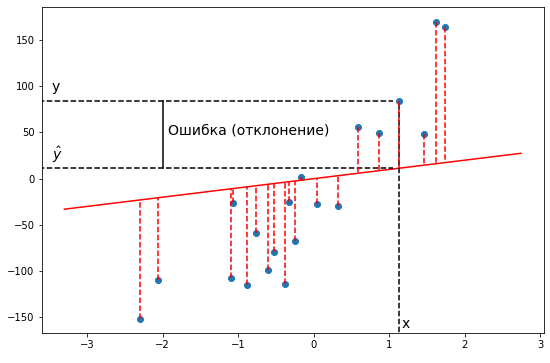

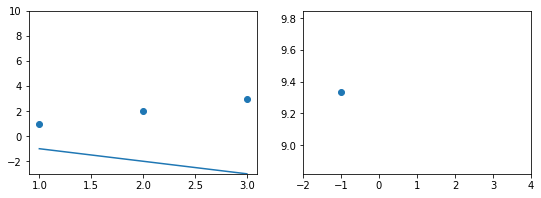

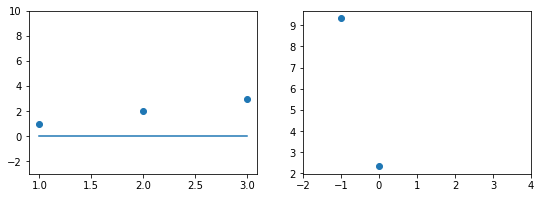

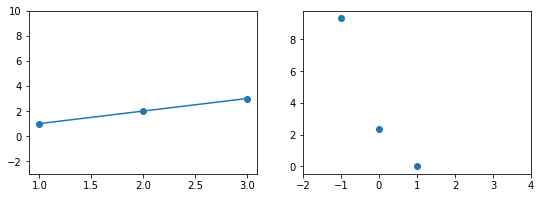

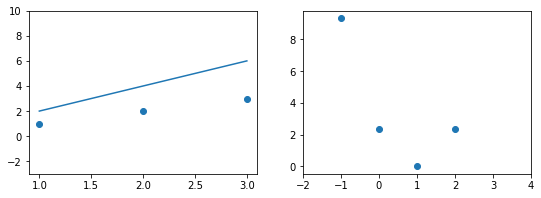

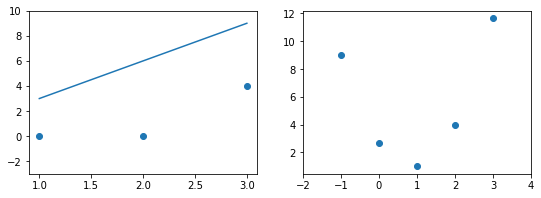

Функция ошибки

Как мы уже говорили, разные значения параметров дают разные модели. Для того, чтобы подобрать наилучшую модель, нам нужно средство измерения “точности” модели, некоторая функция, которая показывает, насколько модель хорошо или плохо соответствует имеющимся данным.

В простых случаях мы можем отличить хорошие модели от плохих, только взглянув на график. Но это затруднительно, если количество признаков очень велико, если модели лишь немного отличаются друг от друга. Да и для автоматизации процесса нужен способ формализовать наше общее представление о том, что модель “ложится” в точки данных.

Такая функция называется функцией ошибки (cost function). Она измеряет отклонения теоретических значений (то есть тех, которые предсказывает модель) от эмпирических (то есть тех, которые есть в данных). Чем выше значение функции ошибки, тем хуже модель соответствует имеющимся данным, хуже описывает их. Если модель полностью соответствует данным, то значение функции ошибки будет нулевым.

В задачах регрессии в качестве функции ошибки чаще всего берут среднеквадратичное отклонение теоретических значений от эмпирических. То есть сумму квадратов отклонений, деленную на удвоенное количество измерений.

[J(b_0, b_1)

= frac{1}{2m} sum_{i=1}^{m} (hat{y_i} — y_i)^2

= frac{1}{2m} sum_{i=1}^{m} (h_b(x_i) — y_i)^2]