Будем

рассматривать квантование

с равномерным шагом x=const, т.е. равномерное

квантование.

Как было отмечено в §

3.1.1. в процессе квантования неизбежно

возникает ошибка квантования .

Последовательность ошибок квантования

(kt), возникающая при квантовании

процесса с дискретным временем, называется

шумом квантования. Обычно шум квантования

предполагают стационарным эргодическим

случайным процессом.

Чаще всего

интерес представляют максимальное

значение ошибки квантования, ее среднее

значение , равное математическому

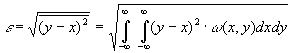

ожиданию шума и среднеквадратическое

отклонение ,

равное квадратному корню из дисперсии

шума

(она характеризует мощность шума

квантования). Все эти величины зависят

от способа округления, применяемого

при квантовании, кроме того

и

зависят от закона распределения w()

мгновенных значений сигнала в пределах

шага квантования.

Считая шаг квантования

x малым по сравнению с диапазоном

изменения сигнала, плотность w(x) в

пределах этого шага можно принять

равномерной, т.е.

.

Различают

квантование с округлением, с усечением

и с усечением модуля.

При квантовании

с округлением истинному значению отсчета

приписывает ближайший разрешенный

уровень квантования независимо от того,

находится он сверху или снизу. Очевидно,

что при этом

|

max=0.5x; |

(3.31а) |

Квантование

с округлением требует определенной

сложности в реализации. Проще выполняется

квантование с усечением, при котором

истинному значению отсчета приписывается

ближайший нижний уровень. При

этом

|

max=x; |

т.е.

максимальное значение погрешности в 2

раза больше, а

,

что приводит к накоплению погрешности

квантования при дальнейшей обработке

квантованной последовательности.

Промежуточное

положение по точности и сложности

реализации занимает квантование с

усечением модуля, которое для положительных

отсчетов является таким же, как и

квантование с усечением. Отрицательным

отсчетам приписывается ближайший

верхний уровень. При этом

то

есть накопление погрешностей не

происходит, но в 2 раза увеличивается

максимальная погрешность, и в 2 раза —

мощность шума квантования

.

Выбирая достаточно большее число уровней

квантования N, шаг квантования.

,

а следовательно и все рассмотренные

погрешности можно сделать необходимо

малыми. При неравномерном законе

распределения мгновенных значений

сигнала квантования с постоянным шагом

не

является оптимальным по критерию

минимума среднеквадратической ошибки

.

Квантуя участки с менее вероятными

значениями сигнала с большим шагом

значение

можно

уменьшить, при этом же количестве уровней

квантования.

3.3. Информация в непрерывных сообщениях

Для

того, чтобы оценить потенциальные

возможности передачи сообщений

по непрерывным каналам, необходимо

вести количественные информационные

характеристики непрерывных сообщений

и каналов.

Обобщим с этой целью понятие энтропии

и взаимной

информации

на ансамбли непрерывных сигналов.

Пусть

Х — случайная величина (сечение или

отсчет случайного процесса), определенная

в некоторой непрерывной области и ее

распределение вероятностей характеризуется

плотностью w(х).

Разобьем область

значений Х на небольшие интервалы

протяженностью x. Вероятность Рк

того, что хк<x<xк+

x, приблизительно равна w(хк)

x т.е.

|

Рк=Р( |

(3.32) |

причем

приближение тем точнее, чем меньше

интервал x. Степень положительности

такого события.

Если

заменить истинные значения Х в пределах

интервала x значениями хк

в начале интервала, то непрерывный

ансамбль заменится дискретным и его

энтропия в соответствии с (1.4)

определится, как

или

с учетом (3.32)

|

|

(3.33) |

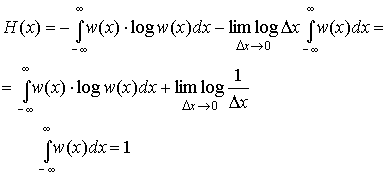

Будем

теперь увеличивать точность определения

значения х, уменьшения интервал x. В

пределе при x0 получим

энтропию непрерывной случайной величины.

|

|

(3.34) |

Второй

член в полученном выражении стремится

к

и

совершенно не зависит от распределения

вероятностей Х. Это означает, что

собственная информация любой непрерывной

случайной величины бесконечно велика.

Физический смысл такого результата

становиться понятным, если учесть, что

в конечном диапазоне непрерывная

величина может принимать бесконечное

множество значений, поэтому вероятность

того, что ее реализация будет точно

равна какому-то наперед заданному

конкретному значению является бесконечно

малой величиной 0. В результате энтропия,

определенная в соответствии с (1.4),

характеризующая среднюю степень

неожиданности появления возможных

реализаций для любой непрерывной

случайной величины не зависит от ее

закона распределения и всегда равна

бесконечности. Поэтому для описания

информационных свойств непрерывных

величин необходимо ввести другие

характеристики. Это можно сделать, если

обратить внимание на то, что первое

слагаемое выражении (3.34) является

конечным и однозначно определяется

плотностью распределения вероятности

w(x). Его называют дифференциальной

энтропией и обозначают h(x):

|

|

(3.35) |

Дифференциальная

энтропия обладает следующими свойствами.

1.

Дифференциальная энтропия в отличии

от обычной энтропии дискретного источника

не является мерой собственной информации,

содержащейся в ансамбле значений

случайной величины Х. Она зависит от

масштаба Х и может принимать отрицательные

значения. Информационный смысл имеет

не сама дифференциальная энтропия, а

разность двух дифференциальных энтропий,

чем и объясняется ее название.

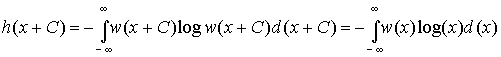

2.

Дифференциальная энтропия не меняется

при изменении всех возможных значений

случайной величины Х на постоянную

величину. Действительно, масштаб Х при

этом не меняется и

справедливо равенство

|

|

(3.36) |

Из

этого следует, что h(x) не зависит от

математического ожидания случайной

величины, т.к. изменяя все значения Х на

С мы тем самым изменяем на С и ее среднее,

то есть математическое ожидание.

3.

Дифференциальная энтропия аддитивна,

то есть для объединения ХY независимых

случайный величин Х и Y справедливо:

h(XY)=

h(X)+ h(Y).

Доказательство этого свойства

аналогично доказательству (1.8) аддитивности

обычной энтропии.

4. Из всех

непрерывных величин Х с фиксированной

дисперсией 2

наибольшую дифференциальную энтропию

имеет

величина с гауссовским распределением,

т.е.

|

|

(3.37) |

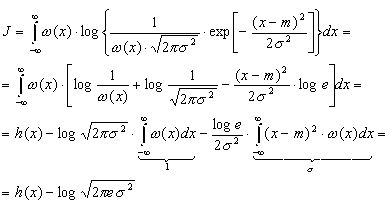

Доказательство

свойства проведем в два этапа: сначала

вычислим h(x) для гауссовского распределения,

задаваемого плотностью.

где

м — математическое ожидание,

а затем

докажем неравенство (3.37).

Подставив

(3.38) в (3.35) найдем<

Для

доказательства неравенства (3.37) зададимся

произвольным распределением (х) с

дисперсией 2

и математическим ожиданием m и вычислим

интеграл J вида

|

|

Но

в силу неравенства (1.7)

с учетом правила изменения основания

логарифмов (log t = log e ln t)

имеем:

|

|

|

|

так |

Таким

образом

,

откуда

.

Но

как только что было показано,

—

это дифференциальная энтропия гауссовского

распределения. Доказанное неравенство

и означает, что энтропия

гауссовского распределения

максимальна.

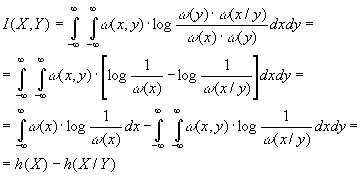

Попытаемся теперь

определить с помощью предельного

перехода взаимную

информацию между двумя непрерывными

случайными величинами X и Y. Разбив

области определения Х и Y соответственно

на небольшие интервалы x и y, заменим

эти величины дискретными так же, как

это делалось при выводе формулы

(3.34).

Исходя из выражения

(1.14) можно определить взаимную информацию

между величинами Х и Y .

|

|

(3.39) |

При

этом предельном переходе никаких явных

бесконечностей не появилось, т.е. взаимная

информация оказывается величиной

конечной, имеющей тот же смысл, что и

для дискретных сообщений.

С

учетом того, что

|

(x,y)= (y) |

равенство

(3.39) можно представить в виде

|

|

(3.40) |

Здесь

h(X) — определенная выражением (3.35)

дифференциальная энтропия Х, а

|

|

(3.41) |

h(X/Y)

— условная дифференциальная энтропия.

Можно показать, что во всех случаях

h(X/Y)h(X).

Формула

(3.40) имеет ту же форму, что и (1.13), а

отличается лишь заменой энтропии

дифференциальной энтропией. Легко

убедиться, что основные свойства 1 и 2

(см. пункт 1.3) взаимной информации,

описываемые равенствами (1.15)(1.17),

остаются справедливыми и в этом случае.

3.4 -энтропия

и -производительность

источника непрерывных сообщений

Как

было показано в § 3.3, в одном отсчете

любого непрерывного сообщения содержится

бесконечное количество собственной

информации. И тем не менее, непрерывные

сообщения (телефонные разговоры,

телепередачи) успешно передаются по

каналам связи. Это объясняется тем, что

на практике никогда не требуется

абсолютно точного воспроизведения

переданного сообщения, а для передачи

даже с очень высокой, но ограниченной

точностью, требуется конечное количество

информации, также как и при передаче

дискретных сообщений. Данное обстоятельство

и положено в основу определения

количественной меры собственной

информации, источников непрерывных

сообщений. В качестве такой меры,

принимается минимальное количество

информации, необходимое для воспроизведения

непрерывного сообщения с заданной

точностью. Очевидно, что при таком

подходе собственная информация зависит

не только от свойств источника сообщений,

но и от выбора параметра , характеризующего

точность воспроизведения. Возможны

различные подходы к определению в

зависимости от вида и назначения

передаваемой информации. Наиболее часто

в информационной технике в качестве

используют среднеквадратическое

отклонение между принятым у и переданным

х сигналами, отражающими непрерывные

сообщения, т.е.

|

|

(3.42) |

где

Х и Y – ансамбли сигналов, отражающих

исходное и воспроизведенное сообщения.

Два

варианта сообщения или сигнала,

различающиеся не более, чем на заданное

значение 0,

называются эквивалентными. Взаимная

информация

I(X,Y) между двумя эквивалентными процессами

X(t) и Y(t) может быть определена в соответствии

с (3.40) как

|

I(X,Y)=h(X)-h(X/Y), |

где

h(X) и h(X/Y) – соответственно дифференциальная

и условная дифференциальная энтропии.

Из приведенного выражения видно,

что величина I(X,Y) зависит не только от

собственного распределения (х) ансамбля

Х (см. (3.35)), но и от условного распределения

(x/y) (см. (3.41)), которое определяется

способом преобразования процесса X в

Y. Для характеристики собственной

информации, содержащейся в одном отсчете

процесса Х, нужно устранить ее зависимость

от способа преобразования сообщения Х

в эквивалентное ему сообщение Y. Этого

можно добиться, если под количеством

собственной информации или — энтропией

H(Х)

процесса Х понимать минимизированную

по всем распределениям (X/Y) величину

I(X,Y), при которой сообщения Х

и Y еще эквивалентны, т.е.

|

|

(3.43) |

Таким

образом,

— энтропия

определяет минимальное количество

информации, содержащейся в одном отсчете

непрерывного

сообщения,

необходимое для воспроизведения его с

заданной верностью.

Если ансамбль

сообщений Х представляет собой процесс

с дискретным

временем

с непрерывными отсчетами, то под

— производительностью источника понимают

величину

|

|

(3.44) |

где

с

– количество отсчетов сообщения,

выдаваемых в единицу времени.

В том

случае, когда Х — непрерывный случайный

процесс с ограниченным спектром, вся

информация, содержащаяся в его значениях,

эквивалентна информации, содержащейся

в отсчетах процесса, следующих друг за

другом с интервалом

,

(fm-граничная

частота спектра), т.е. со

скоростью

|

c=2 |

(3.45) |

При

этом

— производительность

источника или процесса по-прежнему

определяется выражением (3.44), где величина

с

рассчитывается из условия (3.45).

В том

случае, если следующие друг за другом

отсчеты процесса коррелированны

(взаимозависимы), величина Н(Х)

в (3.43) должна вычисляться с учетом

вероятностных связей между отсчетами.

Итак,

— производительность источника

непрерывных сообщений представляет

собой минимальное количество информации,

которое нужно создать источнику в

единицу времени, для воспроизведения

его сообщений с заданной верностью.

— производительность называют также

скоростью создания информации при

заданном критерии верности.

Максимально

возможная — производительность

непрерывного

источника Х обеспечивается при гауссовском

распределении Х с дисперсией

(при

этом условии h(X) максимальна (см. (3.37)).

Оценим значение

.

Рассмотрим случай, когда непрерывное

сообщение X(t) представляет собой

стационарный гауссовский процесс с

равномерным энергетическим спектром,

ограниченным частотой Fc,

и с заданной мощностью (дисперсией) Рх,

а критерий эквивалентности задан в

виде (3.42).

Будем считать, что заданная верность

воспроизведения обусловлена действием

аддитивной статистически не связанной

с сигналом помехи (t) с математическим

ожиданием М[]=0 и дисперсией (мощностью)

.

Исходный сигнал Х рассматриваем

как сумму воспроизводящего сигнала Y и

помехи:

|

X=Y+. |

При

этом, поскольку (x/y)= (y+/y)= (/y)=

(), то h(X/Y) полностью определяется

шумом воспроизведения (t). Поэтому max

h(X/Y)=max h(). Так как шум воспроизведения

имеет фиксированную дисперсию

,

то дифференциальная энтропия имеет

максимум (3.37) при гауссовском

распределении шума

|

|

В

свою очередь дифференциальная энтропия

гауссовского источника с дисперсией

.

|

|

Следовательно,

— энтропия на один отсчет

сообщения

|

|

(3.46) |

Величина

характеризует

минимальное отношение сигнал-шум, при

котором сообщения X(t) и Y(t) еще

эквивалентны.

Согласно теореме

Котельникова

шаг

дискретизации

,

а c=2

Fc.

При этом равномерность спектра сообщения

обеспечивает некоррелированность

отстоящих на t друг от друга отсчетов,

а гауссовский характер распределения

X(t) — их независимость. Следовательно,

в соответствии с (3.44)

|

|

или с учетом (3.46)

|

|

(3.47) |

Количество

информации,

выданное таким источником за время Тс

|

|

(3.48) |

Интересно

отметить, что правая часть выражения

(3.48) совпадает с наиболее общей

характеристикой сигнала, называемой

его объемом, если принять динамический

диапазон сигнала D=log

0.

Это означает, что объем сигнала равен

максимальному количеству информации,

которое может содержаться в сигнале

длительностью Тс.

Соседние файлы в предмете [НЕСОРТИРОВАННОЕ]

- #

- #

- #

- #

- #

- #

- #

- #

- #

- #

- #

5.1. Цифровые сигналы: дискретизация, квантование, кодирование

5.2. Цифровые иерархии

5.1. Цифровые сигналы: дискретизация, квантование, кодирование

В настоящее время во всём мире развивается цифровая форма передачи сигналов: цифровая телефония, цифровое кабельное телевидение, цифровые системы коммутации и системы передачи, цифровые сети связи. Качество цифровой связи значительно выше, чем аналоговой, так как цифровые сигналы гораздо более помехоустойчивы: нет накопления шумов, легко обрабатываются, цифровые сигналы можно «сжимать», что позволяет в одной полосе частот организовать больше каналов с высокой скоростью передачи и отличным качеством.

Цифровой сигнал – это последовательность импульсов. Общепринято импульсную последовательность представлять как чередование двух символов: 0 и 1. «Binary Digit» – «двоичная цифра». Отсюда и пошло понятие бит, то есть одна позиция в цифровом сигнале есть 1 бит; это может быть либо 0, либо 1. Восемь позиций в цифровом сигнале определяется понятием байт [1].

При передаче цифровых сигналов вводится понятие скорости передачи – это количество бит, передаваемых в единицу времени (в секунду).

Для передачи непрерывных сообщений цифровыми методами необходимо произвести преобразование этих сообщений в дискретные, которое осуществляется путём дискретизации непрерывных сигналов во времени и квантования их по уровню, и преобразования квантованных отсчётов в цифровой сигнал [6].

Дискретизация сигналов заключается в замене непрерывного сообщения uк(t) последовательностью его отсчётов, то есть последовательностью импульсов, модулированных по амплитуде (смотри рисунок 5.1, а). Частота дискретизации Fд выбирается из условия (4.4.1). Полученный аналоговый АИМ сигнал uАИМ(iTд), где i = 1, 2, 3 …, приведённый на рисунке 5.1, а, затем подвергается операции квантования, которая состоит в замене отсчётов мгновенных значений сигнала uАИМ (iTд) дискретными значениями u0, u1, u2 … u7 разрешённых уровней uкв (iTд). В процессе квантования мгновенные значения АИМ сигнала уровней uАИМ(iTд) заменяются ближайшими разрешёнными уровнями сигнала uкв(iTд) (смотри рисунок 5.1, а).

Рисунок 5.1. Принцип ИКМ: а – дискретизация; б – ошибка квантования; в – цифровой сигнал с ИКМ

Такое преобразование первичных сигналов можно называть квантованной амплитудно-импульсной модуляцией (КАИМ). Особенностью такого сигнала является то, что все его уровни можно пронумеровать и тем самым свести передачу КАИМ-сигнала к передаче последовательностей номеров уровней, которые этот сигнал принимает в моменты i∙tд.

Расстояние между ближайшими разрешёнными уровнями квантования (u0 … u7 на рисунке 5.1, а) ∆ называется шагом квантования. Шкала квантования называется равномерной, если все шаги квантования равны между собой ∆j = ∆0 [5].

Если в момент взятия i-го отсчёта мгновенное значение непрерывного сообщения uк(ti) удовлетворяет условию

uj – ∆j/2 ≤ uАИМ(iTд) ≤ uj + ∆j/2, (5.1)

то квантованному импульсу uкв(iTд) присваивается амплитуда разрешённого uj уровня квантования (смотри рисунок 5.1, а). При этом возникает ошибка квантования δкв, представляющая разность между передаваемой квантованной величиной uкв(iTд) и истинным значением непрерывного сигнала в данный момент времени uАИМ(iTд) (смотри рисунок 5.1, б):

δкв(iTд) = uкв(iTд) – uАИМ(iTд). (5.2)

Как следует из рисунков 5.1, б и (5.1), ошибка квантования лежит в пределах

–∆0/2 ≤ δкв ≤ ∆0/2. (5.3)

Амплитудная характеристика квантующего устройства при равномерной шкале квантования приведена на рисунке 5.2, а. Она имеет ступенчатую форму, и при изменении непрерывного сообщения uк(t) и соответствующего ему АИМ сигнала uАИМ(iTд) в пределах одной ступени выходной сигнал остаётся постоянным, а при достижении границы этой ступени изменяется скачком на величину шага квантования. При этом ошибка квантования зависит от uк(t) и имеет вид, изображённый на рисунке 5.2, б.

Рисунок 5.2. Амплитудная характеристика квантователя (а) и зависимость ошибки квантования от амплитуды импульсов (б)

Как следует из рисунка 5.2, б, из-за нелинейности амплитудной характеристики квантователя ошибка квантования δкв представляет собой функцию с большим числом резких скачков, частота следования которых существенно выше частоты исходного сообщения uк(t), то есть при квантовании происходит расширение спектра сигнала. При этом соседние боковые полосы будут накладываться друг на друга и в полосу пропускания ФНЧ на выходе канала попадут составляющие спектра искажений от квантования, распределение которых в полосе ФНЧ считается равномерным. Поскольку практически все дискретные значения непрерывного сообщения находятся в пределах зоны квантования от –uогр до +uогр, то при равномерной шкале квантования ∆j = ∆0 и тогда:

Ркв = (1/12) ∆20. (5.4)

Из выражения (5.4) видно, что при равномерной шкале квантования мощность шума квантования не зависит от уровня квантуемого сигнала и определяется только шагом квантования ∆0.

Рассмотрим теперь кодирование и декодирование сигналов. Следующий шаг в преобразовании сигнала состоит в переводе квантованного АИМ-сигнала в цифровой. Эта операция называется кодированием АИМ-сигнала. Кодом называется закон, устанавливающий соответствие между квантованной амплитудой и структурой кодовой группы [8].

Различают равномерный и неравномерный коды. Если все кодовые группы состоят из равного числа символов, то код называется равномерным. Если же кодовые группы состоят из различного числа символов, то код называется неравномерным. В системах передачи с импульсно-кодовой модуляцией, как правило, используется равномерный двоичный код.

Для определения структуры двоичной кодовой комбинации на выходе кодера в простейшем случае необходимо в двоичном коде записать амплитуду АИМ отсчётов, выраженную в шагах квантования

где ai = {0,1} – состояние соответствующего разряда комбинации; 2i – вес соответствующего разряда в шагах квантования.

Если в десятичной системе «вес» каждой позиции числа равен числу десять в некоторой степени, то в двоичной системе вместо числа десять используют число два. «Веса» первых тринадцати позиций двоичного числа имеют следующие значения:

Таблица – 5.1

|

212 |

211 |

210 |

29 |

28 |

27 |

26 |

25 |

24 |

23 |

22 |

21 |

20 |

|

4096 |

2048 |

1024 |

512 |

256 |

128 |

64 |

32 |

16 |

8 |

4 |

2 |

1 |

По принципу действия кодеры делятся на кодеры счётного типа, матричные, взвешивающего типа и другие. Наиболее часто используются кодеры взвешивающего типа, простейшим из которых является кодер поразрядного взвешивания (рисунок 5.3), реализующий функцию (5.5) с формирования натурального двоичного кода [5]. Принцип работы такого кодера заключается в уравновешивании кодируемых АИМ отсчётов суммой эталонных напряжений. Схема линейного кодера поразрядного взвешивания содержит восемь ячеек (при m = 8), обеспечивающих формирование значения коэффициента аi соответствующего разряда (5.5). В состав каждой ячейки (за исключением последней, соответствующей младшему по весу разряду) входит схема сравнения СС и схема вычитания СВ.

Схема сравнения обеспечивает сравнение амплитуды поступающего АИМ сигнала с эталонными сигналами, амплитуды которых равны весам соответствующих разрядов

Uэт8 = 27∆ = 128∆; Uэт7 = 26∆ = 64∆; … Uэт1 = 20∆ = 1∆.

Если на входе ССi амплитуда поступающего АИМ сигнала равна или превышает Uэтi, то на выходе схемы сравнения формируется «1», а в СВi из входного сигнала вычитается Uэтi, после чего он поступает на вход следующей ячейки. Если же амплитуда АИМ сигнала на входе ССi меньше Uэтi, то на выходе ССi формируется «0» и АИМ сигнал проходит через СВi без изменений. После окончания процесса кодирования текущего отсчёта на выходе кодера получается восьмиразрядный параллельный код, кодер устанавливается в исходное состояние и начинается кодирование следующего отсчёта.

Рисунок 5.3. Линейный кодер поразрядного действия

Если, например, на вход кодера поступил АИМ отсчёт с амплитудой UАИМ = 185∆, то СС8 формирует Р8 = 1 и на вход седьмой ячейки поступил сигнал с амплитудой UАИМ = 185∆ – 128∆ = 57∆. На выходе СС7 сформируется Р7 = 0 и на вход шестой ячейки кодера поступит сигнал с той же амплитудой UАИМ = 57∆. На выходе СС6 сформируется Р6 = 1 и на вход следующей ячейки поступит сигнал с амплитудой UАИМ = 57∆ – 32∆ = 25∆ и так далее. В результате будет сформирована кодовая комбинация 10111001.

В процессе декодирования сигнала m – разрядные кодовые комбинации преобразуются в АИМ отсчёты соответствующей амплитуды [4]. Сигнал на выходе декодера получается в результате суммирования эталонных сигналов Uэтi тех разрядов кодовой комбинации, значения которых равно 1 (рисунок 5.4). Так, если на вход декодера поступила кодовая комбинация 10111001, то амплитуда АИМ отсчёта на его выходе будет равна UАИМ = 128∆ + 32∆ + 16∆ + 8∆ + 1∆ = 185∆.

В линейном декодере (рисунок 5.4) под воздействием управляющих сигналов, поступающих от генераторного оборудования, в регистр сдвига записывается очередная восьмиразрядная кодовая комбинация. В момент прихода импульса считывания замыкаются только те ключи Кл1 … Кл8, которые соответствуют разрядам, имеющим значения «1». В результате в сумматоре объединяются соответствующие эталонные напряжения и на его выходе получается соответствующая амплитуда АИМ отсчёта.

Рисунок 5.4. Линейный декодер взвешивающего типа

Рассмотренная схема кодера (рисунок 5.3) поразрядного взвешивания содержит большое число схем сравнения, которые являются относительно сложными устройствами. На практике чаще используется кодер взвешивающего типа с одной схемой сравнения и цепью обратной связи, содержащей декодер. Как следует из выражения (5.4), мощность шума квантования при линейном кодировании будет равной при различных амплитудах квантованных сигналов. Для синусоидальных сигналов отношение сигнал/шум квантования, рассчитывается по формуле:

где Um – амплитуда квантуемого сигнала.

Из формулы видно, что для слабых входных сигналов это отношение гораздо хуже, чем для сигналов большой амплитуды. Для устранения этого недостатка было предложено использовать неравномерное квантование, то есть изменять шаг квантования пропорционально изменению амплитуды входного сигнала.

Для кодирования с неравномерной шкалой квантования могут быть использованы:

- прямое нелинейное кодирование, при котором кодер сочетает в себе функции аналого-цифрового преобразования (АЦП) и компрессора;

- аналоговое компандирование, при котором компрессирование сигнала осуществляется перед линейным кодером и экспандирование сигнала после линейного декодера;

- преобразование на основе линейного кодирования, при котором кодирование сигнала осуществляется в линейном кодере с большим числом разрядов с последующим цифровым компандированием [5].

Переменную величину шага квантования можно получить с помощью устройства с нелинейной амплитудной характеристикой (рисунок 5.5) (которая называется компрессором, поскольку сжимает динамический диапазон входного сигнала) и равномерного квантователя (смотри рисунок 5.2). На приёмной стороне осуществляется расширение динамического диапазона экспандером, имеющим характеристику, противоположную компрессору, что обеспечивает линейность системы передачи. Совокупность операций сжатия динамического диапазона компрессором и расширение его экспандером называется компадированием сигнала.

В настоящее время в системах ВРК с ИКМ применяется характеристика компадирования типа А (рисунок 5.5).

Рисунок 5.5. Характеристика компрессирования типа А

На этом рисунке сегментированная характеристика компрессии типа А для положительных сигналов (для отрицательных сигналов характеристика имеет аналогичный вид). Общее число сегментов характеристики Nс = 16, однако четыре центральных сегмента (по два в положительной и отрицательной областях) имеют одинаковый шаг квантования и фактически образуют один сегмент, вследствие чего число сегментов равно Nс = 13. Поэтому такая характеристика получила название типа А = 87.16/13. В центральном сегменте (Nс =1 или 2) значение ∆0 минимально (то есть равно ∆0) и соответствует равномерной двенадцатиразрядной шкале (m = 12), а в каждом последующем сегменте к краям характеристики шаг квантования увеличивается вдвое.

Представление ИКМ сигнала восьмиразрядными кодовыми комбинациями использует формат «знак – абсолютное значение», где один разряд отображает полярность АИМ сигнала П, а остальные – определяют его абсолютное значение. Семь разрядов, отображающих абсолютное значение, подразделяются на определитель номера сегмента С из трёх разрядов и определитель шага квантования К из четырёх разрядов (рисунок 5.6).

Рисунок 5.6. Формат восьмиразрядной ИКМ комбинации

Для реализации такого кодера необходимо задать величины эталонных напряжений для нижней границы каждого сегмента и при кодировании внутри сегмента (таблица 5.2).

Схемы и принцип действия нелинейных кодеков взвешивающего типа в основном те же, что и у линейных кодеков. Отличие заключается в последовательности включения эталонных напряжений в процессе кодирования исходного сигнала [5].

Таблица 5.2. Эталонные напряжения для нелинейного кодека

|

Номер сегмента Nс |

Эталонное напряжение нижней границы сегмента |

Эталонные напряжения при кодировании в пределах сегмента |

|||

|

8∆i(A) |

4∆i(B) |

2∆iI(С) |

∆i(D) |

||

|

0 |

0 |

8∆0 |

4∆0 |

2∆0 |

1∆0 |

|

1 |

16∆0 |

8∆0 |

4∆0 |

2∆0 |

1∆0 |

|

2 |

32∆0 |

16∆0 |

8∆0 |

4∆0 |

2∆0 |

|

3 |

64∆0 |

32∆0 |

16∆0 |

8∆0 |

4∆0 |

|

4 |

128∆0 |

64∆0 |

32∆0 |

16∆0 |

8∆0 |

|

5 |

256∆0 |

128∆0 |

64∆0 |

32∆0 |

16∆0 |

|

6 |

512∆0 |

256∆0 |

128∆0 |

64∆0 |

32∆0 |

|

7 |

1024∆0 |

512∆0 |

256∆0 |

128∆0 |

64∆0 |

Таким образом, максимальный шаг квантования (в седьмом сегменте) в 64 раза превышает минимальный шаг квантования, а отношение сигнал/шум квантования (для максимального значения синусоидального сигнала) может быть определено по выражению (5.6) и составит: для второго сегмента

Рс – Рш кв = 7.78 + 20lg(А/∆) = 7.78 + 20 lg(32∆0/∆0) = 37.88 дБ;

Для седьмого сегмента

Рс – Рш кв = 7.78 + 20 lg(2048∆0/64∆0) = 37.88 дБ.

Зависимость отношения сигнал/шум квантования от уровня входного сигнала при компадировании по закону А = 87.6/13 приведена на рисунке 5.7. Для сигналов в пределах нулевого и первого сегментов осуществляется равномерное квантование с шагом ∆0, поэтому Рс – Рш кв увеличивается с ростом рс. При переходе ко второму сегменту шаг квантования увеличивается в два раза, вследствие чего Рс – Рш кв резко уменьшается на 6 дБ, а затем в пределах данного сегмента возрастает с ростом рс, поскольку внутри сегмента осуществляется равномерное квантование. После попадания сигнала в зону ограничения отношение сигнал/шум резко уменьшается за счёт перегрузки кодера.

Рисунок 5.7. Зависимость Рс/Рш кв = f(рс)

На рисунке 5.8 представлена упрощённая схема нелинейного кодера взвешивающего типа, реализующего прямое кодирование АИМ сигнала.

Рисунок 5.8. Нелинейный кодер взвешивающего типа

Кодирование осуществляется за восемь тактовых интервалов, в каждом из которых формируется один из символов кодовой комбинации (рисунок 5.6). В первом такте определяется знак поступившего на вход кодера отсчёта. Если отсчёт положительный, то в знаковом разряде формируется «1» и к схеме переключения и суммирования эталонов СПСЭ подключается формирователь положительных эталонных напряжений ФЭ1, в противном случае формируется «0» и к схеме подключается ФЭ2. Затем происходит формирование кода номера сегмента методом деления их числа пополам (рисунок 5.9).

Рисунок 5.9. Алгоритм формирования кода номера сегмента

Во втором такте управляющая логическая схема УЛС и СПСЭ обеспечивают подачу на вход схемы сравнения эталонного сигнала Uэт = 128 ∆0, соответствующего нижней границе четвёртого (среднего) сегмента. Если амплитуда отсчёта UАИМ ≥ Uэт = 128 ∆0, то принимается решение, что амплитуда отсчёта попадёт в один из четырёх вышележащих сегментов и формируется очередной символ X = 1, который по цепи обратной связи поступает на вход УЛС. В противном случае принимается решение, что амплитуда отсчёта попадает в один из нижележащих сегментов и формируется X = 0.

В третьем такте в зависимости от значения предыдущего символа X уточняется номер сегмента, в который попадает амплитуда кодируемого отсчёта. Если X = 1, то УЛС и СПСЭ подают на вход СС эталонное напряжение Uэт = 512 ∆0, соответствующего нижней границе шестого сегмента. При этом, если UАИМ ≥ Uэт = 512 ∆0 то принимается решение, что отсчёт попадает в один из двух вышележащих сегментов и формируется очередной символ Y = 1. В противном случае, если UАИМ ≤ Uэт = 512 ∆0, принимается решение, что отсчёт попадает в два нижележащих сегмента и формируется Y = 0.

Если же X = 0, то УЛС с помощью СПСЭ обеспечивает подачу на вход СС эталонного напряжения Uэт = 32 ∆0, соответствующего нижней границе второго сегмента. Если UАИМ ≥ Uэт = 32 ∆0, то принимается решение, что отсчёт попадает во второй и третий сегменты и формируется Y = 1. Если UАИМ ≤ Uэт = 32 ∆0, то принимается решение, что отсчёт попадает в два нижележащих сегмента и формируется Y = 0.

В четвёртом такте аналогичным образом формируется символ Z и окончательно формируется код номера сегмента. В результате, после четырёх тактов кодирования, сформируется четыре символа восьмиразрядной кодовой комбинации PXYZ (рисунок 5.6) и к СС подключается одно из восьми эталонных напряжений, соответствующих нижней границе сегмента, в котором находится кодируемый отсчёт.

В оставшихся четырёх тактах последовательно формируются символы ABCD кодовой комбинации, значения которых зависят от номера шага квантования внутри сегмента, соответствующего амплитуде кодируемого отсчёта. Поскольку внутри любого сегмента осуществляется равномерное квантование, то процесс кодирования реализуется, как и в линейных кодерах взвешивающего типа, путём последовательного включения эталонных напряжений соответствующих данному сегменту (таблица 5.2).

Практикум на применение нелинейного кодера при компадировании по закону А = 87.6/13:

Например, если на вход кодера поступил положительный отсчёт с амплитудой UАИМ = 889 ∆0, то после первых четырёх тактов сформируются символы PXYZ = 1110 и к СС подключится эталонное напряжение Uэт = 512 ∆0, соответствующее нижней границе шестого сегмента, поскольку кодируемый сигнал находится в этом сегменте. В пятом такте к этому эталонному сигналу добавляется максимальное эталонное напряжение Uэт = 256 ∆0, соответствующее символу А в определителе шага квантования К (рисунок 5.6) шестого сегмента (таблица 5.2). Так как UАИМ > Uэт = (512 +256) ∆0, то формируется символ А = 1 и это эталонное напряжение остаётся включенным. В шестом такте подключается эталонное напряжение соответствующее символу В в определителе шага квантования Uэт = 128 ∆0 и так как UАИМ > Uэт = (512 +256 + 128) ∆0, то на выходе СС формируется символ В = 1 и это эталонное напряжение остаётся включенным. В седьмом такте подключается эталонное напряжение соответствующее символу С в определителе шага квантования Uэт = 64 ∆0 и так как UАИМ < Uэт = (512 +256 + 128 + 64) ∆0, то на выходе СС формируется символ С = 0. В восьмом такте вместо Uэт = 64 ∆0 подключается эталонное напряжение соответствующее символу D в определителе шага квантования Uэт = 32 ∆0 и так как UАИМ < Uэт = (512 +256 + 128 + 32) ∆0, то на выходе СС формируется символ D = 0 и это эталонное напряжение отключается и на этом процесс кодирования очередного отсчёта заканчивается. При этом на выходе кодера сформирована кодовая комбинация PXYZABCD = 11101100, соответствующая амплитуде уравновешивающего АИМ сигнала на входе СС UАИМ = 896 ∆0. Разница между входным и уравновешивающим АИМ сигналами на входах СС представляет ошибку квантования δкв = UАИМ – UАИМ = 7∆0.

5.2. Цифровые иерархии

При выборе иерархии ЦСП должны учитываться следующие требования: стандартизированные скорости передачи цифровых потоков должны выбираться с учётом возможности использования цифровых и аналоговых систем передачи и электрических характеристик существующих и перспективных линий связи; обеспечение возможности как синхронного, так и асинхронного объединения, разделения и транзита цифровых потоков и сигналов в цифровой форме. Кроме того, ЦСП высшего порядка должна удовлетворять требованию независимости скорости передачи в групповом цифровом сигнале от видов передаваемой информации и способа формирования этого сигнала [21].

Указанным требованиям удовлетворяет европейская иерархия ЦСП, которая базируется на первичной ЦСП ИКМ-30 со скоростью передачи группового цифрового сигнала 2048 кбит/с (Fт = 2048 кГц) (рисунок 5.10) [1].

Рисунок 5.10. Европейская иерархия цифровых систем передачи

Относительное возрастание скорости передачи в каждой последующей ступени иерархии по отношению к предыдущей связано с необходимостью увеличения объёма служебной информации при увеличении числа каналов.

Иерархия ЦСП с ИКМ. Упрощенная структурная схема аппаратуры ВРК с ИКМ приведена на рисунке 5.11, где для простоты показано индивидуальное оборудование одного канала.

Рисунок 5.11. Упрощенная структурная схема аппаратуры объединения (АО) и разделения (АР) при ВРК с ИКМ

Телефонное сообщение uк(t) через дифференциальную систему (ДС) фильтр нижних частот (ФНЧ), который ограничивает спектр сигнала частотой 3.4 кГц, подается на вход модулятора АИМ (МАИМ). В модуляторе непрерывный сигнал дискретизируется, то есть превращается в последовательность модулированных по амплитуде импульсов, которые имеют частоту Fд=8 кГц.

Сигналы с АИМ всех каналов объединяются в групповой АИМ сигнал (смотри рисунок 5.1, в), который поступает на компрессор (Км). После компрессии групповой АИМ сигнал квантуется и кодируется в кодере (Кд). С выхода Кд двухуровневый цифровой сигнал подается на устройство объединения (УО), куда поступают импульсы от передатчика (П) СУВ и от передатчика циклового синхросигнала (ПЦС). Таким образом, в УО формируется групповой цифровой сигнал, структура цикла которого показана на рисунке 5.12.

Рисунок 5.12. Структура цикла группового сигнала ВРК с ИКМ

Параметры двоичного цифрового сигнала плохо согласуются с параметрами реальных линий передачи, не пропускающих низкочастотные составляющие спектра такого сигнала. Поэтому двоичный сигнал подвергается перекодированию в преобразователе кода (ПКп) в так называемый код линии, у которого низкочастотные компоненты ослаблены и характеристики вследствие этого лучше сочетаются с параметрами линии. Работа всех блоков АО синхронизируется сигналами, вырабатываемыми распределителем каналов передачи (РКп).

На приёмной стороне ИКМ сигнал подвергается обратному преобразованию в АИМ квантованный сигнал (декодированию). Для этого непрерывный поток символов должен быть разделён на кодовые группы, каждая из которых соответствует одному отсчёту квантованного сигнала. Декодированный сигнал аналогичен квантованным отсчётам исходного сигнала uкв(iTд) (смотри рисунок 5.1, а), которые в своём спектре имеют составляющие с частотами Ωн … Ωв передаваемого сообщения uк(t). Поэтому из импульсной последовательности u*кв(iТд) принятое сообщение u*к(t) выделяется с помощью ФНЧ.

На стороне приёма сигнал по кабелю поступает на преобразователь кода приёма (ПКпр), где код линии преобразуется в двоичный и поступает в устройство разделения (УР). С выхода УР цикловой синхросигнал и СУВ поступают на свои приёмники, а кодовые группы речевых сигналов в декодере (Дк) преобразуются в групповой АИМ сигнал, который после экспандера (Эк) поступает на временные селекторы (ВС), открывающиеся поочерёдно и пропускающие импульсы АИМ, относящиеся к данному каналу. Демодуляция сигнала в канале осуществляется в ФНЧ.

Управление работой АР осуществляет распределитель каналов приёма (РКпр), синхронизация которого производится тактовой частотой, выделяемой из группового цифрового сигнала узкополосным фильтром, расположенным на выходе ПКпр, и цикловой синхронизацией.

Рассмотрим методы синхронизации. Для согласованной работы АО, АР и регенераторов необходимо обеспечить равенство скоростей обработки сигналов, правильное распределение АИМ сигналов и СУВ. Это осуществляется путём синхронизации регенераторов, генераторного оборудования АР по тактовой частоте и по циклам принимаемого цифрового сигнала [3].

При Nгр канальных интервалах и m разрядах в информационных кодовых группах тактовая частота группового цифрового сигнала

Fт = Fд ∙ m ∙ Nгр. (5.7)

Так, для системы ИКМ-30, рассчитанной на Nгр = 32 канальных интервала при восьмиразрядной кодовой группе, Fт = 8∙8∙32 = 2048 кГц. Групповой цифровой сигнал uИКМ(t) представляет собой случайную последовательность двоичных импульсов (рисунок 5.1, в). Эту последовательность можно представить в виде суммы периодической и случайной последовательностей. Периодическая последовательность импульсов имеет дискретный спектр и при τи, равной Т и Т/2, дискретные составляющие будут иметь частоты F=0; Fт и так далее (смотри рисунок 5.13, где эти составляющие отмечены точками). Случайная биполярная последовательность определяет непрерывный спектр (рисунок 5.13) исходной двоичной последовательности.

Рисунок 5.13. Энергетический спектр случайной последовательности двоичных импульсов (а, б) и сигнала с ЧПИ (в) (составляющие дискретного спектра отмечены точками)

Из рисунка 5.13 следует, что максимальную энергию тактовой частоты имеет случайная двоичная последовательность с τи = T/2. Колебания с тактовой частотой Fт выделяются из такой последовательности узкополосным фильтром и используются в регенераторе для синхронизации работы решающего устройства.

Система цикловой синхронизации определяет начало цикла передачи и обеспечивает согласованное с АО распределение декодированных на приемном конце отсчетных значений аналоговых сигналов по своим каналам. Неточность работы цикловой синхронизации приводит к увеличению вероятности ошибки в информационных каналах. Для увеличения помехоустойчивости в качестве циклового синхросигнала (рисунок 5.12) используется группа символов постоянной структуры с частотой следования 4 кГц, то есть ЦС передаются через цикл передачи.

Рассмотрим объединение ЦСП на базе асинхронного ввода цифровых сигналов. Необходимость объединения цифровых потоков возникает при формировании группового цифрового сигнала из цифровых потоков систем более низкого порядка, из различных сигналов, передаваемых в цифровом виде, а также при вводе в групповой цифровой сигнал дискретных сигналов от различных источников информации (рисунок 5.14). Цифровые потоки формируются в ЦСП, задающие генераторы которых могут быть синхронизированы или несинхронизированы с задающим генератором оборудования объединения. В соответствии с этим производится синхронное или асинхронное объединение цифровых потоков.

Рисунок 5.14. Упрощенная структурная схема (а) посимвольное (б) и поканальное (в) объединение цифровых потоков

Для временного объединения асинхронных цифровых потоков необходимо предварительно согласовать их скорости, то есть «привязать» их к одной опорной частоте [3]. На приёме суммарный сигнал распределяется по соответствующим выходам. Приходящие на вход системы передачи биты из четырёх информационных потоков записываются в ячейки памяти запоминающего устройства (ЗУ), а затем считываются с них и направляются в линию. Если содержимое ячеек памяти считалось быстрее, сформировался «пустой» временной интервал для вставки синхроимпульсов. Строгая периодичность синхросигнала – одно из важнейших свойств для его распознавания.

Если же генератор окажется нестабильным, то появится смещение во времени «пустых» интервалов и нарушится строгая периодичность их повторения. Может произойти сбой в работе системы синхронизации и всей аппаратуры в целом. Во избежание этого применяют процедуру выравнивания скоростей или, как часто называют, согласования скоростей.

Специальный контроллер следит за взаимным положением импульсов записи и считывания и, если импульсы считывания начали следовать быстрее (расстояние между соседними парами этих импульсов уменьшается), то контролер сигнализирует, что «пустой» интервал появился раньше времени. Другое устройство вводит в пустой интервал ложный импульс, не несущий никакой информации. В данном случае мы имеем дело с положительным согласованием скоростей.

Описанная выше процедура согласования скоростей называется стаффинг (от английского «staffing» — вставка). На приёмную станцию подаётся команда, что произошло согласование скоростей для ликвидации ложного импульса. Для надёжности команду согласования скоростей многократно дублируют, например, посылают её три раза.

Если же генератор вырабатывает импульсы считывания реже и в цифровом потоке уже должен появиться «пустой» интервал, а тактовые импульсы ещё не считали из ЗУ предшествующий ему информационный импульс, то придётся исключить из цифрового потока лишний бит и предоставить временной интервал для передачи очередного синхроимпульса. Такое согласование получило название отрицательного.

Таким образом, на приёмную станцию необходимо сообщить, какое согласование произошло: положительное или отрицательное. Для этой цели вводят команду «Вид согласования», посылая по другому служебному каналу 1 при положительном согласовании и 0 при отрицательном. Её также повторяют три раза. Таким образом, информация об изъятии или добавлении импульса передается в специально выделенных импульсных позициях, и на основе этой информации, на приемной стороне при разделении цифровых потоков происходит восстановление их скоростей (рисунок 5.14). Объединение потоков с выравниванием скоростей получило название плезиохронного, то есть почти синхронного, а существующая иерархия скоростей передачи цифровых потоков, а, значит, и систем передачи типа ИКМ – плезиохронной цифровой иерархией (по-английски PDH- Plesiohronous Digital Hierarhy).

При асинхронном способе объединения в блоках цифрового сопряжения БЦСпер (рисунок 5.14) скорости цифровых потоков объединяемых систем приводятся в соответствие с их соотношением с тактовой частотой объединенного потока и устанавливаются необходимые временные положения сигналов объединяемых потоков (КЦП – коллектор цифрового потока, РЦП – распределитель цифрового потока). Для синхронизации тракта передачи и приема по групповому цифровому потоку он разбивается на циклы, в начале которых вводится сигнал синхронизации (рисунок 5.14, б и в). При поканальном объединении цифровых потоков сужаются и распределяются во времени интервалы, отводимые для кодовых групп (рисунок 5.14, в).

Указанные иерархии, известные под общим названием PDH, или ПЦИ, сведены в таблицу 5.3.

Таблица 5.3 – Сравнение иерархий

|

Уровень цифровой |

Скорости передач, соответствующие |

||

|

AC: 1544 Кбит/с |

ЯС: 1544 Кбит/с |

EC: 2048 Кбит/с |

|

|

0 |

64 |

64 |

64 |

|

1 |

1544 |

1544 |

2048 |

|

2 |

6312 |

6312 |

8448 |

|

3 |

44736 |

32064 |

34368 |

|

4 |

– |

97728 |

139264 |

Где: АС – американская схема;

ЯС – японская схема;

ЕС – европейская схема.

Но PDH обладала рядом недостатков, а именно:

- затруднённый ввод/вывод цифровых потоков в промежуточных пунктах;

- отсутствие средств сетевого автоматического контроля и управления;

- многоступенчатое восстановление синхронизма требует достаточно большого времени;

Также можно считать недостатком наличие трёх различных иерархий.

Указанные недостатки PDH, а также ряд других факторов привели к разработке в Европе аналогичной синхронной цифровой иерархии SDH.

Синхронная цифровая иерархия.

Новая цифровая иерархия SDH – это способ мультиплексирования различных цифровых данных в единый блок, называемый синхронным транспортным модулем (STM), с целью передачи этого модуля по линии связи [21]. Упрощённая структура STM показана на рисунке 5.15:

Рисунок 5.15 – Структура синхронного транспортного модуля STM-1

Модуль представляет собой фрейм (рамку) 9∙270 = 2430 байт. Кроме передаваемой информации (называемой в литературе полезной нагрузкой), он содержит в 4-й строке указатель (Pointer, PTR), определяющий начало записи полезной нагрузки.

Чтобы определить маршрут транспортного модуля, в левой части рамки записывается секционный заголовок (Section Over Head – SOH). Нижние 5∙9 = 45 байтов (после указателя) отвечают за доставку информации в то место сети, к тому мультиплексору, где этот транспортный модуль будет переформировываться. Данная часть заголовка так и называется: секционный заголовок мультиплексора (MSOH). Верхние 3∙9 = 27 байтов (до указателя) представляют собой секционный заголовок регенератора (RSOH), где будут осуществляться восстановление потока, «поврежденного» помехами, и исправление ошибок в нем.

Один цикл передачи включает в себя считывание в линию такой прямоугольной таблицы. Порядок передачи байтов – слева направо, сверху вниз (так же, как при чтении текста на странице). Продолжительность цикла передачи STM-1 составляет 125 мкс, т.е. он повторяется с частотой 8 кГц. Каждая клеточка соответствует скорости передачи 8 бит ∙ 8 кГц = 64 кбит/с. Значит, если тратить на передачу в линию каждой прямоугольной рамки 125 мкс, то за секунду в линию будет передано 9∙270∙64 Кбит/с = 155520 Кбит/с, т.е. 155 Мбит/с.

Таблица 5.4 – Синхронная цифровая иерархия

|

Уровень |

Тип синхронного |

Скорость передачи, Мбит/с |

|

1 |

STM-1 |

155,520 |

|

2 |

STM-4 |

622,080 |

|

3 |

STM-16 |

2488,320 |

|

4 |

STM-64 |

9953,280 |

Для создания более мощных цифровых потоков в SDH-системах формируется следующая скоростная иерархия (таблица 5.4): 4 модуля STM-1 объединяются путем побайтного мультиплексирования в модуль STM-4, передаваемый со скоростью 622,080 Мбит/с; затем 4 модуля STM-4 объединяются в модуль STM-16 со скоростью передачи 2488,320 Мбит/с; наконец 4 модуля STM-16 могут быть объединены в высокоскоростной модуль STM-64 (9953,280 Мбит/с).

На рисунке 5.17 показано формирование модуля STM-16. Сначала каждые 4 модуля STM-1 с помощью мультиплексоров с четырьмя входами объединяются в модуль STM-4, затем четыре модуля STM-4 мультиплексируются таким же четырёхвходовым мультиплексором в модуль STM-16. Однако существует мультиплексор на 16 входов, с помощью которого можно одновременно объединить 16 модулей STM-1 в один модуль STM-16.

Рисунок 5.16– Формирование синхронного транспортного модуля STM–16

Формирование модуля STM-1. В сети SDH применены принципы контейнерных перевозок. Подлежащие транспортировке сигналы предварительно размещаются в стандартных контейнерах (Container – С). Все операции с контейнерами производятся независимо от их содержания, чем и достигается прозрачность сети SDH, т.е. способность транспортировать различные сигналы, в частности, сигналы PDH [1].

Наиболее близким по скорости к первому уровню иерархии SDH (155,520 Мбит/с) является цифровой поток со скоростью 139,264 Мбит/с, образуемый на выходе аппаратуры плезиохронной цифровой иерархии ИКМ-1920. Его проще всего разместить в модуле STM-1. Для этого поступающий цифровой сигнал сначала «упаковывают» в контейнер (т.е. размещают на определенных позициях его цикла), который обозначается С-4.

Рамка контейнера С-4 содержит 9 строк и 260 однобайтовых столбцов. Добавлением слева еще одного столбца – маршрутного или трактового заголовка (Path Over Head – РОН) – этот контейнер преобразуется в виртуальный контейнер VC-4.

Наконец, чтобы поместить виртуальный контейнер VC-4 в модуль STM-1, его снабжают указателем (PTR), образуя таким образом административный блок AU-4 (Administrative Unit), а последний помещают непосредственно в модуль STM-1 вместе с секционным заголовком SOH (рисунок 5.17 и рисунок 5.18).

Синхронный транспортный модуль STM-1 можно загрузить и плезиохронными потоками со скоростями 2,048 Мбит/с. Такие потоки формируются аппаратурой ИКМ-30, они широко распространены в современных сетях. Для первоначальной «упаковки» используется контейнер С12. Цифровой сигнал размещается на определенных позициях этого контейнера. Путем добавления маршрутного, или транспортного, заголовка (РОН) образуется виртуальный контейнер VC-12. Виртуальные контейнеры формируются и расформировываются в точках окончаниях трактов [1].

Рисунок 5.17. Размещение контейнеров в модуле STM-1

В модуле STM-1 можно разместить 63 виртуальных контейнера VC-12. При этом поступают следующим образом. Виртуальный контейнер VC-12 снабжают указателем (PTR) и образуют тем самым транспортный блок TU-12 (Tributary Unit). Теперь цифровые потоки разных транспортных блоков можно объединять в цифровой поток 155,520 Мбит/с (рисунок 5.18). Сначала три транспортных блока TU-12 путем мультиплексирования объединяют в группу транспортных блоков TUG-2 (Tributary Unit Group), затем семь групп TUG-2 мультиплексируют в группы транспортных блоков TUG-3, а три группы TUG-3 объединяют вместе и помещают в виртуальный контейнер VC-4. Далее путь преобразований известен.

На рисунке 5.18 показан также способ размещения в STM-N, N=1,4,16 различных цифровых потоков от аппаратуры плезиохронной цифровой иерархии. Плезиохронные цифровые потоки всех уровней размещаются в контейнерах С с использованием процедуры выравнивания скоростей (положительного, отрицательного и двухстороннего).

Наличие большого числа указателей (PTR) позволяет совершенно четко определить местонахождение в модуле STM-N любого цифрового потока со скоростями 2,048; 34,368 и 139,264 Мбит/с. Выпускаемые промышленностью мультиплексоры ввода-вывода (Add/Drop Multiplexer – ADM) позволяют ответвлять и добавлять любые цифровые потоки.

Рисунок 5.18. Ввод плезиохронных цифровых потоков в синхронный транспортный модуль STM-N

Важной особенностью аппаратуры SDH является то, что в трактовых и сетевых заголовках помимо маршрутной информации создается много информации, позволяющей обеспечить наблюдение и управление всей сетью в целом, осуществлять дистанционные переключения в мультиплексорах по требованию клиентов, осуществлять контроль и диагностику, своевременно обнаруживать и устранять неисправности, реализовать эффективную эксплуатацию сети и сохранить высокое качество предоставляемых услуг.

Иерархии PDH и SDH взаимодействуют через процедуры мультиплексирования и демультиплексирования потоков PDH в системы SDH.

Основным отличием системы SDH от системы PDH является переход на новый принцип мультиплексирования. В системе SDH производится синхронное мультиплексирование/демультиплексирование, которое позволяет организовывать непосредственный доступ к каналам PDH, которые передаются в сети SDH. Это довольно важное и простое нововведение в технологии привело к тому, что в целом технология мультиплексирования в сети SDH намного сложнее, чем технология в сети PDH, усилились требования по синхронизации и параметрам качества среды передачи и системы передачи, а также увеличилось количество параметров, существенных для работы сети.

Контрольные вопросы:

- Что такое цифровой сигнал?

- Перечислите основные преимущества цифровой связи перед аналоговой?

- Дайте понятие скорости передачи?

- С какой частотой следует дискретизировать аналоговый сигнал?

- Поясните суть квантования?

- Как определить ошибку квантования сигнала?

- Запишите число 859 в двоичной системе счисления.

- Закодируйте положительный отсчёт 358 мА в симметричном восьмиразрядном коде. Чему равна ошибка квантования?

- Дайте понятие плезиохронной цифровой иерархии?

- Для чего необходимо согласование скоростей передачи различных потоков при их объединении в высокоскоростной поток? Как осуществляется согласование?

- Принцип синхронной цифровой иерархии, её преимущества по сравнению с плезиохронной цифровой иерархией?

- Для чего нужен указатель (PTR)?

- Охарактеризуйте структуру синхронного транспортного модуля.

- Как в STM-N размещаются три потока со скоростью 34,368 Мбит/с от аппаратуры плезиохронной цифровой иерархии ИКМ-480.

Ошибка квантования E = em — ea — это разность между реальной продолжительностью события ea и его измеренной продолжительностью em. У вас нет возможности узнать реальную продолжительность события, следовательно, нельзя и обнаружить ошибку квантования, основываясь на отдельном значении. Однако можно доказать наличие ошибки квантования, исследуя группы родственных статистик. Мы уже рассматривали пример, в котором удалось выявить ошибку квантования. В примере 7.5 наличие ошибки квантования удалось определить, заметив, что:

Ошибку квантования легко выявить, исследуя вызов базы данных и выполняемые им события ожидания в системе с низкой загрузкой, где минимизировано влияние других факторов, способных нарушить отношение e и c + Eela.

Рассмотрим фрагмент файла трассировки Oracle8i, который демонстрирует эффект ошибки квантования:

Данный вызов выборки инициировал ровно три события ожидания. Мы знаем, что приведенные значения c, e и ela должны быть связаны таким приблизительным равенством:

В системе с низкой загрузкой величина, на которую отличаются левая и правая части приблизительного равенства, указывает на общую ошибку квантования, присутствующую в пяти измерениях (одно значение c, одно значение e и три значения ela):

С учетом того, что отдельному вызову gettimeofday в большинстве систем соответствует лишь несколько микросекунд ошибки, вызванной влиянием измерителя, получается, что ошибка квантования вносит значительный вклад в «разность» длиной в одну сантисекунду в данных трассировки.

Следующий фрагмент файла трассировки Oracle8i демонстрирует простейший вариант избыточного учета продолжительности, в результате которого возникает отрицательная величина неучтенного времени:

WAIT #96: nam=’db file sequential read’ ela= 0 p1=1 p2=1691 p3=1

FETCH #96:c=1,e=0,p=1,cr=4,cu=0,mis=0,r=1,dep=1,og=4,tim=116694789 В данном случае E = -1 сантисекунда:

При наличии «отрицательной разности» (подобного только что рассмотренному) невозможно все объяснить эффектом влияния измерителя, ведь этот эффект может быть причиной появления только положительных значений неучтенного времени. Можно было бы подумать, что имел место двойной учет использования процессора, но и это не соответствует действительности, т. к. нулевое значение ela свидетельствует о том, что время занятости процессора вообще не учитывалось для события ожидания. В данном случае ошибка квантования имеет преобладающее влияние и приводит к излишнему учету времени для выборки.

В данном случае E = 640 мкс:

В Oracle9i разрешение временной статистики улучшено, но и эта версия отнюдь не защищена от воздействия ошибки квантования, что видно в предложенном ниже фрагменте файла трассировки для E > 0:

Некоторая часть этой ошибки, несомненно, является ошибкой квантования (невозможно, чтобы общее время использования процессора данной выборкой действительно равнялось нулю). Несколько микросекунд следует отнести на счет эффекта влияния измерителя.

Наконец, рассмотрим пример ошибки квантования E < 0 в данных трассировки Oracle9i:

Возможно, в данном случае имел место двойной учет использования процессора. Также вероятно, что именно ошибка квантования внесла основной вклад в полученное время вызова выборки. Избыточный учет 8784 микросекунд говорит о том, что фактический общий расход процессорного времени вызовом базы данных составил, вероятно, всего около (10000 — 8784) мкс = 1,216 мкс.

Диапазон значений ошибки квантования

Величину ошибки квантования, содержащейся во временных статистиках Oracle, нельзя измерить напрямую. Зато можно проанализировать статистические свойства ошибки квантования в данных расширенной трассировки SQL. Во-первых, величина ошибки квантования для конкретного набора данных трассировки ограничена сверху. Легко представить ситуацию, в которой ошибка квантования, вносимая такими характеристиками продолжительности, как e и ela, будет максимальной. Наибольшего значения данная ошибка достигает в том случае, когда в последовательности значений e и ela все отдельные ошибки квантования имеют максимальную величину и их знаки совпадают.

На рис. 7.9 показан пример возникновения описанной ситуации: имеется восемь очень непродолжительных системных вызовов, причем все они попадают на такты интервального таймера. Фактическая длительность каждого события близка к нулю, но измеренная длительность каждого такого события равна одному такту системного таймера. В итоге суммарная фактическая продолжительность всех вызовов близка к нулю, а общая измеренная продолжительность равна 8 тактам. Для такого набора из n = 8 системных вызовов ошибка квантования по существу равна nrx, где rx — это разрешение интервального таймера, с помощью которого измеряется характеристика x.

Думаю, вы обратили внимание, что изображенный на рис. 7.9 случай выглядит надуманно и изобретен исключительно для прояснения вопроса. В реальной жизни подобная ситуация чрезвычайно маловероятна. Вероятность, что n ошибок квантования будут иметь одинаковые знаки, равна всего 0,5n. Вероятность того, что n=8 последовательных

Рис. 7.9. Наихудший вариант накопления ошибки квантования для последовательности измеренных продолжительностей

ошибок квантования будут отрицательными, равна всего 0,00390625 (т. е. приблизительно четыре шанса из тысячи). Для 266 значений шанс совпадения знаков у всех ошибок квантования меньше, чем один из 1080.

Для больших наборов значений длительностей совпадение знаков всех ошибок квантования практически невозможно. Но это не единственное, в чем состоит надуманность ситуации, изображенной на рис. 7.9. Она также предполагает, что абсолютная величина каждой ошибки квантования максимальна. Шансы наступления такого события еще более иллюзорны, чем у совпадения всех знаков ошибок. Например, вероятность того, что величина каждой из n имеющихся ошибок квантования превышает 0,9, равна (1 — 0,9)n. Вероятность того, что величина каждой из n = 266 ошибок квантования превысит 0,9, составляет всего 1 из 10266.

Вероятность того, что все n ошибок квантования имеют одинаковый знак и абсолютная величина всех из них больше m, чрезвычайно мала и равна произведению рассмотренных ранее вероятностей:

P (значения всех n ошибок квантования больше m или меньше -m)=

= (0.5)n(1- m)n

Ошибки квантования для продолжительностей (например, значений e и ela в Oracle) — это случайные числа в диапазоне:

-rx < E < rx где rx — это разрешение интервального таймера, с помощью которого измеряется характеристика x (x- это e или ela).

Так как положительные и отрицательные ошибки квантования возникают c равной вероятностью, средняя ошибка квантования для выбранного набора статистик стремится к нулю даже для больших файлов трассировки. Опираясь на теорему Лапласа (Pierre Simon de Laplace, 1810), можно предсказать вероятность того, что ошибки квантования для статистик e и ela будут превышать указанное пороговое значение для файла трассировки, содержащего определенное количество статистик.

Я начал работать над вычислением вероятности того, что общая ошибка квантования файла трассировки (включая ошибку, вносимую статистикой c) будет превышать заданную величину, однако мое исследование еще не завершено. Мне предстоит получить распределение ошибки квантования для статистики c, что, как я уже говорил, осложняется особенностями получения этой статистики в процессе опроса. Результаты этих изысканий планируется воплотить в одном из будущих проектов.

К счастью, относительно ошибки квантования есть и оптимистические соображения, которые позволяют не слишком расстраиваться по поводу невозможности определения ее величины:

• Во многих сотнях файлов трассировки Oracle, проанализированных нами в hotsos.com, общая продолжительность неучтенного вре-

Что означает «один шанс из десяти в [очень большой] степени»?

Для того чтобы представить себе, что такое «один шанс из 1080», задумайтесь над следующим фактом: ученые утверждают, что в наблюдаемой вселенной содержится всего около 1080 атомов (по данным http:// www.sunspot.noao.edu/sunspot/pr/answerbook/universe.html#q70, http:/ /www.nature.com/nsu/020527/020527-16.html и др.). Это означает, что если бы вам удалось написать на каждом атоме нашей вселенной 266 равномерно распределенных случайных чисел от -1 до +1, то лишь на одном из этих атомов можно было бы ожидать наличия всех 266 чисел с одинаковым знаком.

Представить вторую упомянутую вероятность — «один шанс из 10266»-еще труднее. На этот раз представим себе три уровня вложенных вселенных. То есть что каждый из 1080 атомов нашей вселенной сам по себе является вселенной, состоящей из 1080 вселенных, каждая из которых в свою очередь содержит 1080 атомов. Теперь у нас достаточно атомов для того, чтобы представить себе возможность возникновения ситуации с вероятностью «один из 10240». Даже во вселенных третьего уровня вложенности вероятность появления атома, для которого все 266 его случайных чисел по абсолютной величине больше 0,9, составит один из 100 000 000 000 000 000 000 000 000.

мени в случае корректного сбора данных (см. главу 6) чрезвычайно редко превышала 10% общего времени отклика.

Несмотря на то, что и ошибка квантования, и двойной учет использования процессора могут привести к такому результату, файл трассировки чрезвычайно редко содержит отрицательное неучтенное время, абсолютная величина которого превышала бы 10% общего времени отклика.

В случаях, когда неучтенное время оценивается более чем в 25% времени отклика для корректно собранных данных трассировки, такой объем неучтенного времени почти всегда объясняется одним из двух явлений, описанных в последующих разделах.

Наличие ошибки квантования не лишает нас возможности правильно диагностировать основные причины проблем производительности при помощи файлов расширенной трассировки SQL в Oracle (даже в файлах трассировки Oracle8i, в которых вся статистика приводится с точностью лишь до сотых долей секунды).

Ошибка квантования становится еще менее значимой в Oracle9i благодаря повышению точности измерений.

В некоторых случаях влияние ошибки квантования способно привести к утрате доверия к достоверности данных трассировки Oracle. Наверное, ничто не может так подорвать боевой дух, как подозрение в недостоверности данных, на которые вы полагаетесь. Думаю, что лучшим средством, призванным укрепить веру в получаемые данные, должно служить четкое понимание влияния ошибки квантования.

| Следующая > |

|---|

Sensors

Andrea Colagrossi, … Matteo Battilana, in Modern Spacecraft Guidance, Navigation, and Control, 2023

Quantization errors

Quantization error is a systematic error resulting from the difference between the continuous input value and its quantized output, and it is like round-off and truncation errors. This error is intrinsically associated with the AD conversion that maps the input values from a continuous set to the output values in a countable set, often with a finite number of elements. The quantization error is linked to the resolution of the sensor. Namely, a high-resolution sensor has a small quantization error. Indeed, the maximum quantization error is smaller than the resolution interval of the output, which is associated to the least significant bit representing the smallest variation that can be represented digitally:

LSB=FSR2NBIT

where FSR is the full-scale range of the sensor, and NBIT is the number of bits (i.e., the resolution) used in the AD converter to represent the sensor’s output. Quantization errors are typically not corrected, and the discrete values of the output are directly elaborated by the GNC system, which is designed to operate on digital values.

Fig. 6.9 shows a convenient model block to simulate quantization errors.

Figure 6.9. Quantization error model.

Read full chapter

URL:

https://www.sciencedirect.com/science/article/pii/B9780323909167000068

Digital Filters

Marcio G. Siqueira, Paulo S.R. Diniz, in The Electrical Engineering Handbook, 2005

2.11 Quantization in Digital Filters

Quantization errors in digital filters can be classified as:

- •

-

Round-off errors derived from internal signals that are quantized before or after more down additions;

- •

-

Deviations in the filter response due to finite word length representation of multiplier coefficients; and

- •

-

Errors due to representation of the input signal with a set of discrete levels.

A general, digital filter structure with quantizers before delay elements can be represented as in Figure 2.23, with the quantizers implementing rounding for the granular quantization and saturation arithmetic for the overflow nonlinearity.

FIGURE 2.23. Digital Filter Including Quantizers at the Delay Inputs

The criterion to choose a digital filter structure for a given application entails evaluating known structures with respect to the effects of finite word length arithmetic and choosing the most suitable one.

2.11.1 Coefficient Quantization

Approximations are known to generate digital filter coefficients with high accuracy. After coefficient quantization, the frequency response of the realized digital filter will deviate from the ideal response and eventually fail to meet the prescribed specifications. Because the sensitivity of the filter response to coefficient quantization varies with the structure, the development of low-sensitivity digital filter realizations has raised significant interest (Antoniou, 1993; Diniz et al., 2002).

A common procedure is to design the digital filter with infinite coefficient word length satisfying tighter specifications than required, to quantize the coefficients, and to check if the prescribed specifications are still met.

2.11.2 Quantization Noise

In fixed-point arithmetic, a number with a modulus less than one can be represented as follows:

(2.84)x=b0b1b2b3…bb,

where b0 is the sign bit and where b1b2b3 … bb represent the modulus using a binary code. For digital filtering, the most widely used binary code is the two’s complement representation, where for positive numbers b0 = 0 and for negative numbers b0 = 1. The fractionary part of the number, called x2 here, is represented as:

(2.85)x2={xif b0=0.2−|x|if b0=1.

The discussion here concentrates in the fixed-point implementation.

A finite word length multiplier can be modeled in terms of an ideal multiplier followed by a single noise source e(n) as shown in Figure 2.24.

FIGURE 2.24. Model for the Noise Generated after a Multiplication

For product quantization performed by rounding and for signal levels throughout the filter much larger than the quantization step q = 2−b, it can be shown that the power spectral density of the noise source ei(n) is given by:

(2.86)Pei(z)=q212=2−2b12.

In this case, ei(n) represents a zero mean white noise process. We can consider that in practice, ei(n) and ek(n + l) are statistically independent for any value of n or l (for i ≠ k). As a result, the contributions of different noise sources can be taken into consideration separately by using the principle of superposition.

The power spectral density of the output noise, in a fixed-point digital-filter implementation, is given by:

(2.87)Py(z)=σe2Σi=1KGi(z)Gi(z−1),

where Pei(ejw)=σe2, for all i, and each Gi(z) is a transfer function from multiplier output (gi(n)) to the output of the filter as shown in Figure 2.25. The word length, including sign, is b + 1 bits, and K is the number of multipliers of the filter.

FIGURE 2.25. Digital Filter Including Scaling and Noise Transfer Functions.

2.11.3 Overflow Limit Cycles

Overflow nonlinearities influence the most significant bits of the signal and cause severe distortion. An overflow can give rise to self-sustained, high-amplitude oscillations known as overflow limit cycles. Digital filters, which are free of zero-input limit cycles, are also free of overflow oscillations if the overflow nonlinearities are implemented with saturation arithmetic, that is, by replacing the number in overflow by a number with the same sign and with maximum magnitude that fits the available wordlength.

When there is an input signal applied to a digital filter, overflow might occur. As a result, input signal scaling is required to reduce the probability of overflow to an acceptable level. Ideally, signal scaling should be applied to ensure that the probability of overflow is the same at each internal node of the digital filter. This way, the signal-to-noise ratio is maximized in fixed-point implementations.

In two’s complement arithmetic, the addition of more than two numbers will be correct independently of the order in which they are added even if overflow occurs in a partial summation as long as the overall sum is within the available range to represent the numbers. As a result, a simplified scaling technique can be used where only the multiplier inputs require scaling. To perform scaling, a multiplier is used at the input of the filter section as illustrated in Figure 2.25.

It is possible to show that the signal at the multiplier input is given by:

(2.88)xi(n)=12πj∮cXi(z)zn−1dz=12π∫02πFi(ejω)X(ejω)ejωndω,

where c is the convergence region common to Fi(z) and X(z).

The constant λ is usually calculated by using Lp norm of the transfer function from the filter input to the multiplier input Fi(z), depending on the known properties of the input signal. The Lp norm of Fi(z) is defined as:

(2.89)‖Fi(ejω)‖p=[12π∫02π|Fi(ejω)|pdω]1p,

for each p ≥ 1, such that ∫02π|Fi(ejω)|pdω≤∞. In general, the following inequality is valid:

(2.90)|xi(n)| ≤ ‖Fi‖p‖X‖q, (1p+1q=1),

for p, q = 1, 2 and ∞.

The scaling guarantees that the magnitudes of multiplier inputs are bounded by a number Mmax when |x(n)| ≤ Mmax. Then, to ensure that all multiplier inputs are bounded by Mmax we must choose λ as follows:

(2.91)λ=1Max{‖F1‖p,…,‖F1‖p,…, ‖FK‖p},

which means that:

(2.92)‖F′i(ejω)‖p≤1, for‖X(ejω)‖q ≤ Mmax.

The K is the number of multipliers in the filter.

The norm p is usually chosen to be infinity or 2. The L∞ norm is used for input signals that have some dominating frequency component, whereas the L2 norm is more suitable for a random input signal. Scaling coefficients can be implemented by simple shift operations provided they satisfy the overflow constraints.

In case of modular realizations, such as cascade or parallel realizations of digital filters, optimum scaling is accomplished by applying one scaling multiplier per section.

As an illustration, we present the equation to compute the scaling factor for the cascade realization with direct-form second-order sections:

(2.93)λi=1‖∏j=1i−1Hj(z)Fi(z)‖p,

where:

Fi(z)=1z2+m1iz+m2i.

The noise power spectral density is computed as:

(2.94)Py(z)=σe2[3+3λ12∏i=1mHi(z)Hi(z−1)+5Σj=2m1λj2∏i=jmHi(z)Hi(z−1)],

whereas the output noise variance is given by:

(2.95)σo2=σe2[3+3λ12||∏i=1mHi(ejω)||22+5Σj=2m1λj2||∏i=jmHi(ejω)||22].

As a design rule, the pairing of poles and zeros is performed as explained here: poles closer to the unit circle pair with closer zeros to themselves, such that ||Hi(z)||p is minimized for p = 2 or p = ∞.

For ordering, we define the following:

(2.96)Pi=| |Hi(z)| |∞| |Hi(z)| |2.

For L2 scaling, we order the section such that Pi is decreasing. For L∞ scaling, Pi should be increasing.

2.11.4 Granularity Limit Cycles

The quantization noise signals become highly correlated from sample to sample and from source to source when signal levels in a digital filter become constant or very low, at least for short periods of time. This correlation can cause autonomous oscillations called granularity limit cycles.

In recursive digital filters implemented with rounding, magnitude truncation,72 and other types of quantization, limitcycles oscillations might occur.

In many applications, the presence of limit cycles can be harmful. Therefore, it is desirable to eliminate limit cycles or to keep their amplitude bounds low.

If magnitude truncation is used to quantize particular signals in some filter structures, it can be shown that it is possible to eliminate zero-input limit cycles. As a consequence, these digital filters are free of overflow limit cycles when overflow nonlinearities, such as saturation arithmetic, are used.

In general, the referred methodology can be applied to the following class of structures:

- •

-

State-space structures: Cascade and parallel realization of second-order state-space structures includes design constraints to control nonlinear oscillations (Diniz and Antoniou, 1986).

- •

-

Wave digital filters: These filters emulate doubly terminated lossless filters and have inherent stability under linear conditions as well as in the nonlinear case where the signals are subjected to quantization (Fettweis, 1986).

- •

-

Lattice realization: Modular structures allowing easy limit cycles elimination (Gray and Markel, 1975).

Read full chapter

URL:

https://www.sciencedirect.com/science/article/pii/B9780121709600500621

Biomedical signals and systems

Sri Krishnan, in Biomedical Signal Analysis for Connected Healthcare, 2021

2.2.1 Noise power

The quantization error (e) or noise tends to have a random behavior, and they could be mathematically represented using statistical variables. Power of a random variable with a probability density function of p(e) could be obtained by computing the second-order statistics of variance, and it is denoted by

σ2=∫−q/2q/2e2p(e)de