From Wikipedia, the free encyclopedia

In statistics, the mean squared error (MSE)[1] or mean squared deviation (MSD) of an estimator (of a procedure for estimating an unobserved quantity) measures the average of the squares of the errors—that is, the average squared difference between the estimated values and the actual value. MSE is a risk function, corresponding to the expected value of the squared error loss.[2] The fact that MSE is almost always strictly positive (and not zero) is because of randomness or because the estimator does not account for information that could produce a more accurate estimate.[3] In machine learning, specifically empirical risk minimization, MSE may refer to the empirical risk (the average loss on an observed data set), as an estimate of the true MSE (the true risk: the average loss on the actual population distribution).

The MSE is a measure of the quality of an estimator. As it is derived from the square of Euclidean distance, it is always a positive value that decreases as the error approaches zero.

The MSE is the second moment (about the origin) of the error, and thus incorporates both the variance of the estimator (how widely spread the estimates are from one data sample to another) and its bias (how far off the average estimated value is from the true value).[citation needed] For an unbiased estimator, the MSE is the variance of the estimator. Like the variance, MSE has the same units of measurement as the square of the quantity being estimated. In an analogy to standard deviation, taking the square root of MSE yields the root-mean-square error or root-mean-square deviation (RMSE or RMSD), which has the same units as the quantity being estimated; for an unbiased estimator, the RMSE is the square root of the variance, known as the standard error.

Definition and basic properties[edit]

The MSE either assesses the quality of a predictor (i.e., a function mapping arbitrary inputs to a sample of values of some random variable), or of an estimator (i.e., a mathematical function mapping a sample of data to an estimate of a parameter of the population from which the data is sampled). The definition of an MSE differs according to whether one is describing a predictor or an estimator.

Predictor[edit]

If a vector of

In other words, the MSE is the mean

In matrix notation,

where

The MSE can also be computed on q data points that were not used in estimating the model, either because they were held back for this purpose, or because these data have been newly obtained. Within this process, known as statistical learning, the MSE is often called the test MSE,[4] and is computed as

Estimator[edit]

The MSE of an estimator

This definition depends on the unknown parameter, but the MSE is a priori a property of an estimator. The MSE could be a function of unknown parameters, in which case any estimator of the MSE based on estimates of these parameters would be a function of the data (and thus a random variable). If the estimator

The MSE can be written as the sum of the variance of the estimator and the squared bias of the estimator, providing a useful way to calculate the MSE and implying that in the case of unbiased estimators, the MSE and variance are equivalent.[5]

Proof of variance and bias relationship[edit]

An even shorter proof can be achieved using the well-known formula that for a random variable

But in real modeling case, MSE could be described as the addition of model variance, model bias, and irreducible uncertainty (see Bias–variance tradeoff). According to the relationship, the MSE of the estimators could be simply used for the efficiency comparison, which includes the information of estimator variance and bias. This is called MSE criterion.

In regression[edit]

In regression analysis, plotting is a more natural way to view the overall trend of the whole data. The mean of the distance from each point to the predicted regression model can be calculated, and shown as the mean squared error. The squaring is critical to reduce the complexity with negative signs. To minimize MSE, the model could be more accurate, which would mean the model is closer to actual data. One example of a linear regression using this method is the least squares method—which evaluates appropriateness of linear regression model to model bivariate dataset,[6] but whose limitation is related to known distribution of the data.

The term mean squared error is sometimes used to refer to the unbiased estimate of error variance: the residual sum of squares divided by the number of degrees of freedom. This definition for a known, computed quantity differs from the above definition for the computed MSE of a predictor, in that a different denominator is used. The denominator is the sample size reduced by the number of model parameters estimated from the same data, (n−p) for p regressors or (n−p−1) if an intercept is used (see errors and residuals in statistics for more details).[7] Although the MSE (as defined in this article) is not an unbiased estimator of the error variance, it is consistent, given the consistency of the predictor.

In regression analysis, «mean squared error», often referred to as mean squared prediction error or «out-of-sample mean squared error», can also refer to the mean value of the squared deviations of the predictions from the true values, over an out-of-sample test space, generated by a model estimated over a particular sample space. This also is a known, computed quantity, and it varies by sample and by out-of-sample test space.

Examples[edit]

Mean[edit]

Suppose we have a random sample of size

which has an expected value equal to the true mean

where

For a Gaussian distribution, this is the best unbiased estimator (i.e., one with the lowest MSE among all unbiased estimators), but not, say, for a uniform distribution.

Variance[edit]

The usual estimator for the variance is the corrected sample variance:

This is unbiased (its expected value is

where

However, one can use other estimators for

then we calculate:

This is minimized when

For a Gaussian distribution, where

Further, while the corrected sample variance is the best unbiased estimator (minimum mean squared error among unbiased estimators) of variance for Gaussian distributions, if the distribution is not Gaussian, then even among unbiased estimators, the best unbiased estimator of the variance may not be

Gaussian distribution[edit]

The following table gives several estimators of the true parameters of the population, μ and σ2, for the Gaussian case.[9]

| True value | Estimator | Mean squared error |

|---|---|---|

|

= the unbiased estimator of the population mean, = the unbiased estimator of the population mean,  |

|

|

= the unbiased estimator of the population variance, = the unbiased estimator of the population variance,  |

|

|

= the biased estimator of the population variance, = the biased estimator of the population variance,  |

|

|

= the biased estimator of the population variance, = the biased estimator of the population variance,  |

|

Interpretation[edit]

An MSE of zero, meaning that the estimator

Values of MSE may be used for comparative purposes. Two or more statistical models may be compared using their MSEs—as a measure of how well they explain a given set of observations: An unbiased estimator (estimated from a statistical model) with the smallest variance among all unbiased estimators is the best unbiased estimator or MVUE (Minimum-Variance Unbiased Estimator).

Both analysis of variance and linear regression techniques estimate the MSE as part of the analysis and use the estimated MSE to determine the statistical significance of the factors or predictors under study. The goal of experimental design is to construct experiments in such a way that when the observations are analyzed, the MSE is close to zero relative to the magnitude of at least one of the estimated treatment effects.

In one-way analysis of variance, MSE can be calculated by the division of the sum of squared errors and the degree of freedom. Also, the f-value is the ratio of the mean squared treatment and the MSE.

MSE is also used in several stepwise regression techniques as part of the determination as to how many predictors from a candidate set to include in a model for a given set of observations.

Applications[edit]

- Minimizing MSE is a key criterion in selecting estimators: see minimum mean-square error. Among unbiased estimators, minimizing the MSE is equivalent to minimizing the variance, and the estimator that does this is the minimum variance unbiased estimator. However, a biased estimator may have lower MSE; see estimator bias.

- In statistical modelling the MSE can represent the difference between the actual observations and the observation values predicted by the model. In this context, it is used to determine the extent to which the model fits the data as well as whether removing some explanatory variables is possible without significantly harming the model’s predictive ability.

- In forecasting and prediction, the Brier score is a measure of forecast skill based on MSE.

Loss function[edit]

Squared error loss is one of the most widely used loss functions in statistics[citation needed], though its widespread use stems more from mathematical convenience than considerations of actual loss in applications. Carl Friedrich Gauss, who introduced the use of mean squared error, was aware of its arbitrariness and was in agreement with objections to it on these grounds.[3] The mathematical benefits of mean squared error are particularly evident in its use at analyzing the performance of linear regression, as it allows one to partition the variation in a dataset into variation explained by the model and variation explained by randomness.

Criticism[edit]

The use of mean squared error without question has been criticized by the decision theorist James Berger. Mean squared error is the negative of the expected value of one specific utility function, the quadratic utility function, which may not be the appropriate utility function to use under a given set of circumstances. There are, however, some scenarios where mean squared error can serve as a good approximation to a loss function occurring naturally in an application.[10]

Like variance, mean squared error has the disadvantage of heavily weighting outliers.[11] This is a result of the squaring of each term, which effectively weights large errors more heavily than small ones. This property, undesirable in many applications, has led researchers to use alternatives such as the mean absolute error, or those based on the median.

See also[edit]

- Bias–variance tradeoff

- Hodges’ estimator

- James–Stein estimator

- Mean percentage error

- Mean square quantization error

- Mean square weighted deviation

- Mean squared displacement

- Mean squared prediction error

- Minimum mean square error

- Minimum mean squared error estimator

- Overfitting

- Peak signal-to-noise ratio

Notes[edit]

- ^ This can be proved by Jensen’s inequality as follows. The fourth central moment is an upper bound for the square of variance, so that the least value for their ratio is one, therefore, the least value for the excess kurtosis is −2, achieved, for instance, by a Bernoulli with p=1/2.

References[edit]

- ^ a b «Mean Squared Error (MSE)». www.probabilitycourse.com. Retrieved 2020-09-12.

- ^ Bickel, Peter J.; Doksum, Kjell A. (2015). Mathematical Statistics: Basic Ideas and Selected Topics. Vol. I (Second ed.). p. 20.

If we use quadratic loss, our risk function is called the mean squared error (MSE) …

- ^ a b Lehmann, E. L.; Casella, George (1998). Theory of Point Estimation (2nd ed.). New York: Springer. ISBN 978-0-387-98502-2. MR 1639875.

- ^ Gareth, James; Witten, Daniela; Hastie, Trevor; Tibshirani, Rob (2021). An Introduction to Statistical Learning: with Applications in R. Springer. ISBN 978-1071614174.

- ^ Wackerly, Dennis; Mendenhall, William; Scheaffer, Richard L. (2008). Mathematical Statistics with Applications (7 ed.). Belmont, CA, USA: Thomson Higher Education. ISBN 978-0-495-38508-0.

- ^ A modern introduction to probability and statistics : understanding why and how. Dekking, Michel, 1946-. London: Springer. 2005. ISBN 978-1-85233-896-1. OCLC 262680588.

{{cite book}}: CS1 maint: others (link) - ^ Steel, R.G.D, and Torrie, J. H., Principles and Procedures of Statistics with Special Reference to the Biological Sciences., McGraw Hill, 1960, page 288.

- ^ Mood, A.; Graybill, F.; Boes, D. (1974). Introduction to the Theory of Statistics (3rd ed.). McGraw-Hill. p. 229.

- ^ DeGroot, Morris H. (1980). Probability and Statistics (2nd ed.). Addison-Wesley.

- ^ Berger, James O. (1985). «2.4.2 Certain Standard Loss Functions». Statistical Decision Theory and Bayesian Analysis (2nd ed.). New York: Springer-Verlag. p. 60. ISBN 978-0-387-96098-2. MR 0804611.

- ^ Bermejo, Sergio; Cabestany, Joan (2001). «Oriented principal component analysis for large margin classifiers». Neural Networks. 14 (10): 1447–1461. doi:10.1016/S0893-6080(01)00106-X. PMID 11771723.

Среднеквадратичная ошибка (Mean Squared Error) – Среднее арифметическое (Mean) квадратов разностей между предсказанными и реальными значениями Модели (Model) Машинного обучения (ML):

Рассчитывается с помощью формулы, которая будет пояснена в примере ниже:

$$MSE = frac{1}{n} × sum_{i=1}^n (y_i — widetilde{y}_i)^2$$

$$MSEspace{}{–}space{Среднеквадратическая}space{ошибка,}$$

$$nspace{}{–}space{количество}space{наблюдений,}$$

$$y_ispace{}{–}space{фактическая}space{координата}space{наблюдения,}$$

$$widetilde{y}_ispace{}{–}space{предсказанная}space{координата}space{наблюдения,}$$

MSE практически никогда не равен нулю, и происходит это из-за элемента случайности в данных или неучитывания Оценочной функцией (Estimator) всех факторов, которые могли бы улучшить предсказательную способность.

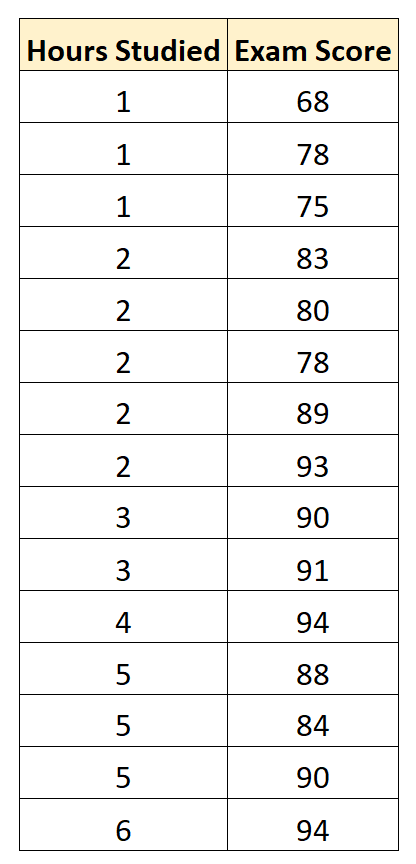

Пример. Исследуем линейную регрессию, изображенную на графике выше, и установим величину среднеквадратической Ошибки (Error). Фактические координаты точек-Наблюдений (Observation) выглядят следующим образом:

Мы имеем дело с Линейной регрессией (Linear Regression), потому уравнение, предсказывающее положение записей, можно представить с помощью формулы:

$$y = M * x + b$$

$$yspace{–}space{значение}space{координаты}space{оси}space{y,}$$

$$Mspace{–}space{уклон}space{прямой}$$

$$xspace{–}space{значение}space{координаты}space{оси}space{x,}$$

$$bspace{–}space{смещение}space{прямой}space{относительно}space{начала}space{координат}$$

Параметры M и b уравнения нам, к счастью, известны в данном обучающем примере, и потому уравнение выглядит следующим образом:

$$y = 0,5252 * x + 17,306$$

Зная координаты реальных записей и уравнение линейной регрессии, мы можем восстановить полные координаты предсказанных наблюдений, обозначенных серыми точками на графике выше. Простой подстановкой значения координаты x в уравнение мы рассчитаем значение координаты ỹ:

Рассчитаем квадрат разницы между Y и Ỹ:

Сумма таких квадратов равна 4 445. Осталось только разделить это число на количество наблюдений (9):

$$MSE = frac{1}{9} × 4445 = 493$$

Само по себе число в такой ситуации становится показательным, когда Дата-сайентист (Data Scientist) предпринимает попытки улучшить предсказательную способность модели и сравнивает MSE каждой итерации, выбирая такое уравнение, что сгенерирует наименьшую погрешность в предсказаниях.

MSE и Scikit-learn

Среднеквадратическую ошибку можно вычислить с помощью SkLearn. Для начала импортируем функцию:

import sklearn

from sklearn.metrics import mean_squared_errorИнициализируем крошечные списки, содержащие реальные и предсказанные координаты y:

y_true = [5, 41, 70, 77, 134, 68, 138, 101, 131]

y_pred = [23, 35, 55, 90, 93, 103, 118, 121, 129]Инициируем функцию mean_squared_error(), которая рассчитает MSE тем же способом, что и формула выше:

mean_squared_error(y_true, y_pred)

Интересно, что конечный результат на 3 отличается от расчетов с помощью Apple Numbers:

496.0Ноутбук, не требующий дополнительной настройки на момент написания статьи, можно скачать здесь.

Автор оригинальной статьи: @mmoshikoo

Фото: @tobyelliott

В статистике , то средний квадрат ошибка ( СКО ) , или среднее отклонение в квадрате ( МСД ) из оценки (методик для оценки в ненаблюдаемом количестве) измеряет среднее из квадратов ошибок , то есть, средний квадрата разность между планируемым значения и фактическое значение. MSE — это функция риска , соответствующая ожидаемому значению квадрата потери ошибок. Тот факт, что MSE почти всегда строго положительный (а не нулевой), объясняется случайностью или тем, что оценщик не учитывает информацию, которая могла бы дать более точную оценку.

MSE — это показатель качества оценщика. Поскольку оно вычисляется из квадрата евклидова расстояния , оно всегда является положительным значением, при этом ошибка уменьшается по мере приближения к нулю.

MSE — это второй момент (о происхождении) ошибки и, таким образом, включает как дисперсию оценки (насколько широко разбросаны оценки от одной выборки данных к другой), так и ее смещение (насколько далеко от среднего оценочного значения от истинного значения). Для несмещенной оценки MSE — это дисперсия оценки. Как и дисперсия, MSE имеет те же единицы измерения, что и квадрат оцениваемой величины. По аналогии со стандартным отклонением извлечение квадратного корня из MSE дает среднеквадратичную ошибку или среднеквадратичное отклонение (RMSE или RMSD), которое имеет те же единицы, что и оцениваемая величина; для несмещенной оценки RMSE — это квадратный корень из дисперсии , известный как стандартная ошибка .

Определение и основные свойства

СКО либо оценивает качество предсказателя (т.е. функция отображения произвольных входов к выборке значений некоторой случайной величины ), либо из оценки (т.е. математическая функция отображения выборки данных для оценки в параметре из население , из которого отбирают данные). Определение MSE различается в зависимости от того, описывается ли предсказатель или оценщик.

Предсказатель

Если вектор прогнозов сгенерирован из выборки точек данных по всем переменным и является вектором наблюдаемых значений прогнозируемой переменной с прогнозируемыми значениями (например, методом наименьших квадратов ), то в пределах- образец MSE предсказателя вычисляется как

Другими словами, MSE является среднее из квадратов ошибок . Это легко вычисляемая величина для конкретного образца (и, следовательно, зависит от образца).

В матричных обозначениях

где есть и — матрица.

СКО также можно вычислить по q точкам данных, которые не использовались при оценке модели, либо потому, что они не использовались для этой цели, либо потому, что эти данные были получены заново. В этом процессе (известном как перекрестная проверка ) MSE часто называют среднеквадратической ошибкой предсказания и вычисляют как

Оценщик

MSE оценщика по отношению к неизвестному параметру определяется как

Это определение зависит от неизвестного параметра, но MSE априори является свойством оценщика. MSE может быть функцией неизвестных параметров, и в этом случае любая оценка MSE, основанная на оценках этих параметров, будет функцией данных (и, следовательно, случайной величиной). Если оценщик получен как статистика выборки и используется для оценки некоторого параметра совокупности, то ожидание относится к распределению выборки статистики выборки.

СКО может быть записано как сумма дисперсии оценочного устройства и квадрата смещения оценщика, обеспечивая полезный способ вычисления СКО и подразумевая, что в случае несмещенных оценщиков СКО и дисперсия эквивалентны.

Доказательство отношения дисперсии и предвзятости

В качестве альтернативы у нас есть

Еще более короткое доказательство, использующее известную формулу для случайной величины (и, в частности, для )

:

Но в реальном случае моделирования MSE можно описать как добавление дисперсии модели, систематической ошибки модели и неснижаемой неопределенности. В соответствии с этим соотношением, MSE оценщиков можно просто использовать для сравнения эффективности , которое включает в себя информацию о дисперсии и смещении оценщика. Это называется критерием MSE.

В регрессе

В регрессионном анализе построение графиков является более естественным способом просмотра общей тенденции всех данных. Среднее значение расстояния от каждой точки до прогнозируемой регрессионной модели может быть вычислено и показано как среднеквадратичная ошибка. Возведение в квадрат критически важно для уменьшения сложности с отрицательными знаками. Чтобы свести к минимуму MSE, модель могла бы быть более точной, что означало бы, что модель ближе к фактическим данным. Одним из примеров линейной регрессии с использованием этого метода является метод наименьших квадратов, который оценивает соответствие модели линейной регрессии модели двумерного набора данных , но чье ограничение связано с известным распределением данных.

Термин среднеквадратичная ошибка иногда используется для обозначения несмещенной оценки дисперсии ошибки: остаточная сумма квадратов, деленная на количество степеней свободы . Это определение известной вычисленной величины отличается от приведенного выше определения вычисленной MSE предиктора тем, что используется другой знаменатель. Знаменатель — это размер выборки, уменьшенный на количество параметров модели, оцененных на основе тех же данных, ( n — p ) для p регрессоров или ( n — p -1), если используется перехват (см. Ошибки и остатки в статистике для более подробной информации. ). Хотя MSE (как определено в этой статье) не является объективной оценкой дисперсии ошибок, она согласована , учитывая согласованность предсказателя.

В регрессионном анализе «среднеквадратичная ошибка», часто называемая среднеквадратической ошибкой прогноза или « среднеквадратичной ошибкой вне выборки», также может относиться к среднему значению квадратов отклонений прогнозов от истинных значений в пределах тестовое пространство вне выборки , сгенерированное моделью, оцененной по определенному пространству выборки . Это также известная вычисляемая величина, и она варьируется в зависимости от образца и тестового пространства вне выборки.

Примеры

Иметь в виду

Предположим, у нас есть случайная выборка размера из совокупности . Предположим, что образцы были выбраны с заменой . То есть единицы выбираются по одному, и ранее выбранные единицы по-прежнему имеют право на выбор для всех розыгрышей. Обычная оценка для выборочного среднего

который имеет ожидаемое значение, равное истинному среднему (так что оно несмещено), и среднеквадратичную ошибку

где — дисперсия населения .

Для гауссовского распределения это лучшая несмещенная оценка (т. Е. С самой низкой MSE среди всех несмещенных оценок), но не, скажем, для равномерного распределения .

Дисперсия

Обычной оценкой дисперсии является скорректированная выборочная дисперсия :

Это несмещенное значение (его ожидаемое значение равно ), поэтому оно также называется несмещенной дисперсией выборки, а его MSE равно

где — четвертый центральный момент распределения или популяции, а — избыточный эксцесс .

Однако можно использовать другие оценки, для которых пропорциональны , и соответствующий выбор всегда может дать более низкую среднеквадратичную ошибку. Если мы определим

затем рассчитываем:

Это сводится к минимуму, когда

Для гауссова распределения , где это означает, что MSE минимизируется при делении суммы на . Минимальный избыточный эксцесс равен , который достигается распределением Бернулли с p = 1/2 (подбрасывание монеты), а MSE минимизирована для Следовательно, независимо от эксцесса, мы получаем «лучшую» оценку (в смысле наличия более низкая MSE) за счет небольшого уменьшения несмещенной оценки; это простой пример оценщика усадки : один «сжимает» оценщик до нуля (уменьшает несмещенный оценщик).

Кроме того, хотя скорректированная дисперсия выборки является лучшей несмещенной оценкой (минимальная среднеквадратическая ошибка среди несмещенных оценок) дисперсии для гауссовских распределений, если распределение не является гауссовым, то даже среди несмещенных оценок лучшая несмещенная оценка дисперсии может не быть

Гауссово распределение

В следующей таблице приведены несколько оценок истинных параметров совокупности μ и σ 2 для гауссовского случая.

| Истинное значение | Оценщик | Среднеквадратичная ошибка |

|---|---|---|

|

= несмещенная оценка среднего значения генеральной совокупности , = несмещенная оценка среднего значения генеральной совокупности , |

|

|

= несмещенная оценка дисперсии генеральной совокупности , = несмещенная оценка дисперсии генеральной совокупности , |

|

|

= смещенная оценка дисперсии генеральной совокупности , = смещенная оценка дисперсии генеральной совокупности , |

|

|

= смещенная оценка дисперсии генеральной совокупности , = смещенная оценка дисперсии генеральной совокупности , |

|

Интерпретация

Значение MSE, равное нулю, означающее, что оценщик предсказывает наблюдения параметра с идеальной точностью, является идеальным (но обычно невозможно).

Значения MSE могут использоваться для сравнительных целей. Две или более статистических моделей можно сравнить с использованием их MSE — в качестве меры того, насколько хорошо они объясняют данный набор наблюдений: несмещенная оценка (оцененная на основе статистической модели) с наименьшей дисперсией среди всех несмещенных оценок является лучшей несмещенной оценкой или MVUE (Несмещенная оценка минимальной дисперсии).

Как анализ дисперсии, так и методы линейной регрессии оценивают MSE как часть анализа и используют оцененную MSE для определения статистической значимости изучаемых факторов или предикторов. Цель экспериментального плана состоит в том, чтобы построить эксперименты таким образом, чтобы при анализе наблюдений MSE была близка к нулю относительно величины по крайней мере одного из оцененных эффектов лечения.

При одностороннем дисперсионном анализе MSE можно вычислить путем деления суммы квадратов ошибок и степени свободы. Кроме того, значение f представляет собой отношение среднего квадрата обработки и MSE.

MSE также используется в нескольких методах пошаговой регрессии как часть определения того, сколько предикторов из набора кандидатов включить в модель для данного набора наблюдений.

Приложения

- Минимизация MSE является ключевым критерием при выборе оценщиков: см. Минимальную среднеквадратичную ошибку . Среди несмещенных оценщиков минимизация MSE эквивалентна минимизации дисперсии, а оценщик, который делает это, является несмещенной оценкой с минимальной дисперсией . Однако смещенная оценка может иметь более низкую MSE; см. смещение оценки .

- В статистическом моделировании MSE может представлять разницу между фактическими наблюдениями и значениями наблюдений, предсказанными моделью. В этом контексте он используется для определения степени, в которой модель соответствует данным, а также для определения того, возможно ли удаление некоторых объясняющих переменных без значительного ущерба для предсказательной способности модели.

- В прогнозировании и прогнозировании , то оценка Шиповник является мерой успешности прогнозов на основе MSE.

Функция потерь

Квадратичная потеря ошибок — одна из наиболее широко используемых функций потерь в статистике, хотя ее широкое использование проистекает больше из математического удобства, чем из соображений фактических потерь в приложениях. Карл Фридрих Гаусс , который ввел использование среднеквадратичной ошибки, осознавал ее произвол и был согласен с возражениями против нее на этих основаниях. Математические преимущества среднеквадратичной ошибки особенно очевидны при ее использовании при анализе эффективности линейной регрессии , поскольку она позволяет разделить вариацию в наборе данных на вариации, объясняемые моделью, и вариации, объясняемые случайностью.

Критика

Использование среднеквадратичной ошибки без вопросов подвергалось критике со стороны теоретика принятия решений Джеймса Бергера . Среднеквадратичная ошибка — это отрицательное значение ожидаемого значения одной конкретной функции полезности , квадратичной функции полезности, которая может не быть подходящей функцией полезности для использования в данном наборе обстоятельств. Однако есть некоторые сценарии, в которых среднеквадратическая ошибка может служить хорошим приближением к функции потерь, естественным образом возникающей в приложении.

Подобно дисперсии , среднеквадратичная ошибка имеет тот недостаток, что сильно взвешиваются выбросы . Это результат возведения в квадрат каждого члена, который фактически дает больший вес большим ошибкам, чем малым. Это свойство, нежелательное для многих приложений, заставило исследователей использовать альтернативы, такие как средняя абсолютная ошибка или те, которые основаны на медиане .

Смотрите также

- Компромисс смещения и дисперсии

- Оценщик Ходжеса

- Оценка Джеймса – Стейна

- Средняя процентная ошибка

- Среднеквадратичная ошибка квантования

- Среднеквадратичное взвешенное отклонение

- Среднеквадратичное смещение

- Среднеквадратичная ошибка прогноза

- Минимальная среднеквадратичная ошибка

- Оценщик минимальной среднеквадратичной ошибки

- Переоснащение

- Пиковое отношение сигнал / шум

Примечания

использованная литература

Краткая объяснение что такое RMSE применительно к данным ДЗЗ

Содержание

- 1 Введение

- 2 Связь со средним расстоянием

- 3 Вклад точки в общую RMSE

- 4 Допуск RMSE

- 5 Оценка RMSE

- 6 Ссылки по теме

Введение

Среднеквадратичная ошибка (Root Mean Square Error, RMS Error, RMSE) — расстояние между двумя точками.

В случае если речь идет о привязке данных, в качестве точек между которыми измеряется расстояние могут выступать:

- Исходная точка и конечная точки (например результат трансформации), в этом случае RMSE будет показателем насколько исходная точка близка к конечной — текущая ошибка.

- Желаемое положение выходной точки (точка поставленная пользователем) и результатом ее трансформации (точка поставленная моделью). Трансформация — то или иное математическое преобразование исходных координат в конечные, примером такого преобразования может быть аффинная или полиномиальная трансформация. В данном случае RMSE показывает насколько используемая трансформация позволяет точно приблизить исходную точку к конечной, т.е. RMSE в этом случае — ошибка трансформации.

Как видно на иллюстрации ниже, выходные точки 1, 2, 3 поставленные оператором (синие) совпадают с трансформированными (расчетными) значениями (зеленые) и не видны из-за точного совпадения, а вот точка 4 поставлена не там, куда бы она попала используя ту же трансформацию, это дает возможность вычислить для нее RMSE, для точек 1, 2, 3 RMSE = 0.

Привязываемое изображение слева, изображение используемое в качестве источника координат (привязанное) справа.

Примечание: здесь и далее в статье, как и в ERDAS IMAGINE Field Guide, RMS определяется как расстояние (длина гипотенузы), что не совсем соответствует определению Root Mean Squared, так как отсутствует компонент усреднения, классический RMS должен вычисляться делением выражения под корнем на N измерений, в этом случае на 2. В данном случае удобнее называть RMS — расстоянием.

Ошибка RMS рассчитывается по следующей формуле, представляющей из себя формулу вычисления расстояния:

где xi, yi — исходные координаты, xr, yr — конечные координаты

RMSE выражается как расстояние в единицах исходной системы координат, то есть, если вы привязываете только что отсканированную карту, то RMSE будет выражаться в пикселях (или долях пикселя), если вы производите дополнительную привязку снимка, то RMSE будет показывать значения в метрах. Значение RMSE равное 2 для определенной точки будет означать, что ее исходная координата удалена на 2 пикселя или метра от конечной (расчетной) точки.

Чтобы лучше понять когда и как можно получить RMSE при привязке можно использовать следующий алгоритм, иллюстрирующую процесс привязки с помощью аффинного преобразования:

- Получение изображения, например сканированием, изображение получает пиксельную систему координат X,Y (колонка, ряд).

- Расстановка трех точек с начальными и конечными координатами. Эти координаты указывают:

- Начальные координаты — положение точки на непривязанном материале (координаты конкретного пиксела по системе ряд/колонка);

- Конечные координаты — положение точки на привязанном материале, любом источнике координат, географических или спроектированных.

- Три точки — минимальное количество, необходимое для того, чтобы решить систему уравнений аффинного преобразования:

x0 = a+ b*x + c*y

y0 = d + e*x + f*y Решение уравнения заключается в нахождении всех шести коэффициентов, например решением системы уравнений:

x1′ = a + b*x1 + c*y1

y1′ = d + e*x1 + f*y1

x2′ = a + b*x2 + c*y2

y2′ = d + e*x2 + f*y2

x3′ = a + b*x3 + c*y3

y3′ = d + e*x3 + f*y3 Если точек меньше чем минимально необходимо — решить систему невозможно, нельзя найти коэффициенты трансформации и соответственно невозможно произвести пересчет координат. RMSE для точек также вычислить невозможно. - Расстановка минимально необходимого количества точек для данного преобразования (трех) приводит к тому, что RMSE для каждой точки становится равна 0. Можно производить трансформацию. Однако в таком случае мы не можем сделать выводов о качестве точек, ведь для этого надо рассчитать RMSE, а значит….

- Ставим дополнительные точки. Появление новых данных как правило приводит к тому, что то положение, куда мы ставим конечную точку в процессе привязки и ее расчетное положение не совпадают. Это делает возможным расчет RMS ошибки.

С примером и математикой расчета полиномиального преобразования 2-ой степени можно прочитать в статье «Полиномиальные преобразования — вычисления и практика».

Помимо RMSE часто также можно увидеть также значения ошибки по одной из осей X или Y. Эти значения являются остатками (residuals) и могут быть рассчитаны для каждой точки. Изучение значений этих ошибок может помочь понять, почему привязанный материал смещен по одной из осей. Это проблема часто возникает при привязке данных полученных при съемке под углом (не в надир).

Уравнение вычисления RMS для каждой точки можно переписать как:

где XR и YR — остаточные ошибки по X и Y соответственно.

Графически ошибки по X и Y, а также RMSE соотносятся следующим образом:

Вычислив RMSE для каждой точки, можно также определить общую ошибку по X (Rx), Y (Ry) и общую RMSE (T) используя следующие формулы:

где n — число контрольных точек, i — порядковый номер контрольной точки, d — расстояние между парой точек.

Связь со средним расстоянием

Другим, достаточно объективным, способом оценить точность привязки является среднее расстояние, которое очень похоже по формуле на RMSE, но является менее консервативным показателем, так как расстояния не возводятся в квадрат как в RMSE. Выразив расстояние через d, приведем для сравнения формулы вычисления общей RMSE (T) и среднего расстояния (MD):

RMSE является более общеупотребимым в литературе.

Другим распространенным способом описания точности набора измерений являются квантили дробные стандартному отклонению (сигма).

Вклад точки в общую RMSE

Для того, чтобы вычислить вклад точки в общую ошибку (Ei), необходимо разделить RMSE этой точки (Ri) на общую RMSE.

Допуск RMSE

В большинстве случаев, вместо того, чтобы усложнять тип трансформации (например переходить к более высоким порядкам полиномиальных преобразований) имеет смысл допустить некоторую ошибку. Величину допустимой RMSE можно представить как окно, окружающее точку с желаемыми координатами, положением расчетной точки внутри которого считается корректным. Например, если допуск RMSE равен 2, то расчетный пиксел может находится в двух пикселях от указанного оператором и являться допустимым. Величина допустимой ошибки зависит от типа и точности данных, задачи и точности контрольных точек.

Важно помнить, что RMSE указывается в пикселях, поэтому, если привязываются данные Landsat имеющие разрешение 30 метров и задача осуществить привязку с точностью не меньше тех же 30 метров, то RMSE не должна превышать 1.00 (пикселя).

Оценка RMSE

Если RMSE расчитана и найдена слишком высокой, есть 4 варианта решения проблемы:

- Найти и удалить контрольные точки с большой RMSE, подразумевая, что это наименее точные точки. Это чревато еще возникновением еще больших ошибок, если отбраковываемая точка — единственная на большой участок изображения.

- Увеличить допуск RMSE.

- Увеличить сложность функции трансформации, которая более точно будет соответствовать введенным точкам. RMSE точек при этом уменьшится, однако использование сложных криволинейных функций может привести к нежелательным сильным искажениям растра.

- Оставить только точки в которых Вы уверены, что они правильны.

В статье использованы материалы ERDAS IMAGINE Field Guide

Ссылки по теме

- Полиномиальные преобразования

- Полиномиальные преобразования — вычисления и практика

17 авг. 2022 г.

читать 2 мин

Регрессионный анализ — это метод, который мы можем использовать для понимания взаимосвязи между одной или несколькими переменными-предикторами и переменной отклика .

Один из способов оценить, насколько хорошо регрессионная модель соответствует набору данных, — вычислить среднеквадратичную ошибку , которая представляет собой показатель, указывающий нам среднее расстояние между прогнозируемыми значениями из модели и фактическими значениями в наборе данных.

Чем ниже RMSE, тем лучше данная модель может «соответствовать» набору данных.

Формула для нахождения среднеквадратичной ошибки, часто обозначаемая аббревиатурой RMSE , выглядит следующим образом:

СКО = √ Σ(P i – O i ) 2 / n

куда:

- Σ — причудливый символ, означающий «сумма».

- P i — прогнозируемое значение для i -го наблюдения в наборе данных.

- O i — наблюдаемое значение для i -го наблюдения в наборе данных.

- n — размер выборки

В следующем примере показано, как интерпретировать RMSE для данной модели регрессии.

Пример: как интерпретировать RMSE для регрессионной модели

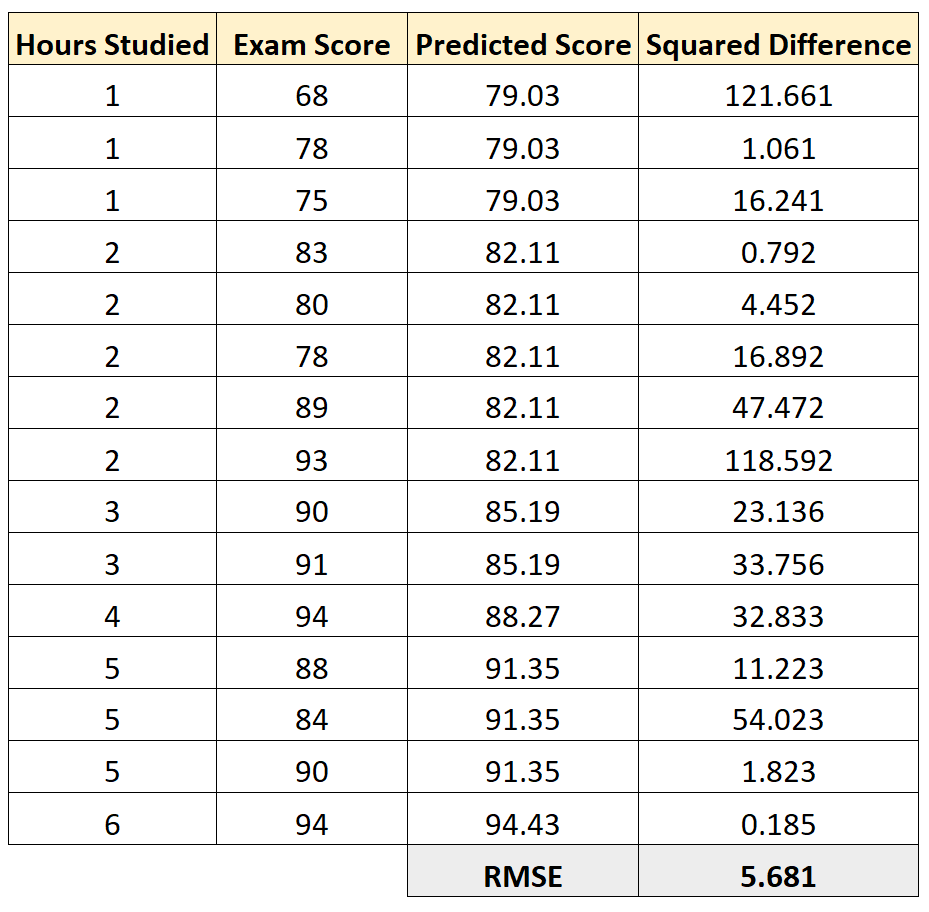

Предположим, мы хотим построить регрессионную модель, которая использует «учебные часы» для прогнозирования «экзаменационного балла» студентов на конкретном вступительном экзамене в колледж.

Мы собираем следующие данные для 15 студентов:

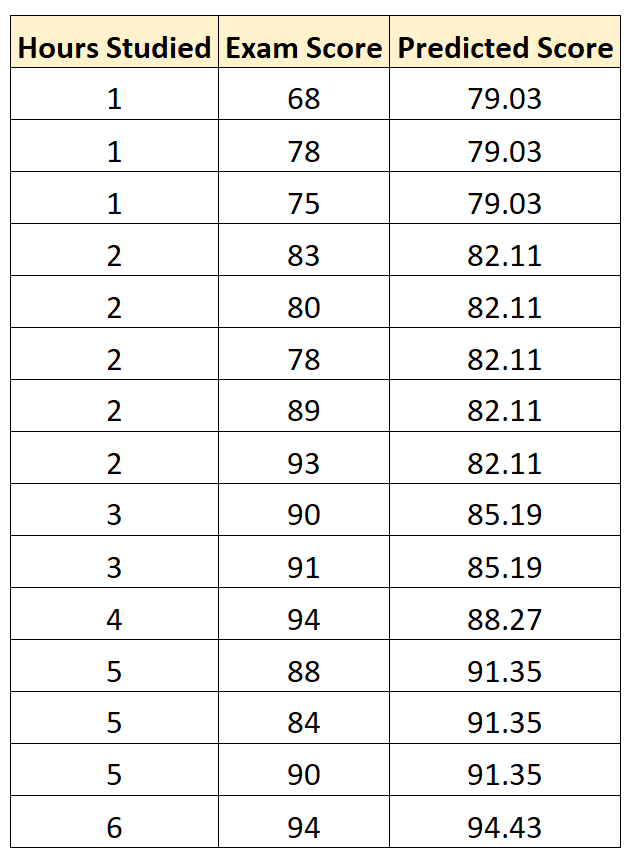

Затем мы используем статистическое программное обеспечение (например, Excel, SPSS, R, Python) и т. д., чтобы найти следующую подогнанную модель регрессии:

Экзаменационный балл = 75,95 + 3,08 * (часы обучения)

Затем мы можем использовать это уравнение, чтобы предсказать экзаменационную оценку каждого студента, исходя из того, сколько часов они учились:

Затем мы можем вычислить квадрат разницы между каждой прогнозируемой оценкой экзамена и фактической оценкой экзамена. Затем мы можем извлечь квадратный корень из среднего значения этих разностей:

RMSE для этой регрессионной модели оказывается равным 5,681 .

Напомним, что остатки регрессионной модели представляют собой разницу между наблюдаемыми значениями данных и значениями, предсказанными моделью.

Остаток = (P i – O i )

куда

- P i — прогнозируемое значение для i -го наблюдения в наборе данных.

- O i — наблюдаемое значение для i -го наблюдения в наборе данных.

И помните, что RMSE регрессионной модели рассчитывается как:

СКО = √ Σ(P i – O i ) 2 / n

Это означает, что RMSE представляет собой квадратный корень из дисперсии остатков.

Это значение полезно знать, поскольку оно дает нам представление о среднем расстоянии между наблюдаемыми значениями данных и прогнозируемыми значениями данных.

Это отличается от R-квадрата модели, который сообщает нам долю дисперсии переменной отклика, которая может быть объяснена предикторной переменной (переменными) в модели.

Сравнение значений RMSE из разных моделей

RMSE особенно полезен для сравнения соответствия различных моделей регрессии.

Например, предположим, что мы хотим построить регрессионную модель, чтобы предсказать результаты экзаменов студентов, и мы хотим найти наилучшую возможную модель среди нескольких потенциальных моделей.

Предположим, мы подгоняем три разные модели регрессии и находим соответствующие им значения RMSE:

- RMSE модели 1: 14,5

- RMSE модели 2: 16,7

- RMSE модели 3: 9,8

Модель 3 имеет самый низкий RMSE, что говорит нам о том, что она способна лучше всего соответствовать набору данных из трех потенциальных моделей.

Дополнительные ресурсы

Калькулятор среднеквадратичной ошибки

Как рассчитать RMSE в Excel

Как рассчитать RMSE в R

Как рассчитать RMSE в Python

![{displaystyle operatorname {MSE} ({hat {theta }})=operatorname {E} _{theta }left[({hat {theta }}-theta )^{2}right].}](https://wikimedia.org/api/rest_v1/media/math/render/svg/9a0e1b3bac58f9ba2d2f4ff8b85b2e35a8f4bf78)

![{displaystyle {begin{aligned}operatorname {MSE} ({hat {theta }})&=operatorname {E} _{theta }left[({hat {theta }}-theta )^{2}right]\&=operatorname {E} _{theta }left[left({hat {theta }}-operatorname {E} _{theta }[{hat {theta }}]+operatorname {E} _{theta }[{hat {theta }}]-theta right)^{2}right]\&=operatorname {E} _{theta }left[left({hat {theta }}-operatorname {E} _{theta }[{hat {theta }}]right)^{2}+2left({hat {theta }}-operatorname {E} _{theta }[{hat {theta }}]right)left(operatorname {E} _{theta }[{hat {theta }}]-theta right)+left(operatorname {E} _{theta }[{hat {theta }}]-theta right)^{2}right]\&=operatorname {E} _{theta }left[left({hat {theta }}-operatorname {E} _{theta }[{hat {theta }}]right)^{2}right]+operatorname {E} _{theta }left[2left({hat {theta }}-operatorname {E} _{theta }[{hat {theta }}]right)left(operatorname {E} _{theta }[{hat {theta }}]-theta right)right]+operatorname {E} _{theta }left[left(operatorname {E} _{theta }[{hat {theta }}]-theta right)^{2}right]\&=operatorname {E} _{theta }left[left({hat {theta }}-operatorname {E} _{theta }[{hat {theta }}]right)^{2}right]+2left(operatorname {E} _{theta }[{hat {theta }}]-theta right)operatorname {E} _{theta }left[{hat {theta }}-operatorname {E} _{theta }[{hat {theta }}]right]+left(operatorname {E} _{theta }[{hat {theta }}]-theta right)^{2}&&operatorname {E} _{theta }[{hat {theta }}]-theta ={text{const.}}\&=operatorname {E} _{theta }left[left({hat {theta }}-operatorname {E} _{theta }[{hat {theta }}]right)^{2}right]+2left(operatorname {E} _{theta }[{hat {theta }}]-theta right)left(operatorname {E} _{theta }[{hat {theta }}]-operatorname {E} _{theta }[{hat {theta }}]right)+left(operatorname {E} _{theta }[{hat {theta }}]-theta right)^{2}&&operatorname {E} _{theta }[{hat {theta }}]={text{const.}}\&=operatorname {E} _{theta }left[left({hat {theta }}-operatorname {E} _{theta }[{hat {theta }}]right)^{2}right]+left(operatorname {E} _{theta }[{hat {theta }}]-theta right)^{2}\&=operatorname {Var} _{theta }({hat {theta }})+operatorname {Bias} _{theta }({hat {theta }},theta )^{2}end{aligned}}}](https://wikimedia.org/api/rest_v1/media/math/render/svg/2ac524a751828f971013e1297a33ca1cc4c38cd6)

![{displaystyle {begin{aligned}operatorname {MSE} ({hat {theta }})&=mathbb {E} [({hat {theta }}-theta )^{2}]\&=operatorname {Var} ({hat {theta }}-theta )+(mathbb {E} [{hat {theta }}-theta ])^{2}\&=operatorname {Var} ({hat {theta }})+operatorname {Bias} ^{2}({hat {theta }})end{aligned}}}](https://wikimedia.org/api/rest_v1/media/math/render/svg/864646cf4426e2b62a3caf9460382eec1a77fe4e)

![{displaystyle operatorname {MSE} left({overline {X}}right)=operatorname {E} left[left({overline {X}}-mu right)^{2}right]=left({frac {sigma }{sqrt {n}}}right)^{2}={frac {sigma ^{2}}{n}}}](https://wikimedia.org/api/rest_v1/media/math/render/svg/b4647a2cc4c8f9a4c90b628faad2dcf80c4aae84)

![{displaystyle {begin{aligned}operatorname {MSE} (S_{a}^{2})&=operatorname {E} left[left({frac {n-1}{a}}S_{n-1}^{2}-sigma ^{2}right)^{2}right]\&=operatorname {E} left[{frac {(n-1)^{2}}{a^{2}}}S_{n-1}^{4}-2left({frac {n-1}{a}}S_{n-1}^{2}right)sigma ^{2}+sigma ^{4}right]\&={frac {(n-1)^{2}}{a^{2}}}operatorname {E} left[S_{n-1}^{4}right]-2left({frac {n-1}{a}}right)operatorname {E} left[S_{n-1}^{2}right]sigma ^{2}+sigma ^{4}\&={frac {(n-1)^{2}}{a^{2}}}operatorname {E} left[S_{n-1}^{4}right]-2left({frac {n-1}{a}}right)sigma ^{4}+sigma ^{4}&&operatorname {E} left[S_{n-1}^{2}right]=sigma ^{2}\&={frac {(n-1)^{2}}{a^{2}}}left({frac {gamma _{2}}{n}}+{frac {n+1}{n-1}}right)sigma ^{4}-2left({frac {n-1}{a}}right)sigma ^{4}+sigma ^{4}&&operatorname {E} left[S_{n-1}^{4}right]=operatorname {MSE} (S_{n-1}^{2})+sigma ^{4}\&={frac {n-1}{na^{2}}}left((n-1)gamma _{2}+n^{2}+nright)sigma ^{4}-2left({frac {n-1}{a}}right)sigma ^{4}+sigma ^{4}end{aligned}}}](https://wikimedia.org/api/rest_v1/media/math/render/svg/cf22322412b8454c706d78671e5d94208675a6e0)

![{ displaystyle { begin {align} operatorname {MSE} ({ hat { theta}}) & = mathbb {E} [({ hat { theta}} - theta) ^ {2}] \ & = mathbb {E} ({ hat { theta}} ^ {2}) + mathbb {E} ( theta ^ {2}) - 2 theta mathbb {E} ({ hat { theta}}) \ & = operatorname {Var} ({ hat { theta}}) + ( mathbb {E} { hat { theta}}) ^ {2} + theta ^ { 2} -2 theta mathbb {E} ({ hat { theta}}) \ & = operatorname {Var} ({ hat { theta}}) + ( mathbb {E} { hat { theta}} - theta) ^ {2} \ & = operatorname {Var} ({ hat { theta}}) + operatorname {Bias} ^ {2} ({ hat { theta} }) end {выровнен}}}](https://wikimedia.org/api/rest_v1/media/math/render/svg/dad2ee14a56b1cffdceff350213c9f8d4af4bc3f)