Замена нелинейного

звена линеаризованной моделью позволяет

использовать принцип суперпозиции —

провести раздельный анализ преобразования

системой детерминированных и случайных

составляющих входных сигналов. Особенность

применения принципа суперпозиции на

основе статистической линеаризации

состоит в том, что для случайных

составляющих нелинейное звено заменяется

безынерционным звеном с коэффициентом

k1,

а для детерминированных — безынерционным

звеном с коэффициентом k0

(при нечетной нелинейности) или постоянным

сигналом 0.

Определяемые по

полученным выше формулам коэффициенты

статистической линеаризации оказываются

функциями моментов распределения

сигналов на входе нелинейности, которые,

в свою очередь, вычисляются через

передаточные функции системы, включающей

в себя линеаризованное звено, то есть

зависят от коэффициентов статистической

линеаризации. Вследствие этого расчет

стационарного процесса в статистически

линеаризованной системе сводится к

решению системы нелинейных алгебраических

уравнений, требующему применения

численных методов.

Для заданной

системы (рисунок 1) передаточная функция

линейной части:

.

Задающее воздействие

изменяется по закону g(t)=g1(t).

На входе действует случайная помеха

F(t)

с нулевым математическим ожиданием и

спектральной плотностью

.

Требуется определить математическое

ожидание и среднеквадратическое

отклонение сигнала ошибки в установившемся

процессе.

Выделим

детерминированную и случайную составляющие

сигнала ошибки:

.

С учетом характера входных сигналов и

в соответствии с принципом суперпозиции

составляющие сигнала ошибки в

линеаризованной системе будут определяться

следующим образом:

mx(t)=

xgуст,

.

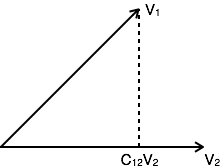

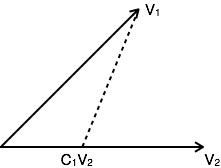

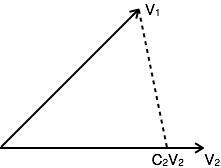

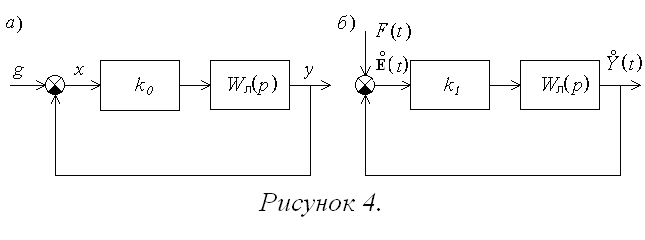

Для расчета

детерминированной составляющей сигнала

ошибки после линеаризации используется

структурная схема (рис. 4,а),

а для расчета центрированной случайной

составляющей — структурная схема (рис.

4,б),

где

,

=k1(mx,σx).

Для полученных

структурных схем искомые характеристики

сигнала ошибки определяются следующим

образом: mE=mx,

DE=DY.

При расчете

детерминированной составляющей

передаточная функция замкнутой системы

по ошибке имеет вид:

.

В результате:

.

Среднеквадратическое

отклонение сигнала ошибки в рассматриваемой

задаче полностью определяется возмущающим

воздействием и находится через дисперсию

выходного сигнала и передаточную функцию

замкнутой системы по возмущению, которая

в рассматриваемом примере примет вид:

.

В результате:

,

Коэффициенты

полиномов (1) примут вид:

a0=T1T2,

,

,

,

b0=0,

b1=0,

.

Определители (3)

будут иметь третий порядок и получаются

следующими:

=

.

В результате:

При заданных

k,

T

и c

для расчета характеристик ошибки

необходимо решить систему нелинейных

алгебраических уравнений:

mE=

,

,

,

.

4. РЕШЕНИЕ УРАВНЕНИЙ

И ПОСТРОЕНИЕ ЗАВИСИМОСТЕЙ

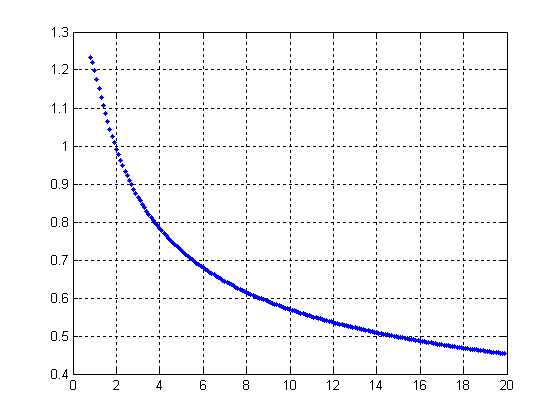

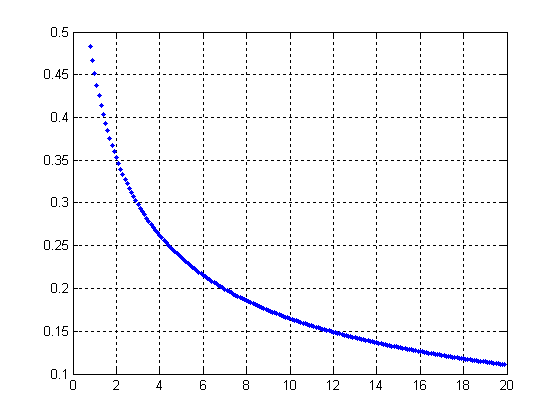

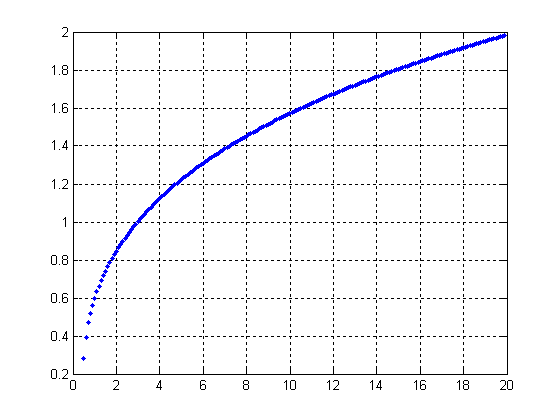

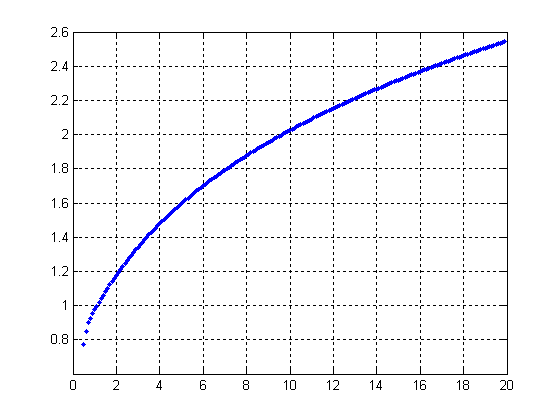

С помощью программы,

написанной на языке MATLAB,

решив систему методом последовательных

приближений, мы найдем зависимости

коэффициентов статистической линеаризации,

математического ожидания и

среднеквадратического отклонения

ошибки системы E(t)

от величины коэффициента передачи k.

Для нахождения зависимости M

от k

использована функция MATLAB

fzero.

Текст программы представлен в приложении

А. Графики зависимостей представлены

на рисунках 5-9.

Рисунок

5

Рисунок 6

Рисунок 7

Рисунок 8

Рисунок 9

Соседние файлы в предмете [НЕСОРТИРОВАННОЕ]

- #

- #

- #

- #

- #

- #

- #

- #

- #

- #

- #

On Nonidentical Discrete-Time Hyperchaotic Systems Synchronization: Towards Secure Medical Image Transmission

Narjes Khalifa, Mohamed Benrejeb, in Recent Advances in Chaotic Systems and Synchronization, 2019

3.3 Measurement of Encryption and Decryption Quality

Mean Square Error (MSE), Peak Signal-to-Noise Ratio (PSNR), and Structural Similarity Index Measure (SSIM) (see Appendix A) are used to measure the proposed encryption and decryption algorithms quality [51].

In this context, MSE, PSNR, and SSIM are performed between plain and encrypted images, then between plain and decrypted images. The obtained values of SSIM are very close to zero, those of PSNR low, and the MSE ones > 30 dB, which denotes the difference between original and encrypted images, as shown in Table 2.

Table 2. MSE, PSNR, and SSIM Values Between Plain and Encrypted Images

| Images | MSE | PSNR | SSIM |

|---|---|---|---|

| Fig. 5A and B | 93.2738 | 8.1372 | 0.0023 |

| Fig. 5D and E | 75.8129 | 7.7288 | 0.0041 |

| Fig. 5G and H | 42.2462 | 5.9944 | 0.0034 |

Furthermore, for plain and decrypted images, the obtained values of SSIM are very close to 1, those of PSNR high, and MSE values close to 0, as shown in Table 3. As a result, the different resultant values of MSE, PSNR, and SSIM show the effectiveness of the proposed encryption algorithm applied to secure medical image transmission.

Table 3. MSE, PSNR, and SSIM Values Between Plain and Decrypted Images

| Images | MSE | PSNR | SSIM |

|---|---|---|---|

| Fig. 5A and C | 6.1 × 10− 5 | 49.9718 | 0.9998 |

| Fig. 5D and F | 0 | 55.8007 | 0.9999 |

| Fig. 5G and I | 0 | 48.9251 | 0.9995 |

Read full chapter

URL:

https://www.sciencedirect.com/science/article/pii/B9780128158388000169

Multichannel Image Recovery

Nikolas P. Galatsanos, … Rafael Molina, in Handbook of Image and Video Processing (Second Edition), 2005

3.1 Linear Minimum Mean Square Error (LMMSE) Estimation

The mean square error (MSE), defined as

(4)MSE(fˆ)=E{‖f−fˆ‖2},

is a measure of the quality of the image estimate fˆ. Here, E{·} denotes the expectation operator. Among the images that are a linear function of the data (i.e., fˆ=Ag where A a matrix), the image that minimizes the MSE is known as the linear minimum mean square error (LMMSE) estimate fLMMSE. Assuming f and n are uncorrelated [4], the LMMSE solution is found by finding the matrix A that minimizes the MSE. The resulting LMMSE solution is

(5)fLMMSE=CfHT(HCfHT+Cn)−1g,

where Cn is the covariance matrix of the multichannel noise vector n, and Cf is the KNM × KNM covariance matrix of the multichannel image vector f, defined as

(6)Cf=E{f fT}=[C11C12…C1KC22C22…C2K…………CK1CK2…CKK],

where Cij=E{fjfiT}.

Using the matrix inversion lemma [14] it is easy to show that

(7)CfHT(HCfH+Cn)−1=(HTCn−1H+Cf−)−1HTCn−1.

Thus, we can also write

(8)fLMMSE=(HTCn−1H+Cf−1)−1HTCn−1g.

Read full chapter

URL:

https://www.sciencedirect.com/science/article/pii/B9780121197926500760

Regression analysis

Kanishka Tyagi, … Michael Manry, in Artificial Intelligence and Machine Learning for EDGE Computing, 2022

3 Cost functions

The cost function is used to understand how close a machine learning model is predicted to the actual output. The cost function is essential and should be the first measure to be chosen while performing machine learning-related tasks. For different applications, different sets of cost functions are used. Cost functions are also called loss functions. Below, we describe the most commonly used cost function and also discuss for which application it is used.

3.1 MSE

Mean square error (MSE) is most widely used in the regression model, where the independent variable that is the target values are continuous. It is measured as the mean squared differences between actual output and predicted output, which is defined as

(2)E=1Nv∑p=1Nv[tp−yp]2

where tp is the pth pattern of actual output and yp is the pth pattern of the predicted output. Nv is the total number of patterns. tp −yp is also called as residual error. MSE is also called as L2 loss and is said to be less robust to outliers. If there is an outlier in the dataset and as we can see that the residuals are squared, those outliers are doubled, which contributes to larger prediction values which can also result to greater weight changes.

3.2 MSLE

Mean square logarithmic error (MLSE) is similar to MSE. MLSE is preferred when treating both small and large errors equally and does not want large errors to influence training.

(3)E=1Nv∑p=1Nv[log(tp+1)−log(yp+1)]2

From the previous equation, we can observe that “1” is added as log(0) is undefined.

3.3 RMSE

Root mean square error (RMSE) is similar to MSE expect we need to square root the MSE. RMSE behaves like the standard deviation of the residuals, which indicate how spread the residuals are.

(4)E=1Nv∑p=1Nv[tp−yp]2

Similar to MSLE, RMSLE is also a cost function, where we add a log function and add a one to Eq. (4) similar to Eq. (3). RMSE is preferred over MSE when lower residuals are of importance.

3.4 MAE

Mean absolute error (MAE) cost is measured as the mean differences between actual output and predicted output, which is defined as

(5)E=1Nv∑p=1Nv|tp−yp|

where the difference is the absolute value rather than squared as in MSE. MAE is also called as L1 loss and robust to outliers as we do not square the residuals.

Read full chapter

URL:

https://www.sciencedirect.com/science/article/pii/B9780128240540000071

Optimization of Methods for Image-Texture Segmentation Using Ant Colony Optimization

Manasa Nadipally, in Intelligent Data Analysis for Biomedical Applications, 2019

2.4 Evaluation of Segmentation Techniques

Assessment is essential in deciding which segmentation algorithm is suitable to be selected. For extraction of the boundary, the edge detection is assessed by using root-mean-square-error (RMSE), mean-square error (MSE), peak signal-to-noise ratio (PSNR), and signal-to-noise ratio (SNR) [30–32].

2.4.1 Mean-Square Error

MSE value denotes the average difference of the pixels all over the image. A higher value of MSE designates a greater difference amid the original image and processed image. Nonetheless, it is indispensable to be extremely careful with the edges. The following equation provides a formula for calculation of the MSE.

(2.24)MSE=1N∑∑(Eij−oij)2

here, N is the image size, O is the original image, whereas, E is the edge image.

2.4.2 Root-Mean-Square-Error

The RMSE is extensively used for measuring the differences between values forecasted by an estimator, or model, and the values that are observed. The RMSE aggregates the magnitudes of the predictions errors several times into a single distinct measure of predictive power. It is a measure of precision. The RMSE value can be calculated by taking the square root of MSE.

(2.25)RMSE=1N∑∑(Eij−oij)2

2.4.3 Signal-to-Noise Ratio

SNR describes the total noise present in the output edge detected in an image, in comparison to the noise in the original signal level. SNR is a quality metric and presents a rough calculation of the possibility of false switching; it serves as a mean to compare the relative performance of different implementations [33–35]. SNR is estimated by Eq. (2.26):

(2.26)SNR=[ΣiΣj(Eij)2ΣiΣj(Eij−oij)2]

2.4.4 Peak Signal-to-Noise Ratio

The PSNR calculates the PSNR ratio in decibels amid two images. We often use this ratio as a measurement of quality between the original image and the resultant image. The higher the value of PSNR, the better will be the quality of the output image. For calculating the PSNR, MSE is used. We calculate the PSNR by using Eq. (2.27).

(2.27)PSNR=10⋅log10(MAXI2MSE)=20⋅log10(MAXIMSE)=20⋅log10(MAXI)−10⋅log10(MSE)

Here, MAXI is the maximum possible pixel value of the image

Read full chapter

URL:

https://www.sciencedirect.com/science/article/pii/B9780128155530000021

Uplink Physical Layer Functions

Sassan Ahmadi, in LTE-Advanced, 2014

10.9.5.1 LMMSE receiver

An LMMSE receiver is a widely used solution which generates an MMSE estimate for each time-domain symbol. The MMSE has been used as a baseline receiver in LTE/LTE-Advanced evaluations due to its simplicity. The detection problem in an LMMSE receiver reduces to finding a weighting matrix such that sˆ1(k,l)=W1(k,l)y1(k,l), where the weighting matrix is given as follows [25–27,43,44]:

(10.18)W1(k,l)=Hˆ1H(k,l)R−1;R=P1Hˆ1(k,l)H1H(k,l)+σ2I

where Hˆj(k,l) and σ2 denote the estimated channel matrix and noise power, respectively, P1 is the transmission power of the serving cell and is given by P1=E[|s1(k,l)|2].

Due to the linearity and unitary properties of DFT, an equivalent equalization method would be to obtain a frequency-domain MMSE estimate for each symbol in the frequency-domain, and then take the IDFT to obtain the time-domain MMSE symbol estimation. The MMSE estimation for each frequency-domain symbol is obtained by linearly combining received signals collected from multiple receive antennas in the frequency-domain, using MMSE combining weights W(k)=[H(k)HH(k)+R(k)]–1H(k), where k is the sub-carrier index, H(k) is a vector representing the frequency response for the layer signal of interest (one element per receive antenna), and R(k) is the impairment covariance matrix encompassing the spatial correlation between the impairment components. The performance of this simple MMSE equalizer asymptotically approaches the theoretical capacity in a SIMO channel. However, in a MIMO channel, LMMSE equalizer performance is far from the SIMO capacity due to the presence of spatial multiplexing interference [127].

Read full chapter

URL:

https://www.sciencedirect.com/science/article/pii/B9780124051621000101

Digital Picture Formats and Representations

David R. Bull, in Communicating Pictures, 2014

Peak signal to noise ratio (PSNR)

Mean Square Error-based metrics are in common use as objective measures of distortion, due mainly to their ease of calculation. An image with a higher MSE will generally express more visible distortions than one with a low MSE. In image and video compression, it is however common practice to use Peak Signal to Noise Ratio (PSNR) rather than MSE to characterize reconstructed image quality. PSNR is of particular use if images are being compared with different dynamic ranges and it is employed for a number of different reasons:

- 1.

-

MSE values will take on different meanings if the wordlength of the signal samples changes.

- 2.

-

Unlike many natural signals, the mean of an image or video frame is not normally zero and indeed will vary from frame to frame.

- 3.

-

PSNR normalizes MSE with respect to the peak signal value rather than signal variance, and in doing so enables direct comparison between the results from different codecs or systems.

- 4.

-

PSNR can never be less than zero.

The PSNR for our image S is given by:

(4.25)PSNR=10·log10Asmax2∑x=0X-1∑y=0Y-1(e[x,y])2

where for a wordlength B:smax=2B-1. We can also include a binary mask, b[x,y], so that the PSNR value for a specific arbitrary image region can be calculated. Thus:

(4.26)PSNR=10·log10smax2∑x=0X-1∑y=0Y-1b[x,y]∑x=0X-1∑y=0Y-1(e[x,y])2

Although there is no perceptual basis for PSNR, it does fit reasonably well with subjective assessments, especially in cases where algorithms are compared that produce similar types of artifact. It remains the most commonly used objective distortion metric, because of its mathematical tractability and because of the lack of any widely accepted alternative. It is worth noting, however, that PSNR can be deceptive, for example when:

- 1.

-

There is a phase shift in the reconstructed signal. Even tiny phase shifts that the human observer would not notice will produce significant changes.

- 2.

-

There is visual masking in the coding process that provides perceptually high quality by hiding distortions in regions where they are less noticeable.

- 3.

-

Errors persist over time. A single small error in a single frame may not be noticeable, yet it could be annoying if it persists over many frames.

- 4.

-

Comparisons are being made between different coding strategies (e.g. synthesis based vs block transform based (see Chapters 10 and 13Chapter 10Chapter 13)).

Consider the images in Figure 4.18. All of these have the same PSNR value (16.5 dB), but most people would agree that they do not exhibit the same perceptual qualities. In particular, the bottom right image with a small spatial shift is practically indistinguishable from the original. In cases such as this, perception-based metrics can offer closer correlation with subjective opinions and these are considered in more detail in Chapter 10.

Example 4.5 Calculating PSNR

Consider a 3×3 image S of 8-bit values and its approximation after compression and reconstruction, S~. Calculate the MSE and the PSNR of the reconstructed block.

Figure 4.18. Quality comparisons for the same PSNR (16.5 dB). Top left to bottom right: original; AWGN (variance 0.24); grid lines; salt and pepper noise; spatial shift by 5 pixels vertically and horizontally.

Solution

We can see that X=3,Y=3,smax=255, and A=9. Using equation (4.22) the MSE is given by:

MSE=79

and from equation (4.25), it can be seen that the PSNR for this block is given by:

PSNR=10·log109×25527=49.2dB

Read full chapter

URL:

https://www.sciencedirect.com/science/article/pii/B9780124059061000040

Energy-Efficient MIMO–OFDM Systems

Zimran Rafique, Boon-Chong Seet, in Handbook of Green Information and Communication Systems, 2013

15.2.1.2.2 MMSE Detection Algorithm

The minimum mean square error (MMSE) detection algorithm has almost the same computational complexity as the ZF detection algorithm but gives more reliable results even with a noisy estimation of the channel due to the introduction of diagonal matrix 1SNRINr in the MMSE filter (GMMSE) equation [29]. This algorithm consists of following steps with the assumption that channel response “H” is known at the receiver side:

- •

-

Calculate GMMSE=H∗[HH∗+1SNRINr]-1 where 1SNR is the noise power to signal power ratio and INr is the identity matrix of size Nr.

- •

-

Select the ith row of GMMSE and multiply it with Rec to detect the signal yi:

yi=GMMSE̲iRec.

- •

-

The estimated value of the signal is detected by slicing to the nearest value in the signal constellation:

S^i=Q(yi).

Read full chapter

URL:

https://www.sciencedirect.com/science/article/pii/B9780124158443000152

Mean-Square Error Linear Estimation

Sergios Theodoridis, in Machine Learning (Second Edition), 2020

4.1 Introduction

Mean-square error (MSE) linear estimation is a topic of fundamental importance for parameter estimation in statistical learning. Besides historical reasons, which take us back to the pioneering works of Kolmogorov, Wiener, and Kalman, who laid the foundations of the optimal estimation field, understanding MSE estimation is a must, prior to studying more recent techniques. One always has to grasp the basics and learn the classics prior to getting involved with new “adventures.” Many of the concepts to be discussed in this chapter are also used in the next chapters.

Optimizing via a loss function that builds around the square of the error has a number of advantages, such as a single optimal value, which can be obtained via the solution of a linear set of equations; this is a very attractive feature in practice. Moreover, due to the relative simplicity of the resulting equations, the newcomer in the field can get a better feeling of the various notions associated with optimal parameter estimation. The elegant geometric interpretation of the MSE solution, via the orthogonality theorem, is presented and discussed. In the chapter, emphasis is also given to computational complexity issues while solving for the optimal solution. The essence behind these techniques remains exactly the same as that inspiring a number of computationally efficient schemes for online learning, to be discussed later in this book.

The development of the chapter is around real-valued variables, something that will be true for most of the book. However, complex-valued signals are particularly useful in a number of areas, with communications being a typical example, and the generalization from the real to the complex domain may not always be trivial. Although in most of the cases the difference lies in changing matrix transpositions by Hermitian ones, this is not the whole story. This is the reason that we chose to deal with complex-valued data in separate sections, whenever the differences from the real data are not trivial and some subtle issues are involved.

Read full chapter

URL:

https://www.sciencedirect.com/science/article/pii/B9780128188033000131

Accruement of nonlinear dynamical system and its dynamics: electronics and cryptographic engineering

Najeeb Alam Khan, … Tooba Hameed, in Fractional Order Systems and Applications in Engineering, 2023

Mean square error (MSE)

The mean square error (MSE) is calculated to make sure that the original and decrypted images are in variations or not. The lesser the MSE between two images, the better the decryption; it is defined as

MSE(q1,q2)=1MN∑i=0M−1∑j=0N−1(q1(i,j)−q2(i,j))2,

where q1(i,j) and q2(i,j) indicate the original and decrypted images, respectively.

Read full chapter

URL:

https://www.sciencedirect.com/science/article/pii/B9780323909532000153

Detection methods

Yi Hong, … Emanuele Viterbo, in Delay-Doppler Communications, 2022

6.3.3 Complexity

The LMMSE methods of (6.18) and (6.19) in the delay-Doppler domain and time domain, respectively, require inverting an NM×NM matrix, thereby incurring a complexity of O((NM)3). Note that the cubic complexity can be reduced by taking advantage of the banded and sparse structure of H and G, as well as the fact that the time domain matrix G is sparser than H, since |L|⩽P⩽S.

For CP/ZP-OTFS, the LMMSE detection can be performed block-wise for N blocks (see (6.20)), which requires inverting N submatrices of size M×M, followed by transforming the time domain estimates to the delay-Doppler domain. Hence, such detection has an overall complexity of O(NM3+NMlog2N)), which is significantly lower than for the LMMSE methods in (6.18) and (6.19). In addition, the sparsity and banded nature of these submatrices can be exploited to further reduce detection complexity.

Read full chapter

URL:

https://www.sciencedirect.com/science/article/pii/B9780323850285000141

В статистических данных и обработки сигналов , A минимальной среднеквадратической ошибки ( MMSE ) оценки является метод оценки , который минимизирует среднеквадратичную ошибку (MSE), которая является общей мерой оценки качества, из подогнанных значений зависимой переменной . В байесовской установке термин MMSE более конкретно относится к оценке с квадратичной функцией потерь . В таком случае оценка MMSE задается апостериорным средним значением параметра, который необходимо оценить. Поскольку вычисление апостериорного среднего затруднительно, форма оценки MMSE обычно ограничивается определенным классом функций. Линейные оценщики MMSE — популярный выбор, поскольку они просты в использовании, легко вычисляются и очень универсальны. Это породило множество популярных оценок , таких как фильтр Винера-Колмогорова и фильтра Калмана .

Мотивация

Термин MMSE более конкретно относится к оценке в байесовской среде с квадратичной функцией стоимости. Основная идея байесовского подхода к оценке проистекает из практических ситуаций, когда у нас часто есть некоторая предварительная информация о параметре, который нужно оценить. Например, у нас может быть предварительная информация о диапазоне, который может принимать параметр; или у нас может быть старая оценка параметра, который мы хотим изменить, когда станет доступным новое наблюдение; или статистика фактического случайного сигнала, такого как речь. Это контрастирует с небайесовским подходом, таким как несмещенная оценка с минимальной дисперсией (MVUE), где предполагается, что о параметре заранее ничего не известно и который не учитывает такие ситуации. В байесовском подходе такая априорная информация фиксируется априорной функцией плотности вероятности параметров; и основанный непосредственно на теореме Байеса , он позволяет нам делать более точные апостериорные оценки по мере появления большего количества наблюдений. Таким образом, в отличие от небайесовского подхода, при котором представляющие интерес параметры считаются детерминированными, но неизвестными константами, байесовская оценка стремится оценить параметр, который сам по себе является случайной величиной. Кроме того, байесовская оценка также может иметь дело с ситуациями, когда последовательность наблюдений не обязательно независима. Таким образом, байесовская оценка представляет собой еще одну альтернативу MVUE. Это полезно, когда MVUE не существует или не может быть найден.

Определение

Пусть будет скрытой случайной векторной переменной, и пусть будет известной случайной векторной переменной (измерение или наблюдение), причем обе они не обязательно имеют одинаковую размерность. Оценка по какой — либо функции измерения . Вектор ошибки оценки задается выражением, а его среднеквадратическая ошибка (MSE) задается следом ковариационной матрицы ошибок.

где ожидание берется за и . Когда — скалярная переменная, выражение MSE упрощается до . Обратите внимание, что MSE может быть эквивалентно определено другими способами, поскольку

Затем оценщик MMSE определяется как оценщик, достигающий минимальной MSE:

Характеристики

- Когда средние значения и дисперсии конечны, оценка MMSE определяется однозначно и определяется следующим образом:

-

- Другими словами, оценка MMSE — это условное ожидание данного известного наблюдаемого значения измерений.

- Оценка MMSE является беспристрастной (согласно предположениям регулярности, упомянутым выше):

- Оценщик MMSE асимптотически несмещен и сходится по распределению к нормальному распределению:

-

- где есть информация Фишера из . Таким образом, оценка MMSE асимптотически эффективна .

-

- для всех в замкнутом линейном подпространстве измерений. Для случайных векторов, поскольку MSE для оценки случайного вектора является суммой MSE координат, нахождение оценки MMSE для случайного вектора разлагается на нахождение оценок MMSE для координат X по отдельности:

- для всех i и j . Говоря более кратко, взаимная корреляция между минимальной ошибкой оценки и средством оценки должна быть равна нулю,

Линейный оценщик MMSE

Во многих случаях невозможно определить аналитическое выражение оценки MMSE. Два основных численных подхода для получения оценки MMSE зависят либо от нахождения условного ожидания, либо от нахождения минимумов MSE. Прямая численная оценка условного ожидания требует больших вычислительных ресурсов, поскольку часто требует многомерного интегрирования, обычно выполняемого с помощью методов Монте-Карло . Другой вычислительный подход заключается в прямом поиске минимумов MSE с использованием таких методов, как методы стохастического градиентного спуска ; но этот метод по-прежнему требует оценки ожидания. Хотя эти численные методы оказались плодотворными, выражение в закрытой форме для оценки MMSE, тем не менее, возможно, если мы готовы пойти на некоторые компромиссы.

Одна из возможностей состоит в том, чтобы отказаться от требований полной оптимальности и найти метод минимизации MSE в рамках определенного класса оценщиков, такого как класс линейных оценщиков. Таким образом, мы постулируем , что условное математическое ожидание данности является простым линейной функцией , где измерение является случайным вектором, является матрицей и является вектором. Это можно рассматривать как приближение Тейлора первого порядка . Линейный оценщик MMSE — это оценщик, достигающий минимальной MSE среди всех оценщиков такой формы. То есть решает следующие задачи оптимизации:

Одним из преимуществ такого линейного средства оценки MMSE является то, что нет необходимости явно вычислять апостериорную функцию плотности вероятности . Такая линейная оценка зависит только от первых двух моментов и . Таким образом, хотя может быть удобно предположить, что и являются вместе гауссовыми, нет необходимости делать это предположение, пока предполагаемое распределение имеет хорошо определенные первый и второй моменты. Форма линейной оценки не зависит от типа предполагаемого базового распределения.

Выражение для оптимального и определяется выражением:

где , является кросс-ковариационная матрица между и , то есть автоматически ковариационная матрица .

Таким образом, выражение для линейной оценки MMSE, его среднего значения и автоковариации имеет вид

где — матрица кросс-ковариации между и .

Наконец, ковариация ошибки и минимальная среднеквадратичная ошибка, достижимые такой оценкой, равны

Вывод по принципу ортогональности

Пусть у нас есть оптимальная линейная оценка MMSE, заданная как , где мы должны найти выражение для и . Требуется, чтобы оценка MMSE была беспристрастной. Это означает,

Подставляя выражение для выше, мы получаем

где и . Таким образом, мы можем переписать оценку как

и выражение для ошибки оценки принимает вид

Исходя из принципа ортогональности, мы можем иметь , где возьмем . Здесь левый член

Приравнивая к нулю, мы получаем искомое выражение для as

Является кросс-ковариационная матрица между Х и Y, а это автоматически ковариационная матрица Y. Так , выражение может быть также переписана в терминах , как

Таким образом, полное выражение для линейной оценки MMSE имеет вид

Поскольку оценка сама по себе является случайной величиной с , мы также можем получить ее автоковариацию как

Подставляя выражение для и , получаем

Наконец, ковариация линейной ошибки оценки MMSE будет тогда выражена как

Первый член в третьей строке равен нулю из-за принципа ортогональности. Поскольку мы можем переписать в терминах ковариационных матриц как

Мы можем признать, что это то же самое, что и. Таким образом, минимальная среднеквадратичная ошибка, достижимая такой линейной оценкой, равна

-

.

Одномерный случай

Для особого случая, когда оба и являются скалярами, приведенные выше отношения упрощаются до

где — коэффициент корреляции Пирсона между и .

Вычисление

Стандартный метод, такой как исключение Гаусса, может использоваться для решения матричного уравнения для . Более стабильный в числовом отношении метод обеспечивается методом QR-разложения . Поскольку матрица является симметричной положительно определенной матрицей, ее можно решить в два раза быстрее с помощью разложения Холецкого , в то время как для больших разреженных систем метод сопряженных градиентов более эффективен. Рекурсия Левинсона — это быстрый метод, когда она также является матрицей Теплица . Это может произойти, когда это стационарный процесс в широком смысле . В таких стационарных случаях эти оценки также называют фильтрами Винера – Колмогорова .

Линейная оценка MMSE для процесса линейного наблюдения

Давайте далее смоделируем основной процесс наблюдения как линейный процесс:, где — известная матрица, а — вектор случайного шума со средним значением и кросс-ковариацией . Здесь искомое среднее и ковариационные матрицы будут

Таким образом, выражение для матрицы линейной оценки MMSE дополнительно изменяется на

Подставляя все в выражение для , получаем

Наконец, ковариация ошибок равна

Существенное различие между описанной выше задачей оценивания и проблемой наименьших квадратов и оценкой Гаусса-Маркова состоит в том, что количество наблюдений m (т. Е. Размерность ) не обязательно должно быть по крайней мере таким же большим, как количество неизвестных n (т. Е. размер ). Оценка для процесса линейного наблюдения существует при условии, что M матрицы с размерностью м матрица существует; это так для любого m, если, например, положительно определено. Физическая причина этого свойства заключается в том, что, поскольку теперь это случайная величина, можно сформировать значимую оценку (а именно ее среднее значение) даже без измерений. Каждое новое измерение просто предоставляет дополнительную информацию, которая может изменить нашу первоначальную оценку. Еще одна особенность этой оценки состоит в том, что при m < n погрешности измерения быть не должно. Таким образом, мы можем иметь , потому что, пока она положительно определена, оценка все еще существует. Наконец, этот метод может обрабатывать случаи, когда шум коррелирован.

Альтернативная форма

Альтернативная форма выражения может быть получена с помощью матричного тождества

что может быть установлено путем последующего умножения на и предварительного умножения на, чтобы получить

а также

Поскольку теперь можно записать в терминах as , мы получаем упрощенное выражение для as

В таком виде приведенное выше выражение легко сравнить с взвешенным методом наименьших квадратов и оценкой Гаусса – Маркова . В частности, когда , соответствующий бесконечной дисперсии априорной информации относительно , результат идентичен взвешенной линейной оценке по методу наименьших квадратов с использованием весовой матрицы. Более того, если компоненты не коррелированы и имеют одинаковую дисперсию, так что где — единичная матрица, то она идентична обычной оценке методом наименьших квадратов.

Последовательная линейная оценка MMSE

Во многих приложениях реального времени данные наблюдений недоступны в виде единого пакета. Вместо этого наблюдения производятся последовательно. Наивное применение предыдущих формул заставило бы нас отбросить старую оценку и пересчитать новую оценку по мере поступления свежих данных. Но тогда мы теряем всю информацию, предоставленную старым наблюдением. Когда наблюдения являются скалярными величинами, один из возможных способов избежать таких повторных вычислений — сначала объединить всю последовательность наблюдений, а затем применить стандартную формулу оценки, как это сделано в Примере 2. Но это может быть очень утомительно, поскольку количество наблюдений увеличивается, поэтому увеличивается размер матриц, которые необходимо инвертировать и умножать. Также этот метод трудно распространить на случай векторных наблюдений. Другой подход к оценке на основе последовательных наблюдений — просто обновить старую оценку по мере появления дополнительных данных, что приведет к более точным оценкам. Таким образом, желателен рекурсивный метод, при котором новые измерения могут изменять старые оценки. В этих обсуждениях подразумевается предположение, что статистические свойства не меняются со временем. Другими словами, стационарен.

Для последовательной оценки, если у нас есть оценка, основанная на измерениях, генерирующих пространство , то после получения другого набора измерений мы должны вычесть из этих измерений ту часть, которую можно было бы ожидать по результатам первых измерений. Другими словами, обновление должно быть основано на той части новых данных, которая ортогональна старым данным.

Предположим, что оптимальная оценка была сформирована на основе прошлых измерений и что матрица ковариации ошибок равна . Для процессов линейного наблюдения наилучшей оценкой, основанной на прошлых наблюдениях и, следовательно, старой оценке , является . Вычитая из , получаем ошибку предсказания

-

.

Новая оценка, основанная на дополнительных данных, теперь

где — кросс-ковариация между и и — автоковариация

Используя тот факт, что и , мы можем получить ковариационные матрицы в терминах ковариации ошибок как

Собирая все вместе, мы получаем новую оценку как

и новая ковариация ошибок как

Повторное использование двух вышеупомянутых уравнений по мере того, как становится доступным больше наблюдений, приводит к методам рекурсивной оценки. Более компактно выражения можно записать как

Матрицу часто называют коэффициентом усиления. Повторение этих трех шагов по мере того, как становится доступным больше данных, приводит к итерационному алгоритму оценки. Обобщение этой идеи на нестационарные случаи приводит к созданию фильтра Калмана . Три этапа обновления, описанные выше, действительно образуют этап обновления фильтра Калмана.

Частный случай: скалярные наблюдения

В качестве важного частного случая может быть получено простое в использовании рекурсивное выражение, когда в каждый t-й момент времени основной процесс линейного наблюдения выдает скаляр, такой что , где — известный вектор-столбец размером n на 1, значения которого могут изменяться со временем , представляет собой оцениваемый случайный вектор-столбец размером n на 1 и представляет собой скалярный шумовой член с дисперсией . После ( t +1) -го наблюдения прямое использование приведенных выше рекурсивных уравнений дает выражение для оценки как:

где это новое наблюдение скалярного и коэффициент усиления является п его-1 вектор — столбца задается

Является п матрицы с размерностью п ошибка ковариационная матрица задается

Здесь инверсия матрицы не требуется. Кроме того, коэффициент усиления зависит от нашей уверенности в новой выборке данных, измеренной по дисперсии шума, по сравнению с предыдущими данными. За начальные значения и принимаются среднее значение и ковариация априорной функции плотности вероятности .

Альтернативные подходы: этот важный частный случай также привел к появлению многих других итерационных методов (или адаптивных фильтров ), таких как фильтр наименьших средних квадратов и рекурсивный фильтр наименьших квадратов , которые напрямую решают исходную проблему оптимизации MSE с использованием стохастических градиентных спусков . Однако, поскольку ошибку оценки нельзя непосредственно наблюдать, эти методы пытаются минимизировать среднеквадратичную ошибку прогноза . Например, в случае скалярных наблюдений у нас есть градиент. Таким образом, уравнение обновления для фильтра наименьших квадратов имеет вид

где — размер скалярного шага, а математическое ожидание аппроксимируется мгновенным значением . Как мы видим, эти методы обходят необходимость в ковариационных матрицах.

Примеры

Пример 1

В качестве примера возьмем задачу линейного прогнозирования . Пусть линейная комбинация наблюдаемых скалярных случайных величин и будет использоваться для оценки другой будущей скалярной случайной величины, такой что . Если случайные величины являются действительными гауссовскими случайными величинами с нулевым средним и ее ковариационная матрица, заданная формулой

то наша задача — найти такие коэффициенты , чтобы получить оптимальную линейную оценку .

В терминах терминологии, разработанной в предыдущих разделах, для этой задачи у нас есть вектор наблюдения , матрица оценки как вектор-строка и оцениваемая переменная как скалярная величина. Матрица автокорреляции определяется как

Матрица взаимной корреляции определяется как

Теперь мы решаем уравнение путем инвертирования и предварительного умножения, чтобы получить

Итак, у нас есть и

в качестве оптимальных коэффициентов для . Тогда вычисление минимальной среднеквадратичной ошибки дает . Обратите внимание, что нет необходимости получать явную матрицу, обратную для вычисления значения . Матричное уравнение может быть решено с помощью хорошо известных методов, таких как метод исключения Гаусса. Более короткий нечисловой пример можно найти в принципе ортогональности .

Пример 2

Рассмотрим вектор, сформированный путем наблюдений за фиксированным, но неизвестным скалярным параметром, нарушенным белым гауссовским шумом. Мы можем описать процесс линейным уравнением , где . В зависимости от контекста будет ясно, представляет ли он скаляр или вектор. Предположим, что мы знаем, что это диапазон, в который будет попадать значение. Мы можем смоделировать нашу неопределенность с помощью априорного равномерного распределения по интервалу и, таким образом, будем иметь дисперсию . Пусть вектор шума распределен нормально, как где — единичная матрица. Также и независимы и . Легко увидеть, что

Таким образом, линейная оценка MMSE имеет вид

Мы можем упростить выражение, используя альтернативную форму для as

где у нас есть

Точно так же дисперсия оценки равна

Таким образом, MMSE этой линейной оценки

Для очень больших мы видим, что оценка MMSE скаляра с равномерным априорным распределением может быть аппроксимирована средним арифметическим всех наблюдаемых данных.

в то время как дисперсия не будет зависеть от данных, и LMMSE оценки будет стремиться к нулю.

Однако оценка является неоптимальной, поскольку ограничена линейностью. Если бы случайная величина также была гауссовой, тогда оценка была бы оптимальной. Обратите внимание, что форма оценки останется неизменной, независимо от априорного распределения , до тех пор, пока среднее и дисперсия этих распределений одинаковы.

Пример 3

Рассмотрим вариант приведенного выше примера: на выборах баллотируются два кандидата. Пусть доля голосов , что кандидат получит на день выборов будет Таким образом доля голосов, другой кандидат получит будет Примем как случайная величина с равномерным априорное распределение , так что его среднее значение и дисперсия Несколько За несколько недель до выборов два независимых опроса общественного мнения провели два независимых опроса общественного мнения. Первый опрос показал, что кандидат, скорее всего, наберет небольшую часть голосов. Так как некоторые ошибки всегда присутствует из — за конечной выборки и методологии частности опроса , принятого, первый опросчик объявляет свою оценку , чтобы иметь ошибку с нулевым средним и дисперсией Аналогично, второй опросчик объявляет свою оценку , чтобы быть с ошибкой с нулевым средним и дисперсией Обратите внимание, что, за исключением среднего значения и дисперсии ошибки, распределение ошибок не указано. Как следует объединить эти два опроса, чтобы получить прогноз голосования для данного кандидата?

Как и в предыдущем примере, у нас есть

Здесь оба файла . Таким образом, мы можем получить оценку LMMSE как линейную комбинацию и как

где веса даны как

Здесь, поскольку член знаменателя постоянен, опросу с меньшей ошибкой дается более высокий вес, чтобы предсказать результат выборов. Наконец, дисперсия прогноза определяется выражением

что делает меньше, чем

В общем, если у нас есть опросчики, то где вес для i-го опроса определяется как

Пример 4

Предположим, что музыкант играет на инструменте, и звук улавливается двумя микрофонами, каждый из которых расположен в двух разных местах. Пусть ослабление звука из-за расстояния до каждого микрофона равно и , которые считаются известными константами. Аналогично, пусть шум на каждом микрофоне будет и , каждый с нулевым средним значением и дисперсией и соответственно. Позвольте обозначить звук, издаваемый музыкантом, который является случайной величиной с нулевым средним значением и дисперсией. Как следует объединить записанную музыку с этих двух микрофонов после синхронизации друг с другом?

Мы можем смоделировать звук, получаемый каждым микрофоном, как

Здесь оба файла . Таким образом, мы можем объединить два звука как

где i-й вес задается как

Смотрите также

- Байесовская оценка

- Среднеквадратичная ошибка

- Наименьших квадратов

- Несмещенная оценка с минимальной дисперсией (MVUE)

- Принцип ортогональности

- Фильтр Винера

- Фильтр Калмана

- Линейное предсказание

- Эквалайзер с нулевым форсированием

Примечания

-

^

«Среднеквадратичная ошибка (MSE)» . www.probabilitycourse.com . Дата обращения 9 мая 2017 . - ^ Мун и Стирлинг.

дальнейшее чтение

- Джонсон, Д. «Оценщики минимальной среднеквадратичной ошибки» . Связи. Архивировано из минимальных среднеквадратичных оценщиков ошибок оригинала 25 июля 2008 года . Проверено 8 января 2013 года .

- Джейнс, ET (2003). Теория вероятностей: логика науки . Издательство Кембриджского университета. ISBN 978-0521592710.

- Bibby, J .; Тутенбург, Х. (1977). Прогнозирование и улучшенная оценка в линейных моделях . Вайли. ISBN 9780471016564.

- Lehmann, EL; Казелла, Г. (1998). «Глава 4». Теория точечного оценивания (2-е изд.). Springer. ISBN 0-387-98502-6.

- Кей, С.М. (1993). Основы статистической обработки сигналов: теория оценивания . Прентис Холл. стр. 344 -350. ISBN 0-13-042268-1.

- Люенбергер, Д.Г. (1969). «Глава 4, Оценка методом наименьших квадратов». Оптимизация методами векторного пространства (1-е изд.). Вайли. ISBN 978-0471181170.

- Луна, ТЗ; Стирлинг, WC (2000). Математические методы и алгоритмы обработки сигналов (1-е изд.). Прентис Холл. ISBN 978-0201361865.

- Ван Trees, HL (1968). Выявление, оценка и теория модуляции, часть I . Нью-Йорк: Вили. ISBN 0-471-09517-6.

- Хайкин, СО (2013). Теория адаптивного фильтра (5-е изд.). Прентис Холл. ISBN 978-0132671453.

При использовании

критерия минимума СКО, взвешивающие коэффициенты ячеек эквалайзера подстраиваются

так, чтобы минимизировать средний квадрат ошибки

, (10.2.24)

где — информационный символ,

переданный на -ом

сигнальном интервале, a — оценка этого символа на выходе

эквалайзера, определяемая (10.2.1). Если информационные символы комплексные, то

показатель качества при СКО критерия, обозначаемый , определяется так

. (10.2.25)

С другой стороны, когда

информационные символы вещественные, показатель качества просто равен квадрату

вещественной величины . В любом случае,

является квадратичнйй

функцией коэффициентов эквалайзера . При дальнейшем обсуждении мы

рассмотрим минимизацию комплексной формы, даваемой (10.2.25).

Эквалайзер неограниченной

длины. Сначала

определим взвешивающие коэффициенты ячеек, которые минимизируют , когда эквалайзер

имеет неограниченное число ячеек. В этом случае, оценка определяется так

Подстановка (10.2.26) в

выражение для ,

определяемая (10.2.25), и расширение результата приводит к квадратичной функции

от коэффициентов .

Эту функцию можно легко минимизировать по посредством решения системы

(неограниченной) линейных уравнений для . Альтернативно, систему линейных

уравнений можно получить путём использования принципа ортогональности при

среднеквадратичном оценивании. Это значит, мы выбираем коэффициенты такие, что ошибка

ортогональна

сигнальной

последовательности для

. То есть

(10.2.27)

Подстановка в (10.2.27) даёт

или, что эквивалентно,

Чтобы вычислить моменты в

(10.2.28), мы используем выражение для даваемое (10.1.16). Таким образом,

получим

и

Теперь, если подставим

(10.2.29) и (10.2.30) в (10.2.28) и возьмём -преобразование от обеих частей

результирующего уравнения, мы находим

. (10.2.31)

Следовательно,

передаточная функция эквалайзера, основанного на критерии минимума СКО, равна

Если обеляющий фильтр

включён в ,

мы получаем эквивалентный эквалайзер с передаточной функцией

Видим, что единственная

разница между этим выражением для и тем, которое базируется на критерии

пикового искажения — это спектральная плотность шума , которая появилась в (10.2.33),

Если очень

мало по сравнению с сигналом, коэффициенты, которые минимизируют пиковые

искажения приближённо

равны коэффициентам, которые минимизируют по СКО показатель качества . Это значит, что в

пределе, когда ,

два критерия дают одинаковое решение для взвешивающих коэффициентов. Следовательно,

когда , минимизация

СКО ведёт к полному исключению МСИ. С другой стороны, это не так, когда . В общем, когда

, оба критерия дают

остаточное МСИ и аддитивный шум на выходе эквалайзера.

Меру остаточного МСИ и

аддитивного шума на выходе эквалайзера можно получить расчётом минимальной

величины ,

обозначаемую ,

когда передаточная функция

эквалайзера определена

(10.2.32). Поскольку и поскольку

с учётом условия

ортогональности (10.2.27), следует

Эта частная форма для не очень

информативна. Больше понимания зависимости качества эквалайзера от канальных

характеристик можно получить, если суммы в (10.2.34) преобразовать в частотную

область. Это можно выполнить, заметив, что сумма в (10.2.34) является свёрткой и

, вычисленной при

нулевом сдвиге. Так, если через обозначить свёртку этих

последовательностей, то сумма в (10.2.34) просто равна . Поскольку

— преобразование

последовательности равно

то слагаемое равно

Контурный интеграл в

(10.2.36) можно преобразовать в эквивалентный линейный интеграл путём замены

переменной .

В результате этой замены получаем

Наконец, подставив (10.2.37)

в сумму (10.2.34), получаем желательное выражение для минимума СКО в виде

В отсутствие МСИ и, следовательно,

. (10.2.39)

Видим, что . Далее,

соотношение между выходным (нормированного по энергии сигнала) ОСШ и

выглядит так

.

Более

существенно то, что соотношение и

также имеет силу, когда имеется

остаточная МСИ в дополнении к шуму на выходе эквалайзера.

Эквалайзер ограниченной длины. Теперь

вернём наше внимание к случаю, когда длительность импульсной характеристики

трансверсального эквалайзера простирается на ограниченном временном интервале,

т.е. эквалайзер имеет конечную память или ограниченную длину. Выход эквалайзера

на -м сигнальном

интервале равен

СКО эквалайзера с ячейками, обозначаемый

, равен

Минимизация по взвешивающим

коэффициентам ячеек или, что эквивалентно, требуя, чтобы

ошибка была

бы ортогональна сигнальным отсчётам ,

, приводит к следующей системе

уравнений:

где

Удобно

выразить систему линейных уравнений в матричной форме, т.е.

где означает вектор столбец

взвешивающих

значений кодовых ячеек, означает

матрицу ковариаций Эрмита с

элементами ;

а мерный

вектор столбец с элементами . Решение (10.2.46) можно записать в

виде

Таким образом, решение для включает в себя

обращение матрицы . Оптимальные взвешивающие

коэффициенты ячеек, даваемые (10.2.47), минимизируют показатель качества , что приводит к

минимальной величине

где определяет транспонированный вектор

столбец .

можно

использовать в (10.2.40) для вычисления ОСШ линейного эквивалента с коэффициентами

ячеек.

In statistics and signal processing, a minimum mean square error (MMSE) estimator is an estimation method which minimizes the mean square error (MSE), which is a common measure of estimator quality, of the fitted values of a dependent variable. In the Bayesian setting, the term MMSE more specifically refers to estimation with quadratic loss function. In such case, the MMSE estimator is given by the posterior mean of the parameter to be estimated. Since the posterior mean is cumbersome to calculate, the form of the MMSE estimator is usually constrained to be within a certain class of functions. Linear MMSE estimators are a popular choice since they are easy to use, easy to calculate, and very versatile. It has given rise to many popular estimators such as the Wiener–Kolmogorov filter and Kalman filter.

Motivation[edit]

The term MMSE more specifically refers to estimation in a Bayesian setting with quadratic cost function. The basic idea behind the Bayesian approach to estimation stems from practical situations where we often have some prior information about the parameter to be estimated. For instance, we may have prior information about the range that the parameter can assume; or we may have an old estimate of the parameter that we want to modify when a new observation is made available; or the statistics of an actual random signal such as speech. This is in contrast to the non-Bayesian approach like minimum-variance unbiased estimator (MVUE) where absolutely nothing is assumed to be known about the parameter in advance and which does not account for such situations. In the Bayesian approach, such prior information is captured by the prior probability density function of the parameters; and based directly on Bayes theorem, it allows us to make better posterior estimates as more observations become available. Thus unlike non-Bayesian approach where parameters of interest are assumed to be deterministic, but unknown constants, the Bayesian estimator seeks to estimate a parameter that is itself a random variable. Furthermore, Bayesian estimation can also deal with situations where the sequence of observations are not necessarily independent. Thus Bayesian estimation provides yet another alternative to the MVUE. This is useful when the MVUE does not exist or cannot be found.

Definition[edit]

Let

where the expectation

The MMSE estimator is then defined as the estimator achieving minimal MSE:

Properties[edit]

- When the means and variances are finite, the MMSE estimator is uniquely defined[1] and is given by:

-

- In other words, the MMSE estimator is the conditional expectation of

given the known observed value of the measurements. Also, since

is the posterior mean, the error covariance matrix

is equal to the posterior covariance

matrix,

.

- The MMSE estimator is unbiased (under the regularity assumptions mentioned above):

- The MMSE estimator is asymptotically unbiased and it converges in distribution to the normal distribution:

-

- where

is the Fisher information of

. Thus, the MMSE estimator is asymptotically efficient.

-

- for all

in closed, linear subspace

of the measurements. For random vectors, since the MSE for estimation of a random vector is the sum of the MSEs of the coordinates, finding the MMSE estimator of a random vector decomposes into finding the MMSE estimators of the coordinates of X separately:

- for all i and j. More succinctly put, the cross-correlation between the minimum estimation error

and the estimator

should be zero,

Linear MMSE estimator[edit]

In many cases, it is not possible to determine the analytical expression of the MMSE estimator. Two basic numerical approaches to obtain the MMSE estimate depends on either finding the conditional expectation

One possibility is to abandon the full optimality requirements and seek a technique minimizing the MSE within a particular class of estimators, such as the class of linear estimators. Thus, we postulate that the conditional expectation of

One advantage of such linear MMSE estimator is that it is not necessary to explicitly calculate the posterior probability density function of

The expression for optimal

where

Thus, the expression for linear MMSE estimator, its mean, and its auto-covariance is given by

where the

Lastly, the error covariance and minimum mean square error achievable by such estimator is

Univariate case[edit]

For the special case when both

where

The above two equations allows us to interpret the correlation coefficient either as normalized slope of linear regression

or as square root of the ratio of two variances

.

When

Computation[edit]

Standard method like Gauss elimination can be used to solve the matrix equation for

Linear MMSE estimator for linear observation process[edit]

Let us further model the underlying process of observation as a linear process:

Thus the expression for the linear MMSE estimator matrix

Putting everything into the expression for

Lastly, the error covariance is

The significant difference between the estimation problem treated above and those of least squares and Gauss–Markov estimate is that the number of observations m, (i.e. the dimension of

Alternative form[edit]

An alternative form of expression can be obtained by using the matrix identity

which can be established by post-multiplying by

and

Since

In this form the above expression can be easily compared with weighed least square and Gauss–Markov estimate. In particular, when

Sequential linear MMSE estimation[edit]

In many real-time applications, observational data is not available in a single batch. Instead the observations are made in a sequence. One possible approach is to use the sequential observations to update an old estimate as additional data becomes available, leading to finer estimates. One crucial difference between batch estimation and sequential estimation is that sequential estimation requires an additional Markov assumption.

In the Bayesian framework, such recursive estimation is easily facilitated using Bayes’ rule. Given

The

This is the Markov assumption.

The MMSE estimate

In the context of linear MMSE estimator, the formula for the estimate will have the same form as before. However, the mean and covariance matrices of

The mean and covariance matrix of the prior density

respectively, as per by the property of MMSE estimators.

Similarly, for the linear observation process, the mean and covariance matrix of the likelihood

.

The difference between the predicted value of

![{displaystyle mathrm {E} [{tilde {y}}_{k}]=0}](https://wikimedia.org/api/rest_v1/media/math/render/svg/b7333e06de208be900c7d618273db57bf678fb1f)

.

Hence, in the estimate update formula, we should replace

Thus, we have the new estimate as

and the new error covariance as

From the point of view of linear algebra, for sequential estimation, if we have an estimate

The repeated use of the above two equations as more observations become available lead to recursive estimation techniques. The expressions can be more compactly written as

The matrix

The repetition of these three steps as more data becomes available leads to an iterative estimation algorithm. The generalization of this idea to non-stationary cases gives rise to the Kalman filter. The three update steps outlined above indeed form the update step of the Kalman filter.

Special case: scalar observations[edit]

As an important special case, an easy to use recursive expression can be derived when at each k-th time instant the underlying linear observation process yields a scalar such that

where

The

Here, no matrix inversion is required. Also, the gain factor,

Alternative approaches: This important special case has also given rise to many other iterative methods (or adaptive filters), such as the least mean squares filter and recursive least squares filter, that directly solves the original MSE optimization problem using stochastic gradient descents. However, since the estimation error

where

Examples[edit]

Example 1[edit]

We shall take a linear prediction problem as an example. Let a linear combination of observed scalar random variables

![{displaystyle z=[z_{1},z_{2},z_{3},z_{4}]^{T}}](https://wikimedia.org/api/rest_v1/media/math/render/svg/45cb1f9123fdf786074088616e42dfbcc1359d07)

then our task is to find the coefficients

In terms of the terminology developed in the previous sections, for this problem we have the observation vector ![{displaystyle y=[z_{1},z_{2},z_{3}]^{T}}](https://wikimedia.org/api/rest_v1/media/math/render/svg/7fdeb8eb600c7a066561d28e2b3f32fb5b1572b9)

![W=[w_{1},w_{2},w_{3}]](https://wikimedia.org/api/rest_v1/media/math/render/svg/dd8e9343b228a9044dbb8208e9ceeb31270b04c1)

The cross correlation matrix

We now solve the equation

So we have

as the optimal coefficients for

mean square error then gives ![{displaystyle leftVert erightVert _{min }^{2}=operatorname {E} [z_{4}z_{4}]-WC_{YX}=15-WC_{YX}=.2857}](https://wikimedia.org/api/rest_v1/media/math/render/svg/44558ab7a0b5ead1b9571853096d800773b38877)

Example 2[edit]

Consider a vector

![1=[1,1,ldots ,1]^{T}](https://wikimedia.org/api/rest_v1/media/math/render/svg/43fec89f837a5e8d53869fb49ec95a9e56a788f0)

![[-x_{0},x_{0}]](https://wikimedia.org/api/rest_v1/media/math/render/svg/e79873ca5ddfd5d6b0168f6373b33c8bc3756c69)

![[-x_{0},x_{0}]](https://wikimedia.org/api/rest_v1/media/math/render/svg/e79873ca5ddfd5d6b0168f6373b33c8bc3756c69)

Thus, the linear MMSE estimator is given by

We can simplify the expression by using the alternative form for

where for ![y=[y_{1},y_{2},ldots ,y_{N}]^{T}](https://wikimedia.org/api/rest_v1/media/math/render/svg/8317c7045e5b1318cec0c4ee89727a02cdeecafc)

Similarly, the variance of the estimator is

Thus the MMSE of this linear estimator is

For very large

while the variance will be unaffected by data

However, the estimator is suboptimal since it is constrained to be linear. Had the random variable

Example 3[edit]

Consider a variation of the above example: Two candidates are standing for an election. Let the fraction of votes that a candidate will receive on an election day be ![xin [0,1].](https://wikimedia.org/api/rest_v1/media/math/render/svg/1c44eb6b4643a03d3c166df0e61c4925b6d4d4f0)

![[0,1]](https://wikimedia.org/api/rest_v1/media/math/render/svg/738f7d23bb2d9642bab520020873cccbef49768d)

As with previous example, we have

Here, both the

where the weights are given by

Here, since the denominator term is constant, the poll with lower error is given higher weight in order to predict the election outcome. Lastly, the variance of

which makes

In general, if we have

Example 4[edit]

Suppose that a musician is playing an instrument and that the sound is received by two microphones, each of them located at two different places. Let the attenuation of sound due to distance at each microphone be

We can model the sound received by each microphone as

Here both the

where the i-th weight is given as

See also[edit]

- Bayesian estimator

- Mean squared error

- Least squares

- Minimum-variance unbiased estimator (MVUE)

- Orthogonality principle

- Wiener filter

- Kalman filter

- Linear prediction

- Zero-forcing equalizer

Notes[edit]

- ^ «Mean Squared Error (MSE)». www.probabilitycourse.com. Retrieved 9 May 2017.

- ^ Moon and Stirling.

Further reading[edit]

- Johnson, D. «Minimum Mean Squared Error Estimators». Connexions. Archived from Minimum Mean Squared Error Estimators the original on 25 July 2008. Retrieved 8 January 2013.

- Jaynes, E.T. (2003). Probability Theory: The Logic of Science. Cambridge University Press. ISBN 978-0521592710.

- Bibby, J.; Toutenburg, H. (1977). Prediction and Improved Estimation in Linear Models. Wiley. ISBN 9780471016564.

- Lehmann, E. L.; Casella, G. (1998). «Chapter 4». Theory of Point Estimation (2nd ed.). Springer. ISBN 0-387-98502-6.

- Kay, S. M. (1993). Fundamentals of Statistical Signal Processing: Estimation Theory. Prentice Hall. pp. 344–350. ISBN 0-13-042268-1.

- Luenberger, D.G. (1969). «Chapter 4, Least-squares estimation». Optimization by Vector Space Methods (1st ed.). Wiley. ISBN 978-0471181170.

- Moon, T.K.; Stirling, W.C. (2000). Mathematical Methods and Algorithms for Signal Processing (1st ed.). Prentice Hall. ISBN 978-0201361865.

- Van Trees, H. L. (1968). Detection, Estimation, and Modulation Theory, Part I. New York: Wiley. ISBN 0-471-09517-6.

- Haykin, S.O. (2013). Adaptive Filter Theory (5th ed.). Prentice Hall. ISBN 978-0132671453.

In statistics and signal processing, a minimum mean square error (MMSE) estimator is an estimation method which minimizes the mean square error (MSE), which is a common measure of estimator quality, of the fitted values of a dependent variable. In the Bayesian setting, the term MMSE more specifically refers to estimation with quadratic loss function. In such case, the MMSE estimator is given by the posterior mean of the parameter to be estimated. Since the posterior mean is cumbersome to calculate, the form of the MMSE estimator is usually constrained to be within a certain class of functions. Linear MMSE estimators are a popular choice since they are easy to use, easy to calculate, and very versatile. It has given rise to many popular estimators such as the Wiener–Kolmogorov filter and Kalman filter.

Motivation[edit]

The term MMSE more specifically refers to estimation in a Bayesian setting with quadratic cost function. The basic idea behind the Bayesian approach to estimation stems from practical situations where we often have some prior information about the parameter to be estimated. For instance, we may have prior information about the range that the parameter can assume; or we may have an old estimate of the parameter that we want to modify when a new observation is made available; or the statistics of an actual random signal such as speech. This is in contrast to the non-Bayesian approach like minimum-variance unbiased estimator (MVUE) where absolutely nothing is assumed to be known about the parameter in advance and which does not account for such situations. In the Bayesian approach, such prior information is captured by the prior probability density function of the parameters; and based directly on Bayes theorem, it allows us to make better posterior estimates as more observations become available. Thus unlike non-Bayesian approach where parameters of interest are assumed to be deterministic, but unknown constants, the Bayesian estimator seeks to estimate a parameter that is itself a random variable. Furthermore, Bayesian estimation can also deal with situations where the sequence of observations are not necessarily independent. Thus Bayesian estimation provides yet another alternative to the MVUE. This is useful when the MVUE does not exist or cannot be found.

Definition[edit]

Let

where the expectation

The MMSE estimator is then defined as the estimator achieving minimal MSE:

Properties[edit]

- When the means and variances are finite, the MMSE estimator is uniquely defined[1] and is given by:

-

- In other words, the MMSE estimator is the conditional expectation of

given the known observed value of the measurements. Also, since

is the posterior mean, the error covariance matrix

is equal to the posterior covariance

matrix,

.

- The MMSE estimator is unbiased (under the regularity assumptions mentioned above):

- The MMSE estimator is asymptotically unbiased and it converges in distribution to the normal distribution:

-

- where

is the Fisher information of

. Thus, the MMSE estimator is asymptotically efficient.

-

- for all

in closed, linear subspace

of the measurements. For random vectors, since the MSE for estimation of a random vector is the sum of the MSEs of the coordinates, finding the MMSE estimator of a random vector decomposes into finding the MMSE estimators of the coordinates of X separately:

- for all i and j. More succinctly put, the cross-correlation between the minimum estimation error

and the estimator

should be zero,

Linear MMSE estimator[edit]

In many cases, it is not possible to determine the analytical expression of the MMSE estimator. Two basic numerical approaches to obtain the MMSE estimate depends on either finding the conditional expectation

One possibility is to abandon the full optimality requirements and seek a technique minimizing the MSE within a particular class of estimators, such as the class of linear estimators. Thus, we postulate that the conditional expectation of

One advantage of such linear MMSE estimator is that it is not necessary to explicitly calculate the posterior probability density function of

The expression for optimal

where

Thus, the expression for linear MMSE estimator, its mean, and its auto-covariance is given by

where the

Lastly, the error covariance and minimum mean square error achievable by such estimator is

Univariate case[edit]

For the special case when both

where

The above two equations allows us to interpret the correlation coefficient either as normalized slope of linear regression

or as square root of the ratio of two variances

.

When

Computation[edit]

Standard method like Gauss elimination can be used to solve the matrix equation for

Linear MMSE estimator for linear observation process[edit]

Let us further model the underlying process of observation as a linear process:

Thus the expression for the linear MMSE estimator matrix

Putting everything into the expression for

Lastly, the error covariance is

The significant difference between the estimation problem treated above and those of least squares and Gauss–Markov estimate is that the number of observations m, (i.e. the dimension of

Alternative form[edit]

An alternative form of expression can be obtained by using the matrix identity

which can be established by post-multiplying by

and

Since

In this form the above expression can be easily compared with weighed least square and Gauss–Markov estimate. In particular, when

Sequential linear MMSE estimation[edit]

In many real-time applications, observational data is not available in a single batch. Instead the observations are made in a sequence. One possible approach is to use the sequential observations to update an old estimate as additional data becomes available, leading to finer estimates. One crucial difference between batch estimation and sequential estimation is that sequential estimation requires an additional Markov assumption.

In the Bayesian framework, such recursive estimation is easily facilitated using Bayes’ rule. Given

The

This is the Markov assumption.

The MMSE estimate

In the context of linear MMSE estimator, the formula for the estimate will have the same form as before. However, the mean and covariance matrices of

The mean and covariance matrix of the prior density

respectively, as per by the property of MMSE estimators.

Similarly, for the linear observation process, the mean and covariance matrix of the likelihood

.

The difference between the predicted value of

![{displaystyle mathrm {E} [{tilde {y}}_{k}]=0}](https://wikimedia.org/api/rest_v1/media/math/render/svg/b7333e06de208be900c7d618273db57bf678fb1f)

.

Hence, in the estimate update formula, we should replace

Thus, we have the new estimate as

and the new error covariance as

From the point of view of linear algebra, for sequential estimation, if we have an estimate

The repeated use of the above two equations as more observations become available lead to recursive estimation techniques. The expressions can be more compactly written as

The matrix

The repetition of these three steps as more data becomes available leads to an iterative estimation algorithm. The generalization of this idea to non-stationary cases gives rise to the Kalman filter. The three update steps outlined above indeed form the update step of the Kalman filter.

Special case: scalar observations[edit]

As an important special case, an easy to use recursive expression can be derived when at each k-th time instant the underlying linear observation process yields a scalar such that

where

The

Here, no matrix inversion is required. Also, the gain factor,

Alternative approaches: This important special case has also given rise to many other iterative methods (or adaptive filters), such as the least mean squares filter and recursive least squares filter, that directly solves the original MSE optimization problem using stochastic gradient descents. However, since the estimation error

where

Examples[edit]

Example 1[edit]

We shall take a linear prediction problem as an example. Let a linear combination of observed scalar random variables

![{displaystyle z=[z_{1},z_{2},z_{3},z_{4}]^{T}}](https://wikimedia.org/api/rest_v1/media/math/render/svg/45cb1f9123fdf786074088616e42dfbcc1359d07)

then our task is to find the coefficients

In terms of the terminology developed in the previous sections, for this problem we have the observation vector ![{displaystyle y=[z_{1},z_{2},z_{3}]^{T}}](https://wikimedia.org/api/rest_v1/media/math/render/svg/7fdeb8eb600c7a066561d28e2b3f32fb5b1572b9)

![W=[w_{1},w_{2},w_{3}]](https://wikimedia.org/api/rest_v1/media/math/render/svg/dd8e9343b228a9044dbb8208e9ceeb31270b04c1)

The cross correlation matrix

We now solve the equation

So we have

as the optimal coefficients for

mean square error then gives ![{displaystyle leftVert erightVert _{min }^{2}=operatorname {E} [z_{4}z_{4}]-WC_{YX}=15-WC_{YX}=.2857}](https://wikimedia.org/api/rest_v1/media/math/render/svg/44558ab7a0b5ead1b9571853096d800773b38877)

Example 2[edit]

Consider a vector

![1=[1,1,ldots ,1]^{T}](https://wikimedia.org/api/rest_v1/media/math/render/svg/43fec89f837a5e8d53869fb49ec95a9e56a788f0)

![[-x_{0},x_{0}]](https://wikimedia.org/api/rest_v1/media/math/render/svg/e79873ca5ddfd5d6b0168f6373b33c8bc3756c69)

![[-x_{0},x_{0}]](https://wikimedia.org/api/rest_v1/media/math/render/svg/e79873ca5ddfd5d6b0168f6373b33c8bc3756c69)

Thus, the linear MMSE estimator is given by

We can simplify the expression by using the alternative form for

where for ![y=[y_{1},y_{2},ldots ,y_{N}]^{T}](https://wikimedia.org/api/rest_v1/media/math/render/svg/8317c7045e5b1318cec0c4ee89727a02cdeecafc)

Similarly, the variance of the estimator is

Thus the MMSE of this linear estimator is

For very large

while the variance will be unaffected by data

However, the estimator is suboptimal since it is constrained to be linear. Had the random variable

Example 3[edit]

Consider a variation of the above example: Two candidates are standing for an election. Let the fraction of votes that a candidate will receive on an election day be ![xin [0,1].](https://wikimedia.org/api/rest_v1/media/math/render/svg/1c44eb6b4643a03d3c166df0e61c4925b6d4d4f0)

![[0,1]](https://wikimedia.org/api/rest_v1/media/math/render/svg/738f7d23bb2d9642bab520020873cccbef49768d)

As with previous example, we have

Here, both the

where the weights are given by

Here, since the denominator term is constant, the poll with lower error is given higher weight in order to predict the election outcome. Lastly, the variance of

which makes

In general, if we have

Example 4[edit]

Suppose that a musician is playing an instrument and that the sound is received by two microphones, each of them located at two different places. Let the attenuation of sound due to distance at each microphone be

We can model the sound received by each microphone as

Here both the

where the i-th weight is given as

See also[edit]

- Bayesian estimator

- Mean squared error

- Least squares

- Minimum-variance unbiased estimator (MVUE)

- Orthogonality principle

- Wiener filter

- Kalman filter

- Linear prediction

- Zero-forcing equalizer

Notes[edit]

- ^ «Mean Squared Error (MSE)». www.probabilitycourse.com. Retrieved 9 May 2017.

- ^ Moon and Stirling.

Further reading[edit]

- Johnson, D. «Minimum Mean Squared Error Estimators». Connexions. Archived from Minimum Mean Squared Error Estimators the original on 25 July 2008. Retrieved 8 January 2013.

- Jaynes, E.T. (2003). Probability Theory: The Logic of Science. Cambridge University Press. ISBN 978-0521592710.

- Bibby, J.; Toutenburg, H. (1977). Prediction and Improved Estimation in Linear Models. Wiley. ISBN 9780471016564.

- Lehmann, E. L.; Casella, G. (1998). «Chapter 4». Theory of Point Estimation (2nd ed.). Springer. ISBN 0-387-98502-6.

- Kay, S. M. (1993). Fundamentals of Statistical Signal Processing: Estimation Theory. Prentice Hall. pp. 344–350. ISBN 0-13-042268-1.

- Luenberger, D.G. (1969). «Chapter 4, Least-squares estimation». Optimization by Vector Space Methods (1st ed.). Wiley. ISBN 978-0471181170.

- Moon, T.K.; Stirling, W.C. (2000). Mathematical Methods and Algorithms for Signal Processing (1st ed.). Prentice Hall. ISBN 978-0201361865.

- Van Trees, H. L. (1968). Detection, Estimation, and Modulation Theory, Part I. New York: Wiley. ISBN 0-471-09517-6.

- Haykin, S.O. (2013). Adaptive Filter Theory (5th ed.). Prentice Hall. ISBN 978-0132671453.

Спектральная плотность вычисляется по известной корреляционной функции при помощи формул.

Вопросы

самоконтроля:

-

Дайте

определение спектральной плотности. -

Какой

функцией является спектральная

плотность. -

Как

вычисляется спектральная плотность

по известной корреляционной функции.

Лекция 59

Цель

лекции: ознакомиться

с расчетами по минимуму среднеквадратичной

ошибки случайной величины.

Задачи лекции:

-

Расчет

по минимуму среднеквадратичной ошибки

случайной величины. -

Критерий

минимума среднеквадратичной ошибки

при одновременном действии полезного

сигнала и помехи.

Желаемый

результат:

Студенты

должны знать:

-

Расчет

по минимуму среднеквадратичной ошибки

случайной величины. -

Критерий

минимума среднеквадратичной ошибки

при одновременном действии полезного

сигнала и помехи.

Учебный материал Расчеты по минимуму среднеквадратичной ошибки

Если

на автоматическую систему действуют

одновременно полезный сигнал и помеха,

то возникает задача оптимального расчета

системы с тем, чтобы получить наименьшую

результирующую ошибку. С точки зрения

наилучшего воспроизведения полезного

сигнала система должна иметь возможно

большую полосу пропускания, а с точки

зрения наилучшего подавления помехи